Проведенный в Sophos анализ образцов вредоносных писем показал, что идея спрятать эксплойт CVE-2021-40444 в RAR-файле вполне оправдала себя. Он с успехом обходит созданный в Microsoft патч, если жертва использует WinRAR новейших версий.

Критическую RCE-уязвимость CVE-2021-40444, привязанную к движку MSHTML (его используют приложения Microsoft Office), разработчики устранили в рамках сентябрьского «вторника патчей». Злоумышленники нашли эту дыру еще до выхода заплатка; после публикации PoC атаки стали более массовыми.

Эксплойт-кампания, выявленная экспертами Sophos, оказалась на удивление скоротечной. Рассылка вредоносного спама, нацеленного на засев инфостилера Formbook, продолжалась в течение 36 часов, 24 и 25 октября, и больше не повторилась. Фальшивые сообщения были оформлены как запрос на заказ, детали и профиль мифической компании получателю предлагалось просмотреть, открыв вложение Profile.rar.

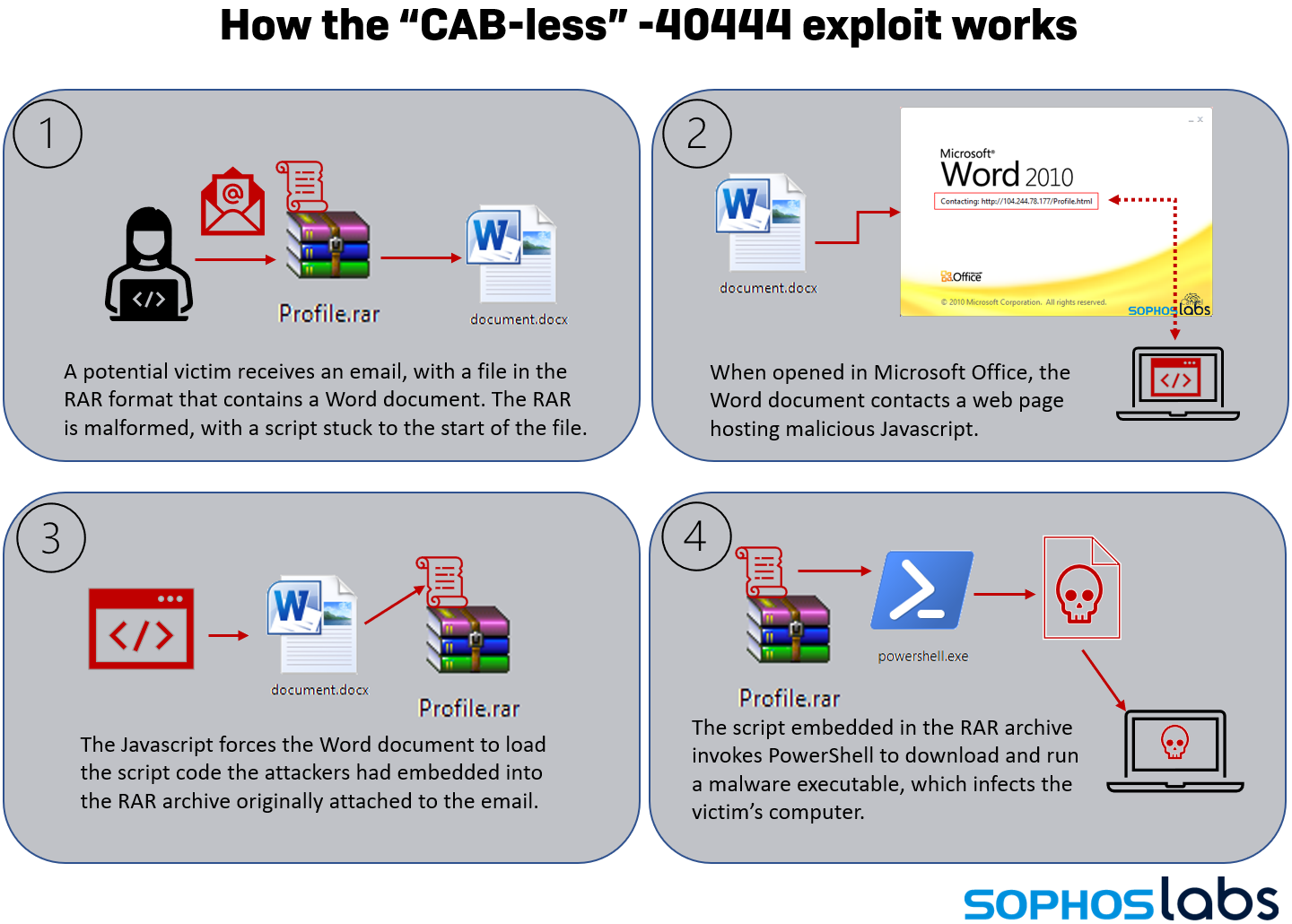

Оказалось, что в начало этого файла добавлен скрипт WSH (Windows Script Host), а заархивированный документ Word содержит встроенный OLE-объект. При его открытии пользователю предлагается включить режим редактирования и запустить активный контент.

Разбор используемого злоумышленниками эксплойта показал, что он написан на основе PoC-кода, опубликованного на GitHub. От прежних версий CVE-2021-40444 он отличается тем, что полезная нагрузка упакована не в CAB-файл (Microsoft закрыла именно эту возможность), а в умышленно искаженный RAR.

Цепочка атаки в этом случае получается совершенно иной. Обновленный эксплойт CVE-2021-40444 в Sophos нарекли CABless-40444.

Примечательно, что устаревшие версии утилиты WinRAR оказались не в состоянии открыть модифицированный архивный файл и извлечь вредоносный документ (при тестировании использовалась версия 3.61). В то же время CABless-40444 успешно отработал после установки WinRAR 6.10 beta 3.