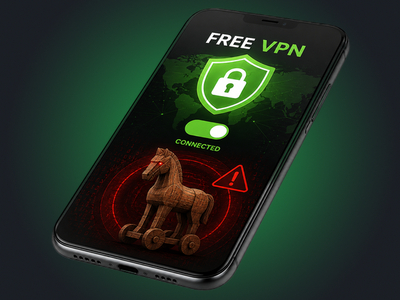

МВД предупредило о новом бесплатном VPN, который на деле оказался совсем не сервисом для приватного доступа в интернет, а банковским трояном с неприятным бонусом в виде загрузчика вредоносных модулей. Схема классическая: пользователь ищет VPN, ставит приложение из стороннего источника, а дальше вместо свободы в Сети получает на устройство зловред.

После установки приложение может получить доступ к СМС, пуш-уведомлениям, данным банковских приложений и загружать на гаджет другие вредоносные модули без ведома пользователя.

В управлении МВД по борьбе с противоправным использованием информационно-коммуникационных технологий напомнили, что бесплатные VPN из сторонних источников регулярно используют как канал распространения вредоносных программ.

Пользователям советуют устанавливать приложения только из официальных магазинов, хотя и это, как уточняют в ведомстве, не даёт стопроцентной гарантии безопасности.

Главная опасность таких приложений в том, что они просят доверия под видом полезного инструмента. Человек думает, что ставит VPN, а по факту сам открывает дверь приложению, которое может читать коды из СМС, перехватывать уведомления и интересоваться банковскими данными.

История не новая, но всё ещё рабочая: слово «бесплатно» отлично продаёт даже откровенно подозрительный APK. Поэтому правило простое: если VPN найден не в официальном магазине, просит странные разрешения и выглядит как подарок судьбы — скорее всего, подарок там не вам, а мошенникам.