Исследователи из zLabs раскрыли крупную вредоносную кампанию против пользователей Android. Злоумышленники распространяли почти 250 вредоносных приложений, которые тайно подписывали жертв на платные мобильные сервисы через биллинг оператора.

Маскировка была максимально попсовая: фейковые приложения выдавали себя за Facebook, Instagram (Facebook и Instagram принадлежат корпорации Meta, признанной экстремистской и запрещённой в России), TikTok, Minecraft, Grand Theft Auto и другие узнаваемые сервисы.

Пользователь думал, что ставит игру или соцсеть, а на деле получал карманного подписочного паразита.

Главная хитрость кампании — выборочная атака по сим-карте. Зловред проверял мобильного оператора жертвы по заранее заданному списку. Если симка подходила, запускалась схема с платной подпиской. Если нет — приложение показывало безобидный контент и не палилось.

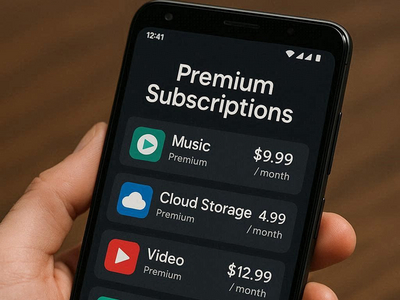

Дальше начиналась автоматика. Вредоносное приложение открывало скрытые WebView, внедряло JavaScript, нажимало нужные кнопки на страницах оператора, запрашивало одноразовые коды и подтверждало подписку. Для перехвата одноразовых кодов использовался легитимный механизм Google SMS Retriever API.

Чтобы платёж точно прошёл через мобильную сеть, зловред мог принудительно отключать Wi-Fi. А данные об устройстве, операторе, разрешениях и мошеннических действиях отправлялись злоумышленникам через телеграм-каналы.

По данным zLabs, кампания активна с марта 2025 года. Исследователи выделили три варианта зловреда: от автоматического подписочного движка до версии с многоступенчатой атакой, кражей cookies и мониторингом действий в реальном времени.

В кампании также нашли как минимум 12 коротких премиальных СМС-номеров, связанных с платными подписками у разных операторов. А ещё у злоумышленников была система трекинга: они отслеживали, через какие площадки — TikTok, Facebook, Google и другие — заражения идут лучше. Маркетинг, только грязный.