Исследователи раскрыли масштабную вредоносную кампанию с участием расширений для Chrome, которая затронула более 500 тысяч аккаунтов во «ВКонтакте». Под видом безобидных инструментов для оформления профиля злоумышленник годами продвигал расширения, которые на деле превращали браузер жертвы в часть управляемой инфраструктуры.

Одним из самых популярных дополнений было VK Styles Themes for vk.com — расширение с примерно 400 тысячами установок и положительными отзывами.

Формально оно меняло оформление соцсети. А фактически внедряло код на каждую посещаемую страницу VK и подключалось к скрытой системе управления.

Расследование началось с того, что специалисты заметили подозрительную вставку рекламных скриптов «Яндекса» на страницах пользователей. При дальнейшем анализе выяснилось, что расширение использовало динамически вычисляемый идентификатор счётчика, чтобы обходить статические проверки.

Это стало отправной точкой для обнаружения ещё четырёх связанных расширений — в общей сложности около 502 тысяч установок. Два из них уже удалены из Chrome Web Store.

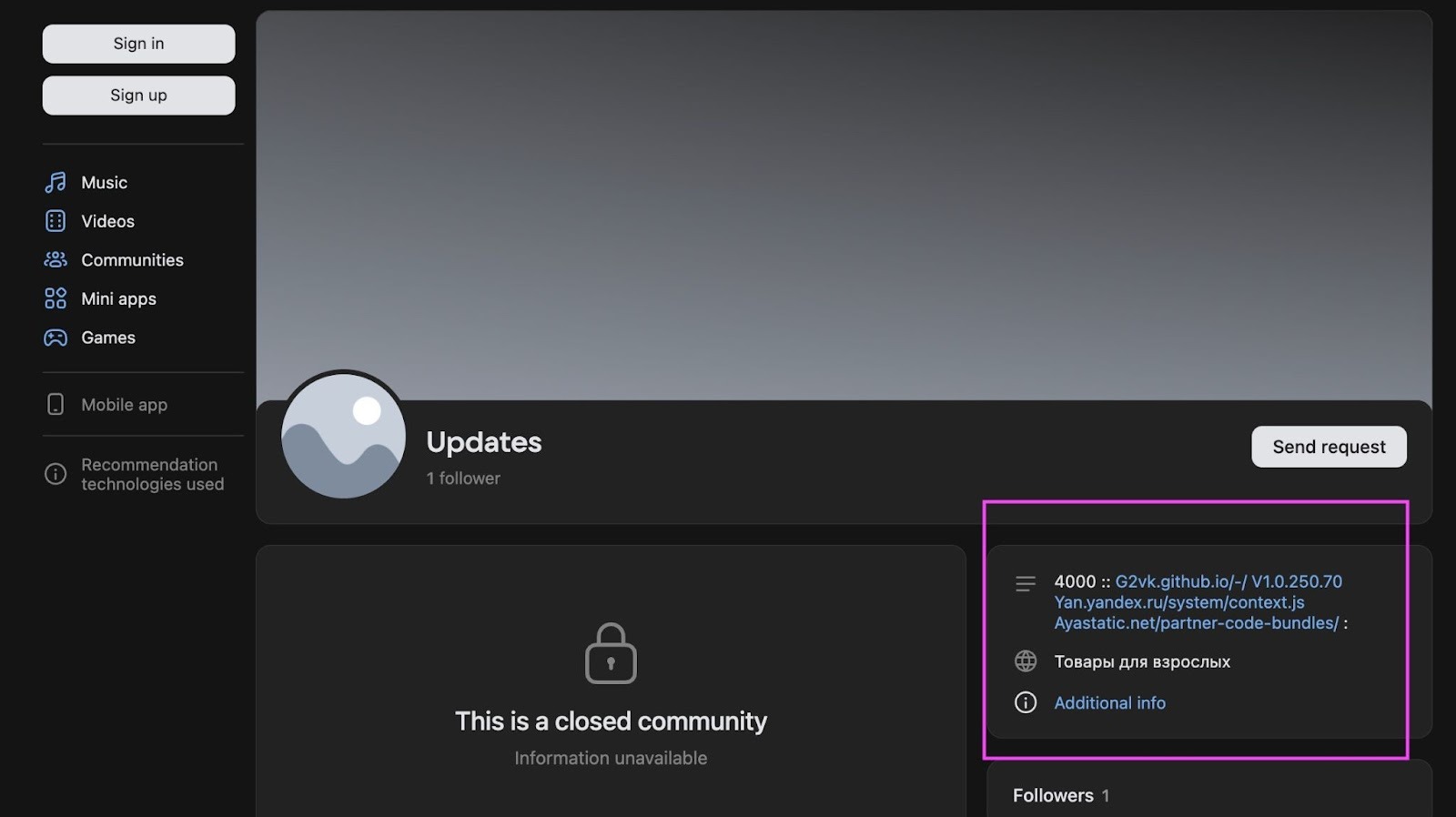

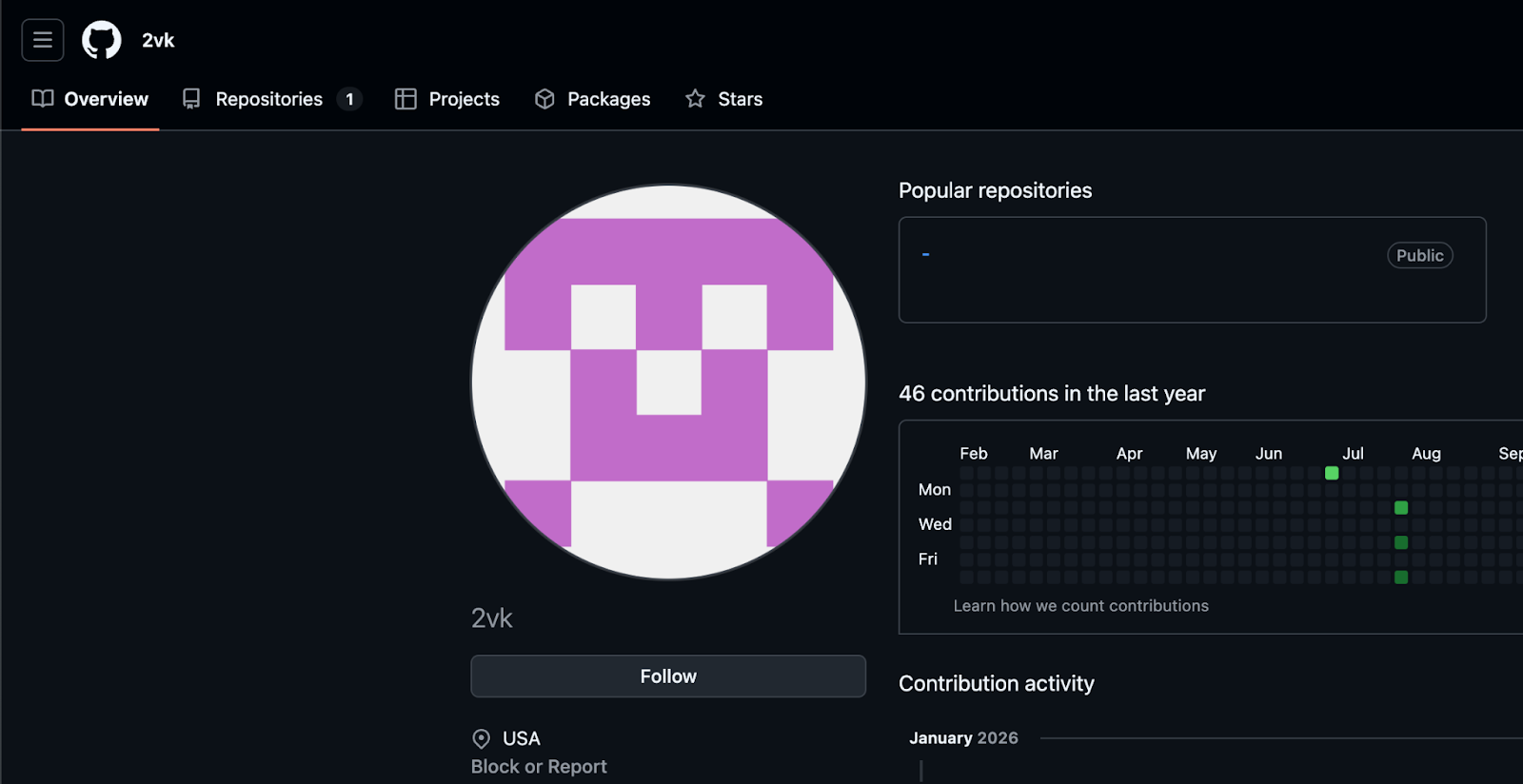

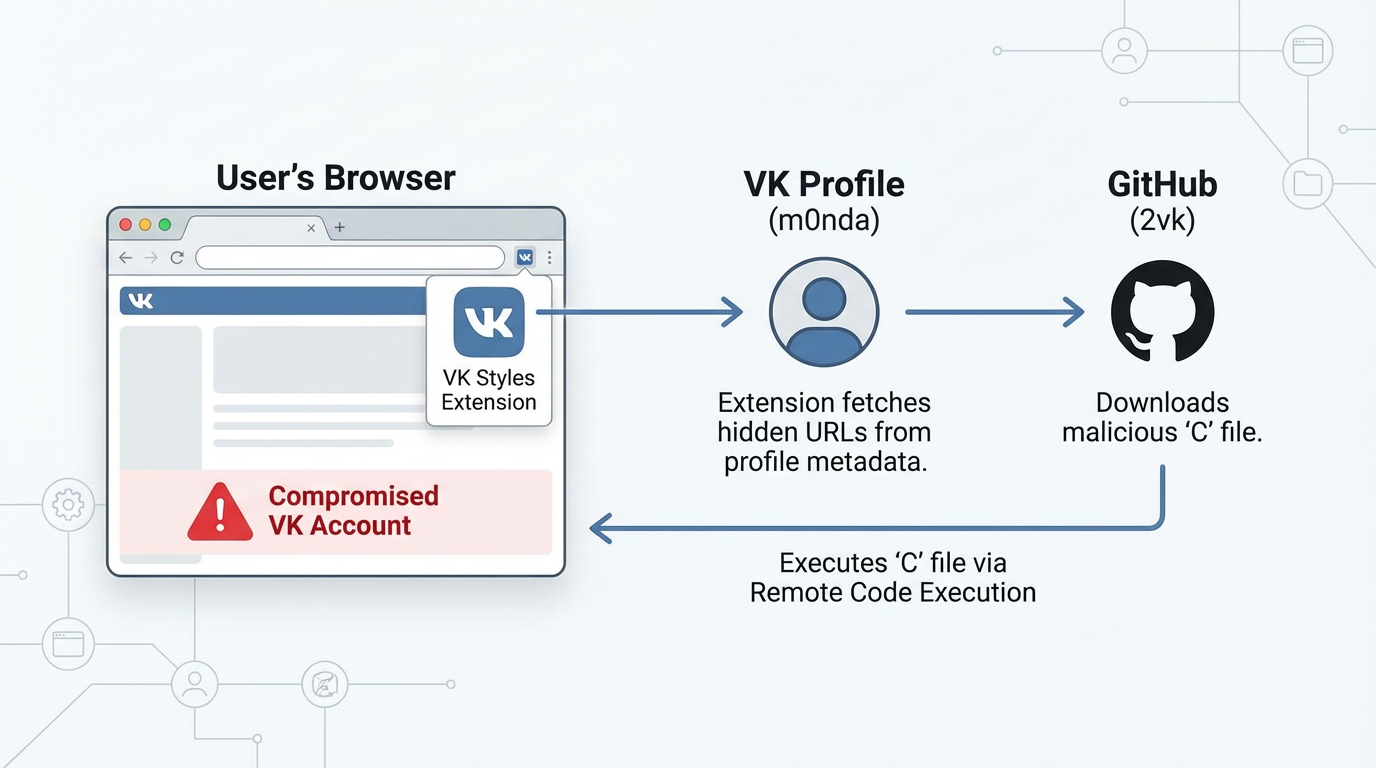

Архитектура оказалась многоступенчатой и довольно изобретательной. Расширение не содержало жёстко прописанных адресов серверов управления. Вместо этого оно обращалось к обычному профилю во «ВКонтакте» — vk.com/m0nda — и извлекало оттуда закодированные параметры из HTML-метатегов. Далее загружался следующий этап вредоносного кода с Pages (аккаунт 2vk, репозиторий с лаконичным названием «-»), а также подключались рекламные скрипты.

По сути, обычный VK-профиль выполнял роль командного центра (C2), а GitHub — площадки для размещения полезной нагрузки. Такая схема усложняет блокировку: трафик к VK и GitHub выглядит легитимным.

Кампания активна как минимум с июня 2025 года и эволюционировала до января 2026-го. По истории коммитов видно, что автор последовательно расширял функциональность: от манипуляций с CSRF-cookie и работы с VK API до автоматической подписки пользователей на нужную группу с вероятностью 75% при каждом заходе во «ВКонтакте».

В результате заражённые аккаунты автоматически вступали в группу -168874636 (сообщество VK Styles), которая сейчас насчитывает более 1,4 млн подписчиков. Кроме того, расширение каждые 30 дней сбрасывало настройки пользователя — сортировку ленты, тему сообщений и другие параметры, чтобы сохранять контроль.

Также код вмешивался в работу защитных механизмов VK, изменяя cookie remixsec_redir, что позволяло выполнять действия от имени пользователя так, будто они инициированы легитимно. Отдельный модуль отслеживал статус подписки VK Donut и в зависимости от этого активировал или ограничивал определённые функции, то есть схема имела и элемент монетизации.

Главная особенность кампании — гибкость. Поскольку логика загружалась динамически через профиль VK и GitHub, злоумышленник мог менять поведение аддона без обновления самого пакета в магазине. А так как Chrome-расширения обновляются автоматически, новая вредоносная логика быстро распространялась на сотни тысяч устройств.

Пресс-служба «ВКонтакте» прокомментировала:

«Все данные пользователей "ВКонтакте" надёжно защищены. Сторонние расширения не имеют доступа к персональной информации или управлению аккаунтом без согласия пользователя. Мы рекомендуем не устанавливать подобные сервисы и расширения для работы с социальной сетью: они могут использоваться недобросовестными разработчиками».