В первой бете iOS 26.6 нашли новое предупреждение для тех, кто особенно активно чистит своё цифровое окружение. Система теперь покажет отдельный алерт, если пользователь упрётся в лимит заблокированных контактов.

Apple публично не рассказывает, сколько именно номеров и контактов можно добавить в чёрный список. Но лимит в iOS есть, просто большинство людей до него, очевидно, не добирается. Хотя у кого-то, видимо, жизнь достаточно насыщенная.

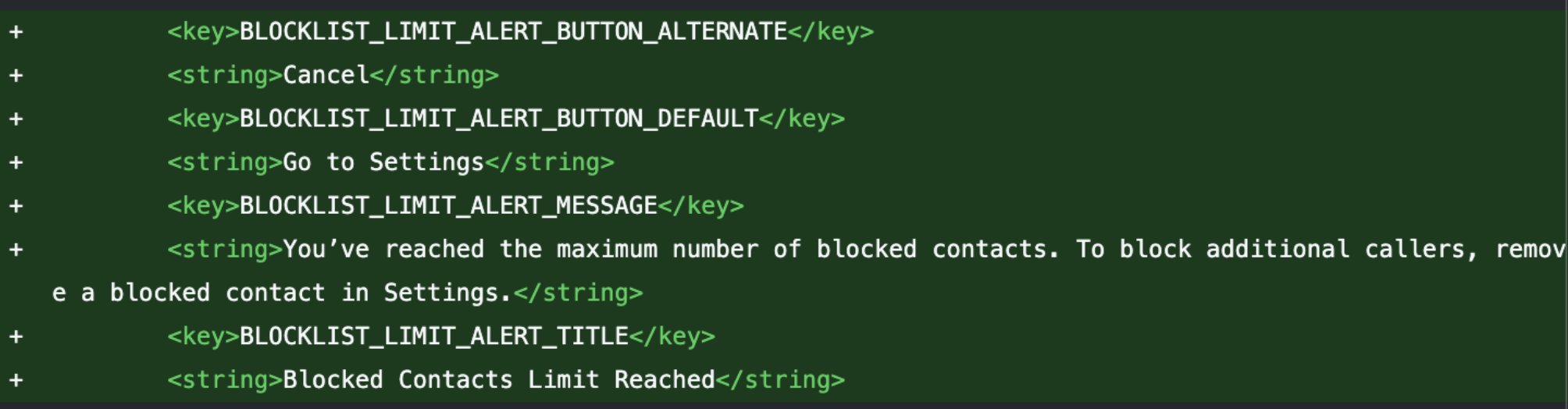

Новое сообщение обнаружил Аарон Перрис при изучении кода iOS 26.6 beta 1. В нём говорится, что пользователь достиг максимального числа заблокированных контактов. Чтобы заблокировать новых абонентов, придётся сначала удалить кого-то из списка в настройках.

Изменение маленькое, почти микроскопическое. Но для iOS 26.6 это пока чуть ли не единственная заметная пользовательская новинка: релиз выглядит блеклым и, судя по всему, больше похож на техническое обновление перед iOS 27.

В общем, если ваш список заблокированных контактов однажды переполнится, iPhone теперь хотя бы скажет об этом прямо.