Google решила навести порядок в одной из самых раздражающих мелочей при работе с VPN на Android. В Android 17 Beta 3 появится системный механизм для раздельного туннелирования (split tunneling) — исключения отдельных приложений из VPN-туннеля. В корпорации отмечают, что для этого в Android 17 вводится стандартизированный метод.

Для рядового пользователя это значит, что теперь можно будет оставить VPN включённым для всего смартфона, но при этом разрешить отдельным приложениям работать через обычный интернет.

Например, чтобы банковское приложение или стриминг не капризничали из-за VPN, а всё остальное продолжало ходить через защищённый канал. Такая проблема давно знакома пользователям Android, потому что многие приложения работают через VPN нестабильно или вообще отказываются запускаться.

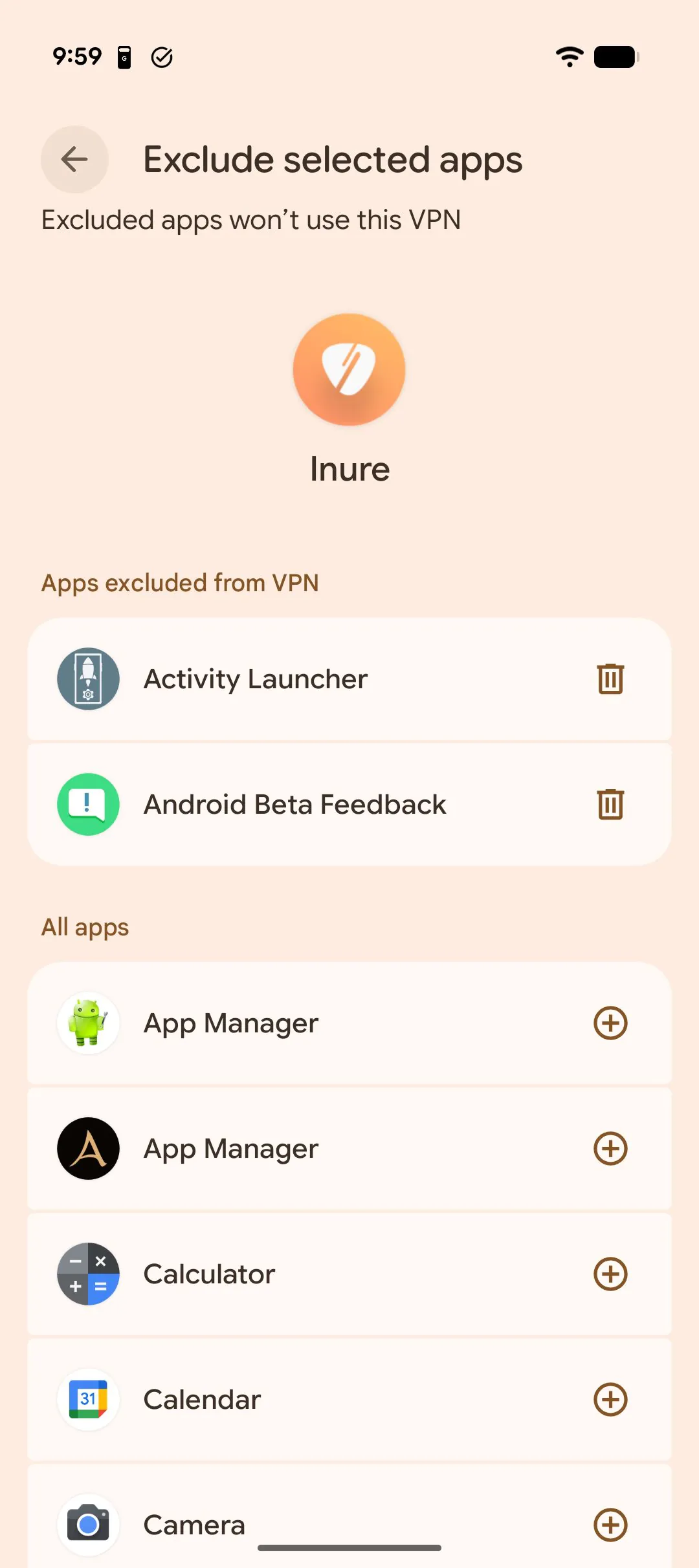

Сейчас split tunneling уже есть у многих популярных VPN-сервисов, но реализован он кто во что горазд. Где-то функция спрятана глубоко в настройках, где-то работает нестабильно, а где-то её вообще нет.

В Android 17 это хотят вынести на уровень самой системы: появится отдельный системный экран настроек, где можно будет выбрать приложения, которые должны обходить VPN. После этого изменения будут применяться сразу, если VPN уже активен, или при следующем подключении.

По сути, Google делает довольно простую, но очень практичную вещь: забирает важную функцию из разрозненных реализаций у разных VPN-разработчиков и пытается сделать её нормальной, предсказуемой и одинаково понятной для всех.