Эксперты «Информзащиты» выяснили, что большинство атак на киберфизические системы не требуют сложного взлома. В 78% случаев злоумышленники используют удалённый доступ к открытым интернет-ресурсам, часто без эксплуатации уязвимостей и многоходовых атак.

Сценарий простой: атакующий находит доступное из интернета устройство или промышленный интерфейс, подключается к нему через небезопасный протокол или удалённый доступ, а дальше смотрит параметры, конфигурации и при возможности меняет настройки.

Главная проблема в том, что многие киберфизические системы исторически проектировались для изолированных сред. Например, протоколы вроде Modbus изначально не содержат встроенных механизмов защиты. Если такие системы оказываются доступны из интернета, они становятся уязвимыми почти по умолчанию.

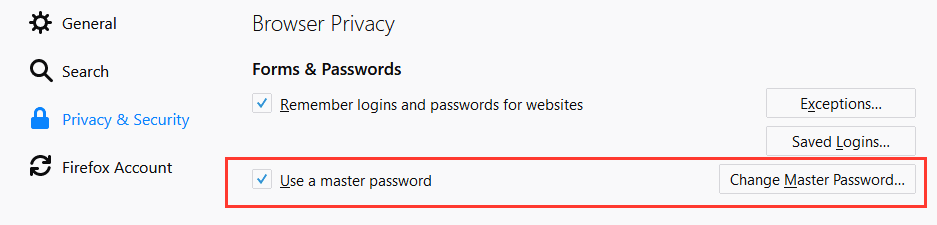

Дополнительный риск создают протоколы удалённого доступа, включая VNC. Они нередко остаются открытыми без нормальной аутентификации или работают со стандартными учётными данными. В итоге злоумышленнику не нужно ломать систему, достаточно найти её и подключиться.

По данным «Информзащиты», около 56% инцидентов связаны с компрометацией HMI и SCADA — систем, которые используются для управления промышленными процессами в реальном времени. Среди других целей — программируемые логические контроллеры, видеонаблюдение и другие подключённые устройства.

Чаще всего такие атаки фиксируются в отраслях, где автоматизация напрямую связана с непрерывной работой оборудования. На производство приходится 21% атак, на водоснабжение и водоотведение — 16%, энергетику — 13%, агропромышленный комплекс — 11%, нефтегазовую отрасль — 10%. Остальные случаи связаны с транспортом, медициной и коммерческими объектами с элементами автоматизации.

Эксперты отмечают, что традиционный фокус на патчах и устранении уязвимостей здесь помогает не всегда. Во многих случаях атакующим не нужно искать сложную брешь: доступ уже открыт, а защита настроена слабо или отсутствует.

Чтобы снизить риски, организациям советуют начать с базовых вещей: провести инвентаризацию всех активов с внешним доступом, убрать прямой выход OT-систем в интернет, сегментировать сеть, включить многофакторную аутентификацию для удалённого управления и отказаться от стандартных паролей.

Также важен отдельный мониторинг активности в OT-сегменте. Обычные средства защиты, рассчитанные на классическую ИТ-инфраструктуру, не всегда видят такие сценарии.

Если подход к эксплуатации устройств не изменится, в 2026 году доля атак через удалённый доступ может вырасти до 80–82%.