Windows 11 может стать заметно шустрее уже в июне 2026 года. Microsoft готовит крупное обновление производительности с функцией Low Latency Profile, которая должна ускорить запуск приложений и основные элементы системы: меню «Пуск», поиск и центр уведомлений.

Суть функции простая: когда пользователь открывает приложение или вызывает важный системный элемент, Windows на короткое время разгоняет частоту процессора.

Обычно речь идёт о всплеске на одну–три секунды. Приложение открывается быстрее, интерфейс меньше думает, а процессор затем возвращается в спокойный режим.

Нововведение уже появилось в сборке Windows 11 Build 26200.8514. В описании Microsoft не использует название Low Latency Profile, но прямо говорит об ускорении запуска приложений и ключевых элементов оболочки. Это означает, что до массового релиза осталось совсем немного.

Ожидается, что самые нетерпеливые пользователи смогут получить обновление уже с опциональным патчем в конце мая 2026 года. Для остальных функция должна приехать автоматически в рамках обязательного июньского набора патчей.

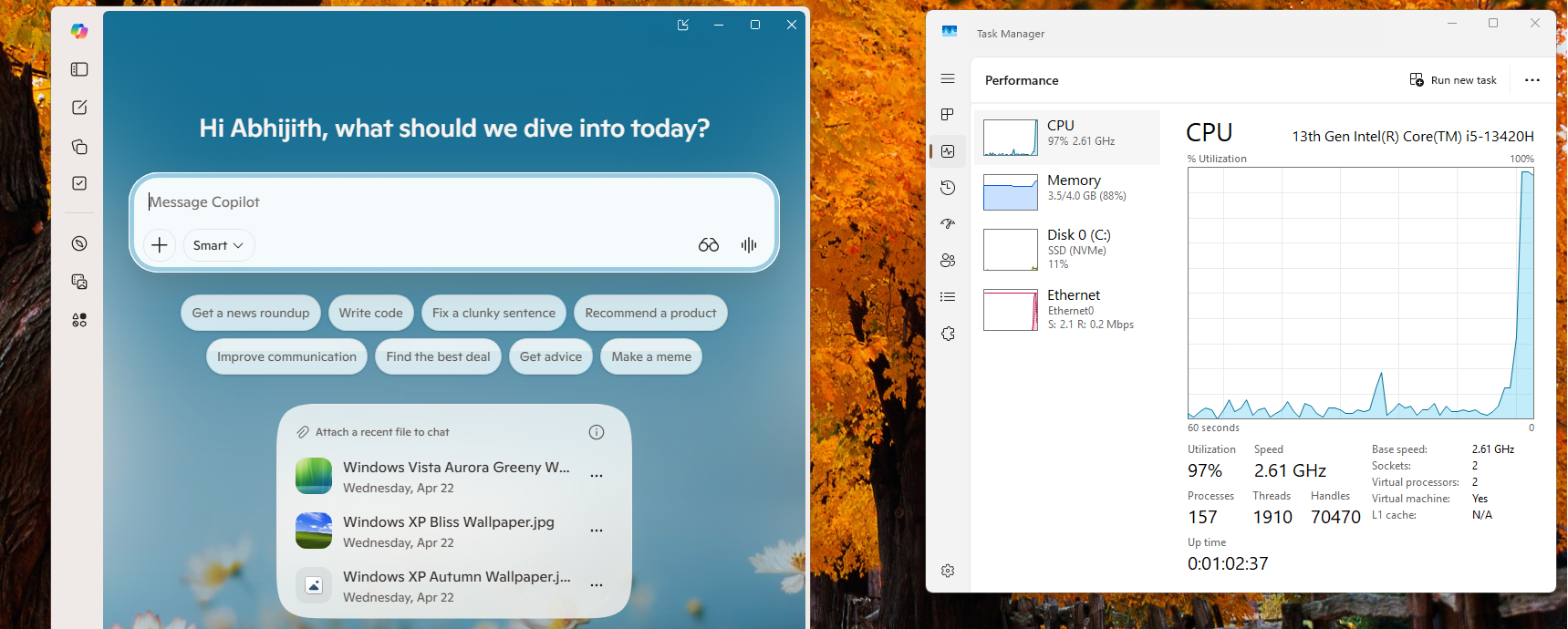

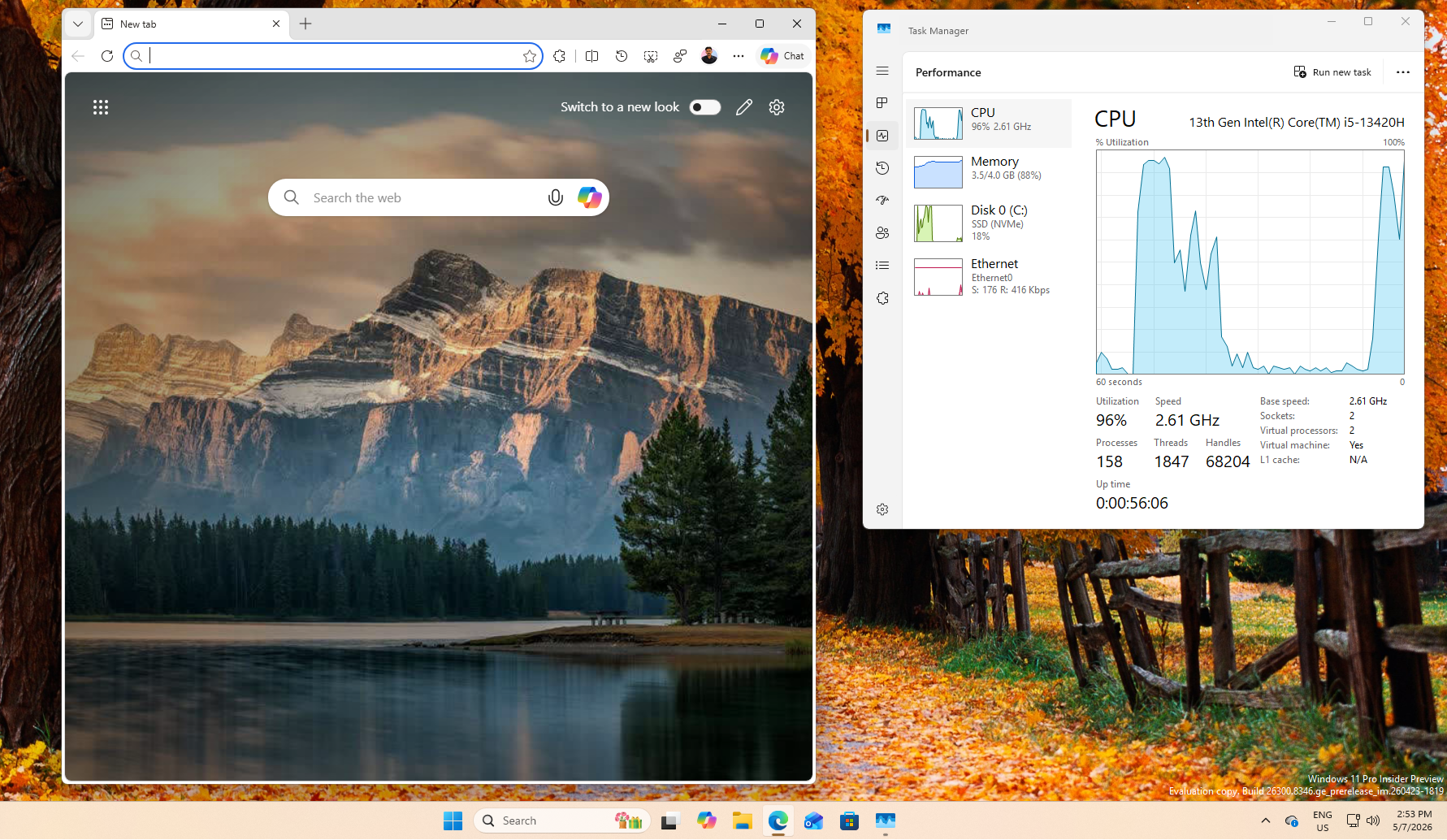

По данным Windows Latest, эффект заметен особенно хорошо на слабом железе. При тестировании на виртуальной машине с Intel Core i5, двумя ядрами и 4 ГБ оперативной памяти запуск Edge и Outlook сопровождался кратким скачком загрузки CPU почти до 96%, после чего приложения открывались быстрее, а процессор возвращался в простой примерно за три секунды.

Критики обвинили Microsoft в том, что компания не оптимизирует Windows, а просто лупит процессором по лагам. В ответ в Microsoft объяснили, что похожая логика race to sleep давно используется в macOS и Linux. Идея в том, чтобы быстро выполнить задачу на максимальной мощности и сразу вернуться к экономии энергии.

При этом Low Latency Profile — не единственная попытка ускорить Windows 11. Microsoft параллельно работает над оптимизацией WinUI 3, нативного интерфейсного фреймворка системы. Инженеры уже заявляли о снижении числа выделений памяти в Проводнике на 41% и сокращении времени выполнения WinUI-кода на 25%.