OpenAI недавно начала тестировать рекламу в ChatGPT для части пользователей бесплатного тарифа, и уже появились желающие быстро заработать на новой теме. Исследователи из DomainTools обнаружили в Chrome Web Store вредоносное расширение ChatGPT Ad Blocker, которое обещало убрать рекламу из чат-бота, а на деле воровало пользовательские переписки.

OpenAI действительно в последние месяцы начала тесты рекламы в ChatGPT для части пользователей Free и Go, поэтому приманка выглядела вполне правдоподобно.

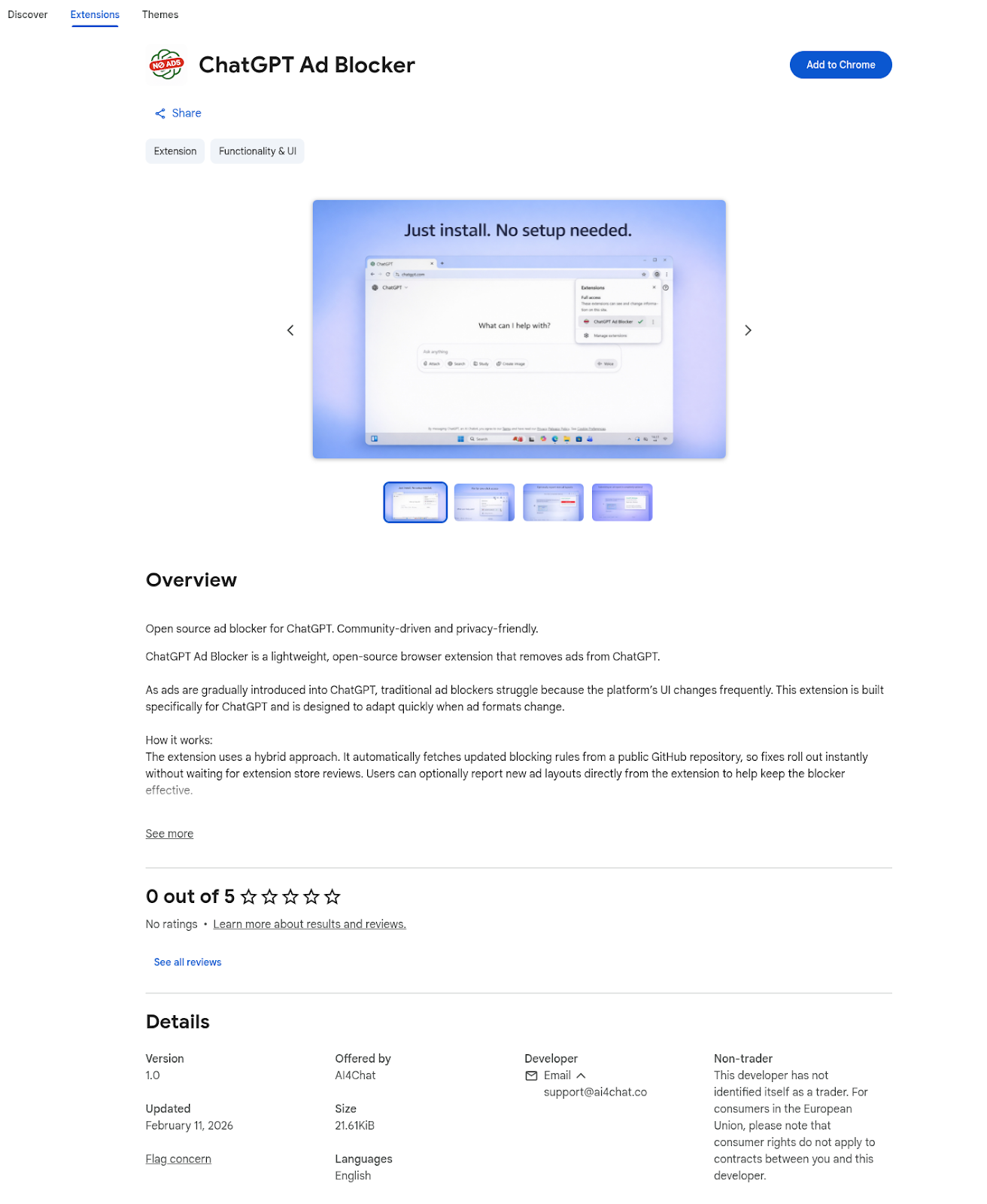

По данным DomainTools, расширение позиционировалось как «бесплатный и лёгкий» способ «убрать рекламу и оставить ИИ», но его основная задача была совсем другой.

После установки оно внедряло скрипт в страницу ChatGPT, копировало содержимое активного окна чата, сохраняло структуру переписки и большую часть текста, а затем отправляло этот дамп через жёстко прописанный Discord-вебхук в закрытый канал. Исследователи отдельно пишут, что таким образом утекали не только запросы пользователя, но и метаданные, и состояние интерфейса.

Аддон клонировал HTML страницы ChatGPT, убирал часть визуальных элементов вроде стилей и картинок, но оставлял текст и логику диалога. При этом редактировались только очень длинные текстовые фрагменты, а обычные промпты и ответы в большинстве случаев сохранялись целиком. DomainTools также указывает, что похищенные данные принимал Discord-бот с говорящим именем Captain Hook.

Отдельно исследователи связывают расширение с GitHub-аккаунтом krittinkalra, который, по их данным, пересекается с проектами AI4ChatCo и Writecream. На этом фоне авторы отчёта задаются вопросом: не используются ли похожие механики сбора данных и в других продуктах, связанных с этой же персоной. Прямых доказательств этого в отчёте нет, но сам сигнал имеется.