Фишинговая платформа Kali365, которую раньше связывали в основном с атаками на Microsoft 365, нарастила аппетиты. Теперь она целится не только в корпоративные аккаунты Okta и Microsoft, но и в пользователей российского мессенджера МАКС.

По данным исследователей Arctic Wolf, Kali365 превратилась в полноценную фишинговую экосистему с централизованной инфраструктурой, панелью управления, мониторингом кражи токенов в реальном времени и наборами страниц под разные сервисы.

Раньше схема была заточена под Microsoft 365: жертву заставляли пройти легитимный вход через механизм авторизации устройства, после чего токены доступа уходили атакующим.

Теперь же Kali365 пошла дальше. Исследователи нашли 126 вредоносных хостов с одинаковым фишинговым набором. Они маскируются под Okta SSO, Outlook, AWS-подобные сервисы, Xerox DocuShare, а также под российские площадки вроде Mail.ru, «Яндекс Диска» и «Одноклассников».

Но самая заметная новая цель — МАКС. Для него у атакующих появился отдельный фишинговый сценарий под видом проверки приза. Пользователю предлагают ввести российский номер телефона, после чего он получает настоящий одноразовый код от МАКС. Дальше всё по классике: фейковая страница просит ввести этот код, а при наличии двухфакторной защиты — ещё и дополнительный пароль.

Если человек ведётся, аккаунт можно увести за один заход. А вместе с ним сообщения, контакты и другие данные.

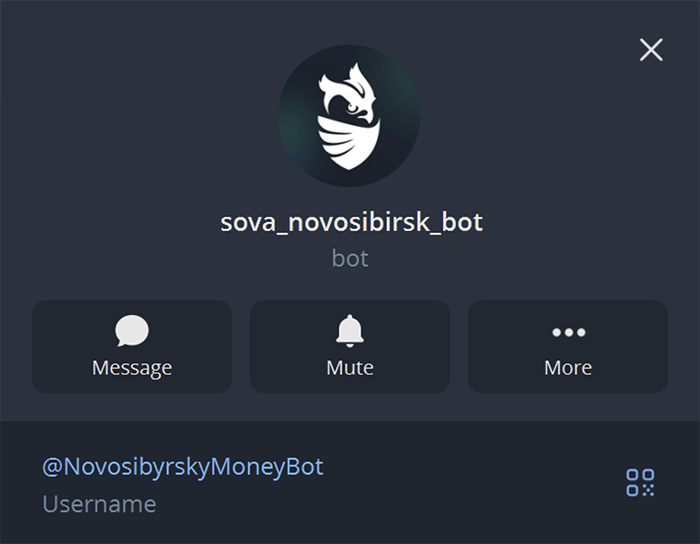

Украденная информация автоматически улетает Telegram-боту NovosibyrskyMoneyBot.

Опасность ещё и в том, что взломанные аккаунты МАКС могут использоваться для рассылки ссылок контактам жертвы.