У владельцев сайтов на WordPress новый повод проверить список установленных плагинов. Сразу десятки расширений оказались отключены после того, как в них нашли бэкдор, через который на сайты могла подгружаться вредоносная нагрузка.

По данным основателя Anchor Hosting Остина Гиндера, проблема затронула плагины разработчика Essential Plugin.

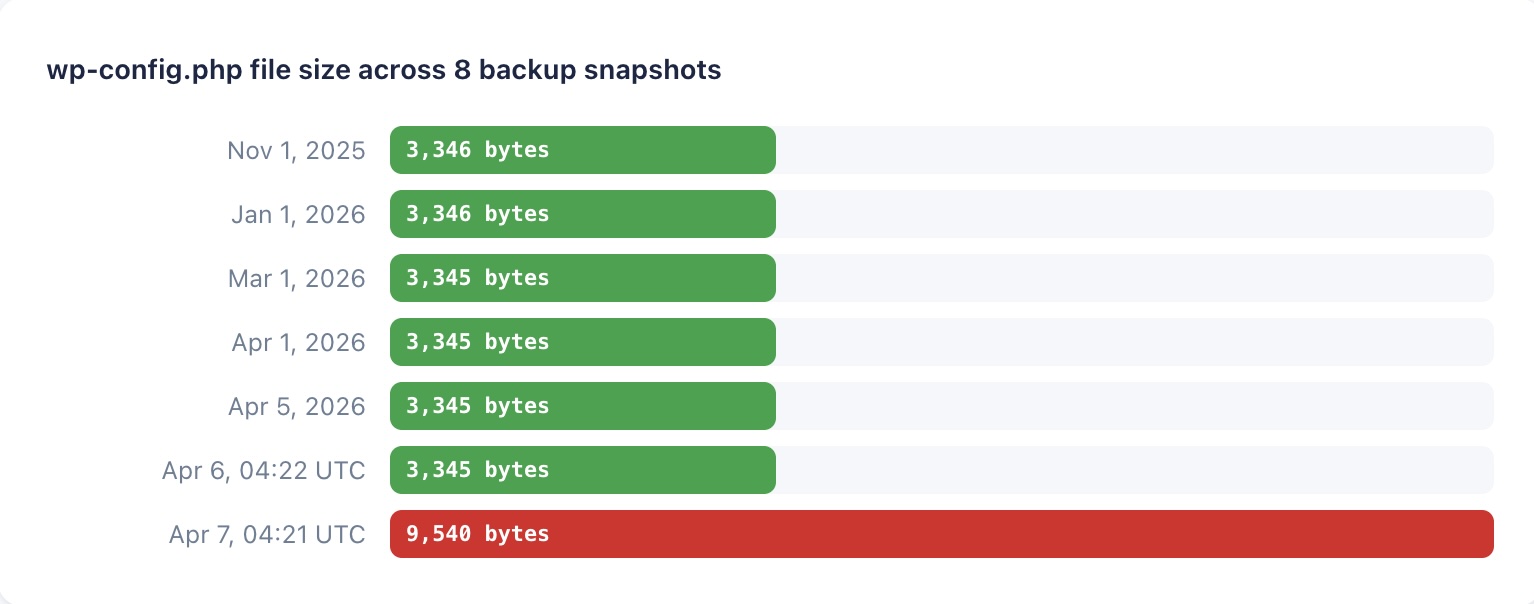

После смены владельца в исходный код этих расширений добавили скрытый вредоносный механизм. Несколько месяцев он никак себя не проявлял, а в начале апреля 2026 года активировался и начал использовать сайты с установленными плагинами для распространения вредоносного кода.

Масштаб истории неприятный. На сайте Essential Plugin говорится о 400 тысячах установок и более 15 тысячах клиентов, а данные каталога WordPress указывают, что затронутые плагины использовались как минимум на десятках тысяч активных сайтов. При этом WordPress уже пометил их как «permanent closure», то есть расширения убраны из каталога окончательно.

Особенно тревожно здесь то, что атака выглядела как классическая компрометация цепочки поставок. Пользователь ставит вроде бы привычный и рабочий плагин, а проблема появляется уже после того, как его купил новый владелец и изменил код. Гиндер отдельно обращает внимание, что WordPress не уведомляет администраторов сайтов о смене владельца плагина.

По данным The Next Web и Anchor Hosting, речь шла примерно о 30+ плагинах, а вредоносный код был внедрён ещё в августе 2025 года. Активировался он только спустя около восьми месяцев.