Google добавила в Android криптографически подтверждённые адреса электронной почты через Credential Manager API. Новая возможность должна упростить регистрацию, восстановление аккаунта и дополнительные проверки личности в приложениях.

Теперь пользователю не нужно переходить по ссылке из письма или вводить одноразовый код, чтобы подтвердить адрес.

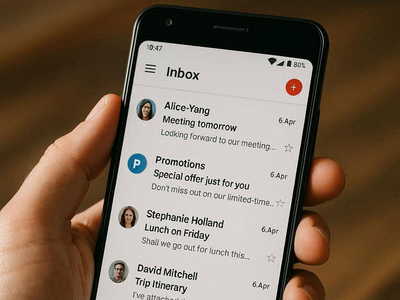

Если приложение запрашивает адрес электронной почты через Credential Manager API, Android показывает нативное нижнее окно с данными, например подтверждённым адресом электронной почты.

Пользователь проверяет запрос, нажимает «Согласиться и продолжить», после чего приложение сразу получает подтверждённый имейл.

По словам представителей Google Нихарики Ароры и Жан-Пьера Прале, такая интеграция делает проверку более естественной для и удобной пользователей.

Новая функция работает только с личными аккаунтами Google. Workspace-аккаунты и контролируемые учётные записи пока не поддерживаются. Для работы нужен Android 9 или новее, а также Google Play версии 25.49.x или выше. Поддерживаются смартфоны, планшеты и складные устройства.

Важно, что Google подтверждает только сам адрес электронной почты. Приложение может запросить и дополнительные данные (например, имя или фото профиля), но они уже не считаются проверенными.

Разработчикам также напоминают: приложение само решает, доверяет ли оно конкретному поставщику данных. В данном случае подтверждённый имейл берётся из Google-аккаунта на устройстве, но базовый Digital Credentials API не привязан только к Google и может работать с разными провайдерами.

Google рекомендует автоматически подтверждать пользователей с адресами @gmail.com, а владельцев кастомных доменов по-прежнему проводить через существующие сценарии проверки. Это позволит не ломать доступ для доменов, которыми Google не управляет.

При этом новая функция не заменяет «Войти с аккаунтом Google».