Оказывается, опасным USB-устройством может стать даже игровая колонка. Исследователь в области информационной безопасности Расмус Муратс обнаружил, что саундбар Creative Sound Blaster Katana V2X можно взломать по Bluetooth без сопряжения, проводов и какого-либо участия владельца с расстояния до 15 метров.

Проблема оказалась сразу в нескольких архитектурных решениях устройства. Через USB колонка требует аутентификацию перед выполнением команд, а вот через Bluetooth Low Energy те же самые команды принимаются без проверки и даже без процедуры сопряжения.

Фактически любой человек в радиусе действия Bluetooth может получить доступ к управлению устройством и загрузке новой прошивки.

Муратс выяснил, что прошивка саундбара не имеет цифровой подписи. Производитель проверяет лишь контрольную сумму файла, которую исследователь без труда пересчитал после внесения изменений. В результате он смог создать собственную прошивку и установить её на устройство по воздуху.

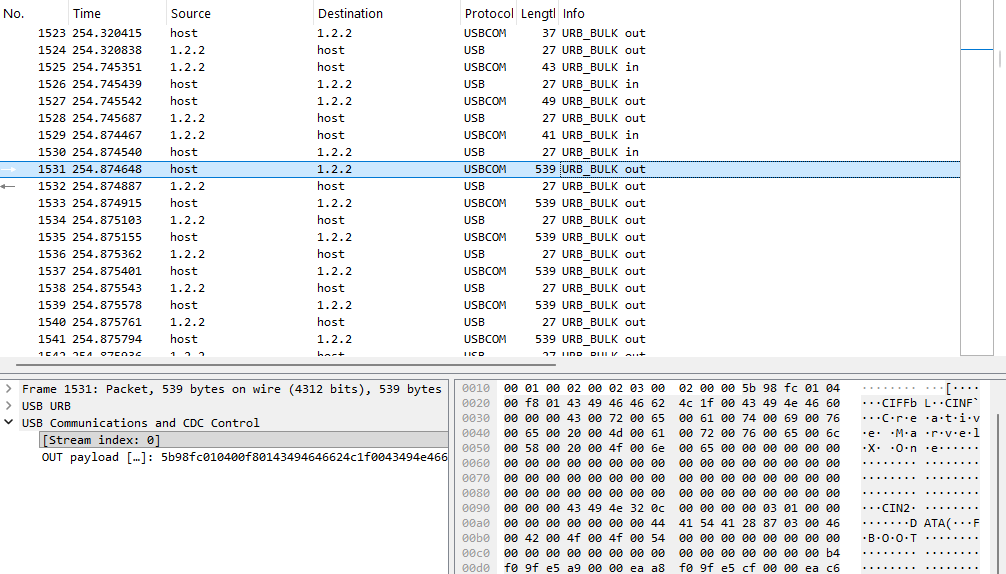

После перепрошивки колонка начала представляться компьютеру не только как аудиоустройство, но и как USB-клавиатура. При каждом подключении к десктопу она автоматически вводила заранее заданную команду. В демонстрационном варианте устройство печатало безобидное «echo pwned», однако аналогичным образом можно запускать PowerShell-скрипты или выполнять другие команды на компьютере жертвы.

По сути, речь идёт о классической атаке BadUSB, только без необходимости физически подменять устройство. Раньше злоумышленнику нужно было вручить жертве модифицированную флешку или периферию. Теперь достаточно перепрограммировать уже имеющийся у пользователя гаджет через Bluetooth.

Самым неожиданным оказался ответ Creative. По словам исследователя, компания почти два месяца не реагировала на уведомления об уязвимости, а затем заявила, что не считает обнаруженное поведение проблемой безопасности, поскольку оно не представляет киберриска.

Поскольку официальный патч так и не появился, Муратс выпустил собственный инструмент, который отключает опасный Bluetooth-интерфейс в прошивке устройства. Правда, такой способ может нарушить работу мобильного приложения Creative.

Тем временем Bluetooth-модуль саундбара продолжает работать даже в спящем режиме, а штатной возможности полностью отключить его пользователям не предоставили.