Как показал опрос, проведённый банком «Русский стандарт», 77% россиян не готовы платить за доступ к сервисам с искусственным интеллектом (ИИ). Регулярно оплачивают такие инструменты в общей сложности 12% респондентов. При этом 30% участников исследования заявили, что никогда не пользовались ИИ. В опросе приняли участие около 2 тыс. человек: клиенты банка и участники его групп в соцсетях.

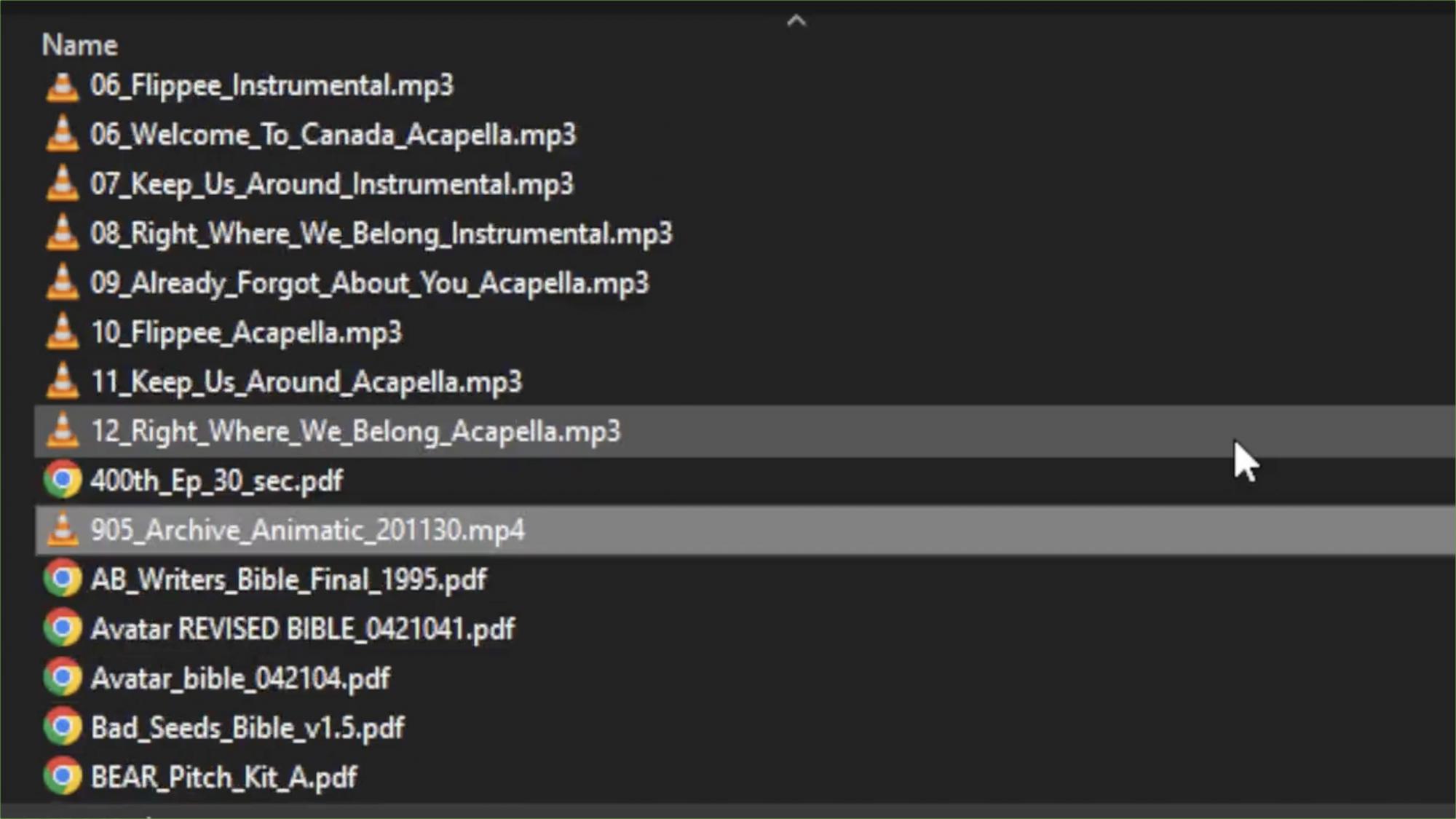

Результаты исследования банка «Русский стандарт» оказались в распоряжении ТАСС. Также были проанализированы платежи по картам кредитной организации, связанные с покупкой цифровых товаров, за начало 2026 года и аналогичный период 2025 года.

Согласно результатам опроса, 77% респондентов хотели бы научиться работать с ИИ. При этом 43% намерены активно использовать соответствующие инструменты, а чуть более трети (34%) хотят изучить ИИ в простом формате. Не планируют осваивать такие технологии 22% опрошенных.

О хорошем понимании ИИ и регулярном использовании таких инструментов заявили 21% участников исследования. Ещё 47% обращаются к ним время от времени, а 30% сообщили, что лишь слышали об ИИ-сервисах, но никогда ими не пользовались.

Регулярно оплачивают использование ИИ-сервисов 12% респондентов: 3% делают это ежегодно, 9% – ежемесячно. Ещё 11% заявили, что платят за такие инструменты ситуативно, для решения конкретных задач. Не готовы платить за ИИ-сервисы 77% участников опроса.

Почти каждый пятый респондент (19%) использует ИИ для написания текстов. Для поиска и анализа данных такие инструменты применяют 16% опрошенных, ещё 15% генерируют с их помощью идеи.