Пользователям Android снова напомнили, что даже официальный магазин приложений не всегда гарантирует безопасность. Специалисты «Доктор Веб» обнаружили семейство троянов Android.MagicAd, которое научилось показывать рекламу поверх других приложений, обходя встроенные защитные механизмы операционной системы.

Особенность Android.MagicAd в том, что он действует максимально скрытно. Вредоносный код хранится внутри зашифрованных нативных библиотек и расшифровывается только во время работы приложения.

Перед активацией троян проверяет окружение: ищет признаки виртуальных машин, анализирует способ установки приложения и даже проверяет IP-адрес устройства. Если всё выглядит безопасно для злоумышленников, вредонос приступает к работе.

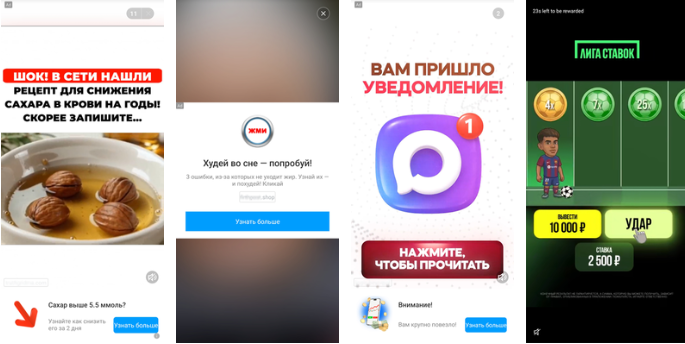

После запуска Android.MagicAd скрывает свою иконку, создаёт фоновые службы и начинает демонстрировать рекламные баннеры. Причём делает это без разрешения SYSTEM_ALERT_WINDOW, которое обычно требуется для вывода окон поверх других приложений.

Вместо этого троян использует целый набор нестандартных приёмов. Например, на устройствах Xiaomi он взаимодействует с браузером Mi Browser и компонентами MIUI, на смартфонах Vivo использует системные сервисы через механизм Binder, а на устройствах Amazon эксплуатирует домашний экран Fire TV.

Есть и универсальный метод. Вредонос запускает медиаплеер с практически нулевой громкостью, имитирует нажатие мультимедийных кнопок и использует системные механизмы управления воспроизведением как точку входа для показа рекламы. Со стороны всё выглядит как обычная работа мультимедийных функций Android.

По данным Doctor Web, заражённые приложения распространялись через официальный магазин Xiaomi GetApps, а также были замечены в Samsung Galaxy Store. Всего исследователи насчитали более 50 вредоносных приложений.

Авторы кампании старались не привлекать лишнего внимания. Приложения появлялись в магазинах на ограниченное время, затем удалялись и заменялись новыми программами от тех же разработчиков. Такой подход позволял поддерживать заражения и одновременно снижать риск обнаружения.

На данный момент вредоносные приложения уже удалены из каталогов, а связанные с ними учётные записи разработчиков перестали публиковать новые программы. Однако установленные ранее копии продолжают работать на устройствах пользователей.