У Adobe есть база данных Elasticsearch, содержащая 7,5 миллионов записей, принадлежащих пользователям Adobe Creative Cloud. Кеш этой базы никак не был защищён, что позволяло любому получить доступ к информации клиентов. Нужно было только знать, где искать.

Справедливости ради стоит отметить, что пользовательские данные не были слишком конфиденциальными, однако с их помощью злоумышленники могли бы организовать более продуманные фишинговые кампании.

Боб Дьяченко, исследователь в области безопасности, заявил, что пользовательская информация лежала открытой около недели. Специалист сообщил Adobe о проблеме ещё 19 октября, в тот же день компания приняла меры.

Команда Comparitech утончила, что паролей или платёжной информации в открытом доступе не было.

На сегодняшний день непонятно, нашёл ли кто-нибудь БД с данными пользователей. Но если всё же злоумышленники вышли на базу, они точно попытаются организовать кампанию целевого фишинга.

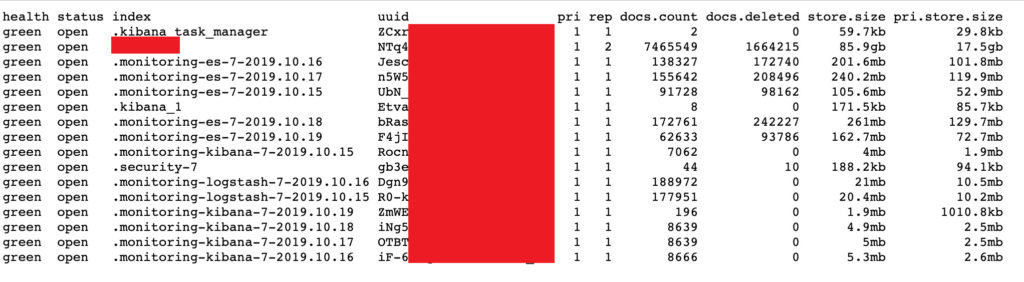

По словам обнаруживших утечку экспертов, размер базы кеша был близок к 86 Гб.

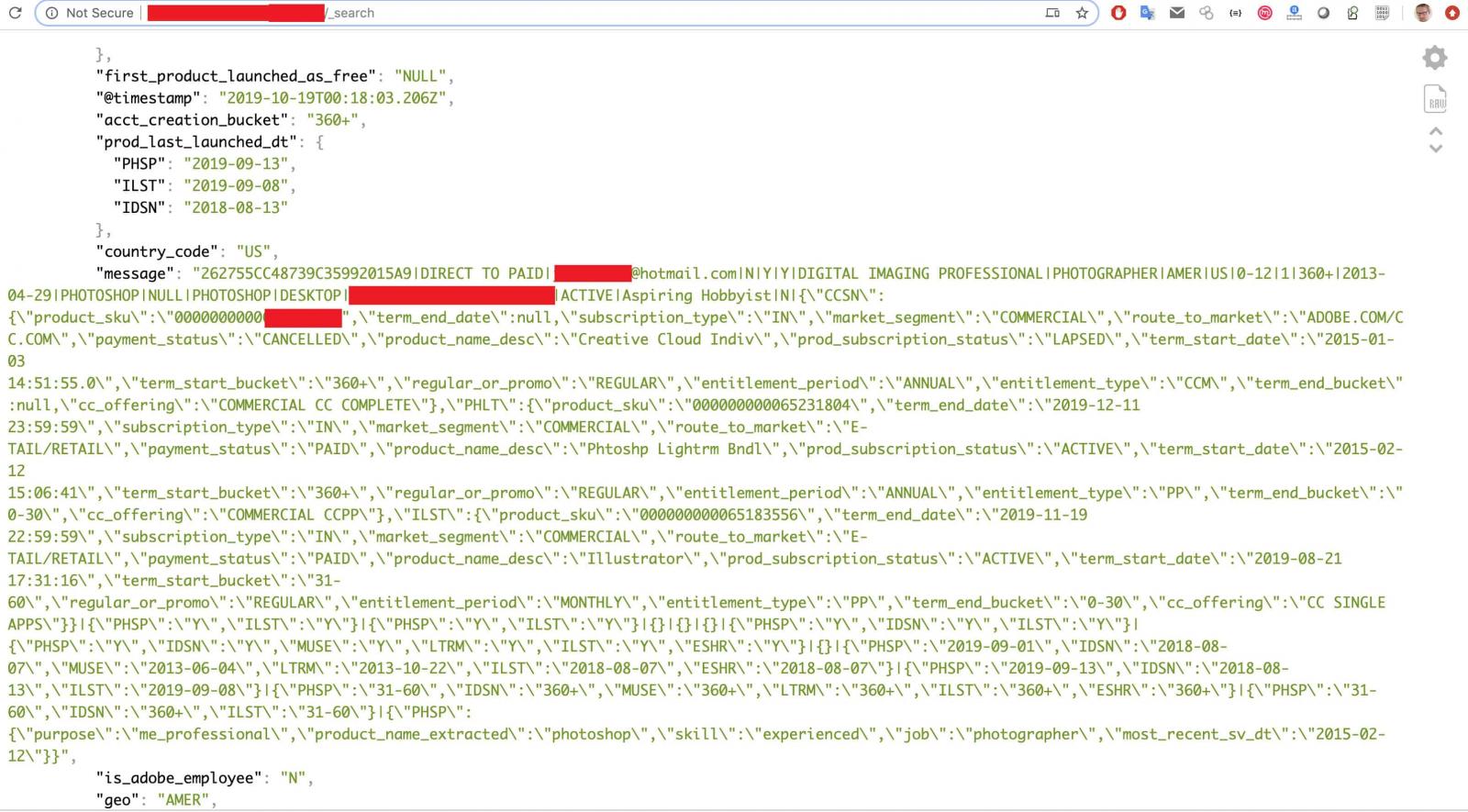

Дьяченко поделился скриншотом, на котором видно, какие именно данные лежали открытыми: адреса электронной почты, дата создания аккаунта, используемые клиентом продукты и статус оплаты.

Помимо этого, была и менее важная информация: статус подписки, является пользователь сотрудников Adobe, идентификатор пользователя, страна проживания и время последнего входа в учётную запись.

Сама компания уже успела опубликовать официальное заявление, в котором объясняется, что база данных была частью прототипа окружающей среды.