Вчера, 2 апреля, Брайан Крэбс опубликовал в своем блоге krebsonsecurity материал, в котором сайт PaneraBread.com обвиняется в утечке персональных данных клиентов. По последним подсчетам количество учетных данных превышает 37 миллионов. После публикации сайт находится в оффлайн-режиме.

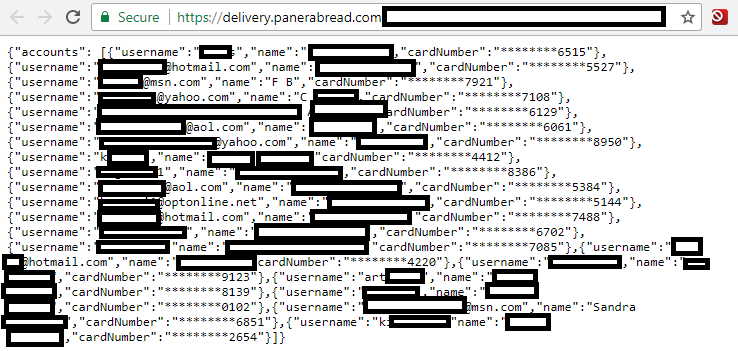

На сайте онлайн-пекарень информация о клиентах - имена, адреса электронной почты и физические адреса, дни рождения и последние четыре цифры номера кредитной карты клиента, были доступны в виде обычного текста. В их список попали клиенты, которые оформили онлайн заказ.

Первая утечка информации произошла как минимум восемь месяцев назад, когда её впервые заметил эксперт по информационной безопасности Дилан Хулихан. Он сообщил об этом сайту, на что ему ответили обещанием исправить ситуацию в ближайшее время. И все это время, как сообщил Хулихан Крэбсу, база данных клиентов только увеличивалась, а утечка не прекращалась.

Некоторые записи клиентов включают в себя уникальные идентификаторы, которые увеличиваются на единицу при каждой новой записи, что делает её простой для того, чтобы кто-то мог собрать все доступные учетные записи клиентов. Формат базы данных также позволяет любому пользователю искать различные точки данных, в том числе по номеру телефона.

Наибольшая угроза состоит в том, что информацию о клиентах можно проиндексировать и отсканировать с минимальными усилиями.

«Panera Bread использует последовательные целые числа для идентификаторов учетных записей, а это означает, что если ваша цель состоит в том, чтобы собрать как можно больше информации, а не найти конкретно чью-то, то вы можете собрать сколько пожелаете, вплоть до всей базы данных », - сказал Хулихан.

После публикации Крэбса и до сих пор сайт PaneraBread неактивен.