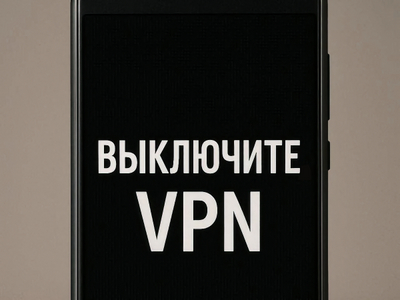

На портале «Госуслуги» появится специальная кнопка, с помощью которой пользователи смогут пожаловаться на всплывающее сообщение с просьбой отключить VPN, даже если VPN у них не используется. Об этом сообщило Минцифры в своём канале в мессенджере «Максе».

В министерстве отметили, что такая кнопка появится «в ближайшее время». Она должна помочь пользователям быстрее сообщать о случаях, когда сервис ошибочно определяет подключение как VPN-соединение и ограничивает доступ.

Также в Минцифры заявили, что большинство российских сервисов ограничивают доступ для пользователей с включённым VPN. Если предупреждение об установленном VPN появляется ошибочно, ведомство советует обращаться в поддержку конкретного сервиса.

По версии Минцифры, ограничения вводятся для защиты данных, которые пользователи вводят на сайтах и в приложениях. В министерстве считают, что многие VPN-сервисы не обеспечивают должную защиту конфиденциальности и персональных данных, а злоумышленники могут использовать их для перехвата трафика и информации.

Таким образом, новая кнопка на «Госуслугах» должна стать способом быстро сообщать о ложных срабатываниях. Особенно это может быть полезно тем, кто находится за границей или сталкивается с ограничениями доступа без фактического использования VPN.

Напомним, ранее в Роскомнадзоре заявили, что корпоративный VPN внутри России пока никто не отменяет. По данным ведомства на 22 апреля 2026 года, использование VPN российскими компаниями для внутренних рабочих задач не ограничивается.