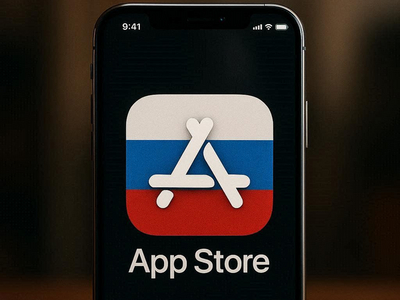

У Apple в России может появиться ещё одна точка давления. В Минцифры на совещании с операторами «большой четвёрки» 28 марта обсуждали возможность временно приостановить оплату сервисов Apple со счёта мобильного телефона. Идея в том, чтобы подтолкнуть компанию к возвращению популярных российских приложений в App Store.

Как утверждает источник РИА Новости, речь идёт о попытке повлиять на Apple через деньги: если ограничить один из привычных способов оплаты, потери для компании могут оказаться достаточно чувствительными, чтобы она стала активнее исполнять требования российского законодательства.

В качестве претензий к Apple собеседник агентства перечислил сразу несколько тем. Во-первых, с 2022 года компания, по его словам, удалила из App Store десятки российских приложений — в том числе банковские, картографические, авиационные сервисы, классифайды и агрегаторы.

Во-вторых, Apple, как утверждается, не исполняет решение ФАС по так называемому «окну выбора» поисковика по умолчанию на iPhone и iPad.

Кроме того, источник РИА Новости заявил, что компания по-прежнему не выполняет требование о возможности установки российского магазина приложений RuStore на устройства Apple.

Ещё одна претензия касается VPN-приложений: по словам собеседника агентства, Apple не в полной мере исполняет требования Роскомнадзора по их удалению из российского App Store. При этом тема VPN для регулятора остаётся чувствительной уже не первый год.

Пока речь идёт именно об обсуждении возможной меры, а не о принятом решении. Но сам факт появления такого сценария показывает, что спор вокруг App Store, российских приложений и правил работы Apple в стране явно выходит на новый уровень.

Если эту идею всё же доведут до реализации, для пользователей это может означать новые ограничения при оплате сервисов Apple через мобильный счёт. А для самой компании — ещё один сигнал, что вопросы локального регулирования в России всё труднее игнорировать.