Пока Microsoft всё сильнее привязывает пользователей Windows к своей экосистеме, энтузиасты продолжают искать обходные пути. На этот раз обновление получил инструмент OfflineInsiderEnroll, который позволяет устанавливать предварительные сборки Windows без входа в учётную запись Microsoft.

Обычно для участия в программе Windows Insider требуется зарегистрироваться через аккаунт Microsoft и официально подключить устройство к одному из тестовых каналов. Но OfflineInsiderEnroll предлагает альтернативный сценарий.

Утилита представляет собой небольшой скрипт, который настраивает необходимые параметры локально через системный реестр. После этого компьютер получает доступ к тестовым версиям Windows через обычный механизм Windows Update, как будто устройство официально участвует в программе предварительного тестирования.

В основе схемы лежит параметр реестра TestFlags. Если установить для него значение 0x20, Windows перестаёт обращаться к онлайн-сервисам регистрации Insider Program.

Благодаря этому локальные настройки больше не перезаписываются серверами Microsoft, а выбранный канал тестирования сохраняется на устройстве.

Проще говоря, система начинает верить настройкам, которые ей подсовывает сам скрипт.

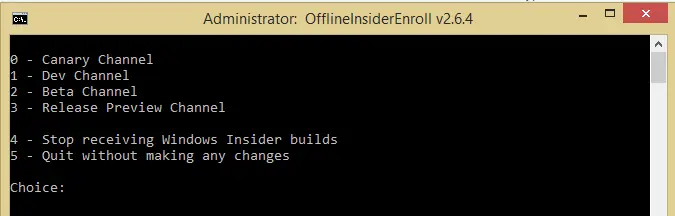

Ранее OfflineInsiderEnroll уже поддерживал классические каналы Dev, Beta и Release Preview. Теперь разработчики обновили утилиту до версии 2.6.6 и добавили поддержку новой структуры каналов Windows Insider, которую Microsoft недавно начала внедрять.

Помимо Beta и Release Preview пользователи получили доступ к новым экспериментальным каналам тестирования. Также в комплекте остались инструменты для очистки кеша Insider, сброса настроек и полного отключения участия в программе.

Впрочем, запускать скрипт придётся с правами администратора.