Исследователи показали новый вектор атаки на мощные GPU от Nvidia: бреши класса Rowhammer теперь могут использоваться не только против обычной оперативной памяти, но и против видеопамяти GDDR6. В некоторых сценариях атакующий может добраться до памяти хост-машины и получить root-доступ к системе.

Напомним, Rowhammer — это класс атак, при котором многократные обращения к определённым участкам памяти вызывают битовые сбои в соседних ячейках.

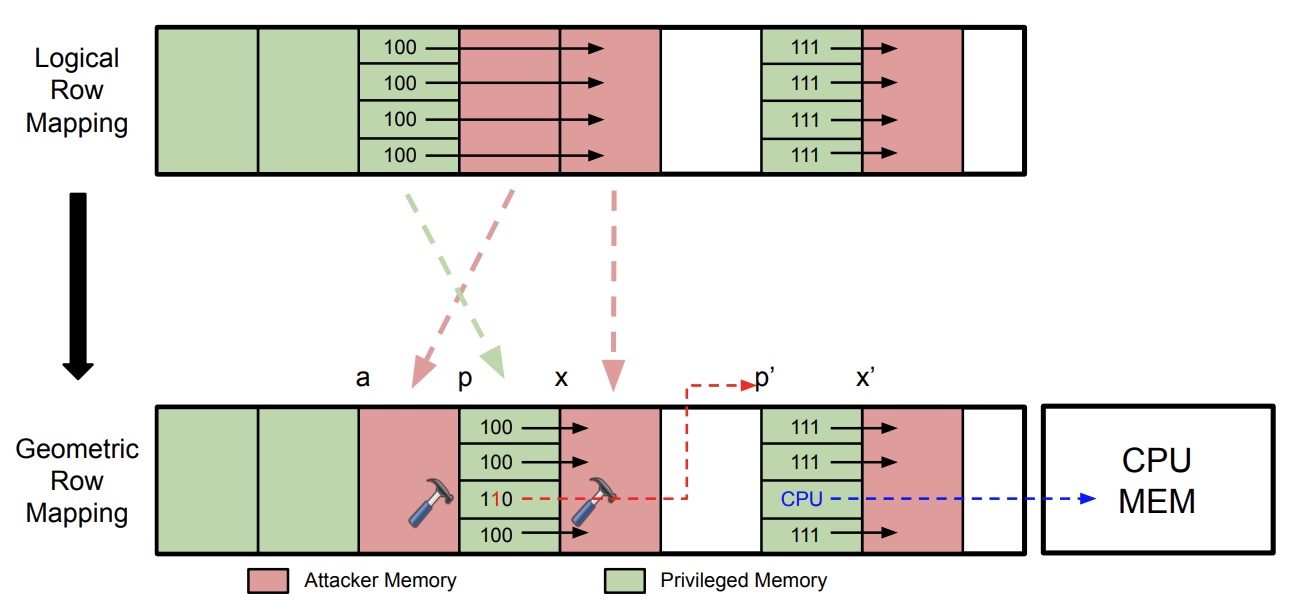

Долгое время такие атаки в основном ассоциировались с CPU и DRAM, но теперь две независимые исследовательские группы показали (PDF), что похожая логика работает и с GPU-памятью Nvidia поколения Ampere. В центре внимания оказались две техники — GDDRHammer и GeForge.

Первая атака, GDDRHammer, была продемонстрирована против Nvidia RTX 6000 на архитектуре Ampere. Исследователи утверждают, что смогли многократно повысить число битовых сбоев по сравнению с более ранней работой GPUHammer 2025 года и добиться возможности читать и изменять GPU-память, а затем использовать это для доступа к памяти CPU.

Вторая техника, GeForge сработала против RTX 3060 и RTX 6000 и завершалась получением root на Linux-хосте.

Ключевой момент здесь в том, что атака становится особенно опасной, если IOMMU отключён, а это, как отмечают исследователи, во многих системах остаётся настройкой по умолчанию ради совместимости и производительности.

При включённом IOMMU такой сценарий существенно осложняется, потому что он ограничивает доступ GPU к чувствительным областям памяти хоста. В качестве ещё одной меры снижения риска исследователи и Nvidia указывают ECC, хотя и он не считается универсальной защитой от всех вариантов Rowhammer.

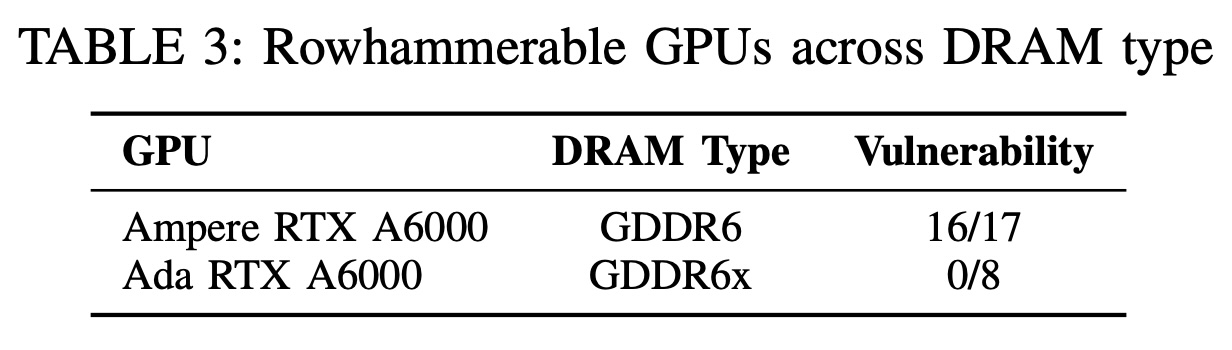

На сегодня подтверждённая уязвимость касается прежде всего Ampere-карт RTX 3060 и RTX 6000 с GDDR6, а более ранняя работа GPUHammer фокусировалась на NVIDIA A6000.

Для более новых поколений, вроде Ada, в этом материале рабочая эксплуатация не показана. Кроме того, исследователи прямо отмечают, что случаев реального использования это вектора в реальных кибератаках пока не известно.