Приход эры Agentic AI породил мнение, что ИИ способен потеснить или даже заменить человека. Чем человек отличается от ИИ? Можно ли перенести на ИИ требования, предъявляемые к деятельности человека? Что сдерживает рост производительности? Вводят ли вендоры ограничения для ИИ? Ответы на эти вопросы имеют важное значение для многих.

- 1. Введение

- 2. Риск уничтожения рыночной конкуренции с приходом ИИ

- 3. Признаки отличий человека и ИИ

- 3.1. Принятие решений

- 3.2. Креативность совершаемых действий

- 3.3. Техника обучения

- 3.4. Решение задач повышенной сложности

- 3.5. Обеспечение эффективности при решении прикладных задач

- 3.6. Создание нового контента

- 3.7. Интеллект и эмоции

- 3.8. Учёт социальных связей

- 3.9. Формирование доверия

- 3.10. Восприятие информации

- 4. Где источник риска?

- 5. ИБ-риски в новой реальности

- 6. Всё ли так безнадёжно?

- 7. Как идти вперёд?

- 8. Выводы

Введение

Предыдущий материал об открытии компанией UserGate сертифицированного образовательного центра в Москве на базе собственной академии uAcademy заставил задуматься о том, какое образование необходимо в эпоху Agentic AI. Нужно ли заниматься подготовкой специалистов, если ИИ-агенты скоро смогут решать конкретные задачи ИБ быстрее, чем это делает человек?

Новые агентные ИИ-системы работают иначе. Они научились «рассуждать», «планировать», запускать вспомогательные инструменты, извлекать знания из предоставленных источников, оценивать результаты своей работы, взаимодействовать с другими ИИ-агентами. Это касается всех привычных областей применения — SOC/ИБ, DevOps, автоматизации процессов, — но по сути является продолжением прежнего сценария взаимодействия «человек — ИИ», где место человека занимает ИИ-агент, наделённый возможностями и навыками, не уступающими человеческим. Звучит впечатляюще, но так ли это на самом деле? Может ли ИИ-агент полностью заменить человека?

Анализ этой проблемы показывает, что всё не так однозначно. Во-первых, для эксплуатации ИБ-систем необходимо не только поставить задачу, но и контролировать её корректное выполнение. Компаниям требуется подтверждать, что используемое ИБ-решение продолжает работать так же эффективно, как и раньше. Для этого необходимо адекватно оценивать текущую ситуацию и то, насколько система действительно обеспечивает безопасность. Средства ИИ доступны всем участникам процесса, в том числе злоумышленникам. ИИ помогает не только искать ответы на вопрос, как защищать, но и как атаковать.

Уже известно, что при ИИ-автоматизации может возникать эффект «ожирения от ИИ» (AI obesity). Речь идёт о ситуации, когда у человека появляется чрезмерная зависимость от использования ИИ в ущерб собственным возможностям. Между тем именно человек способен пытаться предугадать действия злоумышленников, а не только выстраивать защитные барьеры.

Возникает также риск «выхода ИИ из-под контроля», когда человек формально сохраняет за собой право отключить ИИ в случае обнаружения ошибок в его работе, но уже не понимает или не может оценить последствия такого отключения. Подобная проблема давно проявилась при сравнении концепций работы автопилотов в самолётах Boeing и Airbus, где реализованы принципиально разные подходы. Окончательного ответа на вопрос, какой из них лучше, до сих пор нет.

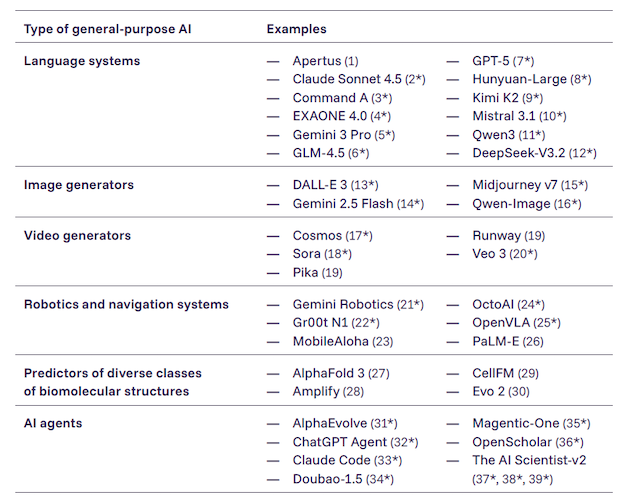

Однако риски для ИБ при замене человека ИИ этим не ограничиваются. Существует ещё множество других вопросов. Например, можно ли использовать единую концепцию ИИ для построения всех ИИ-систем, если уже сейчас выявлено несколько различных типов таких систем?

Рисунок 1. Разные типы ИИ-систем общего назначения

Риск уничтожения рыночной конкуренции с приходом ИИ

Коснёмся ещё одной проблемы экономических взаимоотношений, связанных с распространением ИИ. Этот серьёзный риск возник как минимум с появлением генеративного ИИ (Generative AI, GenAI), а его масштабы пока ещё недостаточно оценены. Суть проблемы заключается в том, что возникает риск разрушения привычной модели конкуренции, при которой каждая компания получает преимущества благодаря уникальным компетенциям, основанным на конкретных людях, их участии, авторских правах и т. д. Приход ИИ существенно меняет эту картину.

Дело в том, что ИИ предоставляет всем желающим широкий доступ к одним и тем же знаниям, навыкам, инструментам и даже идеям. Все получают практически равный доступ к общему массиву знаний и компетенций. В результате начинает разрушаться механизм экспертности в отрасли. До сих пор компании отличались друг от друга тем, что использовали труд и способности профессионалов, обладающих собственным, зачастую уникальным набором навыков, таланта и видением рынка. Именно на использовании талантов строится бизнес и достигается успех. В результате каждая компания создаёт собственный персонализированный продукт.

Возьмём для примера UserGate NGFW. Этот продукт не равнозначен Kaspersky NGFW или PT NGFW от Positive Technologies, хотя все они относятся к одному классу решений. Каждый вендор обладает собственным набором приоритетов и экспертизы, своим пониманием траектории развития продукта и видением рынка. В итоге в одной области появляются разные продукты.

Но ИИ меняет такой подход. Он даёт всем вендорам возможность практически равного доступа к данным, алгоритмам и ИИ-платформам. Различия в возможностях компаний и конкурентные преимущества начинают исчезать — по крайней мере на концептуальном уровне.

Компании уже осознали появление этой проблемы и начали бороться с утечками экспертизы и данных через ИИ. Однако ИИ одновременно ускоряет разработку и повышает скорость обновления продуктов. В результате, когда все внедряют ИИ и используют одинаковые доступные ИИ-инструменты, развитие дополнительных навыков, помимо тех, что генерирует ИИ, начинает замедляться. Компании перестают добавлять что-то принципиально новое к результату. Вся ответственность за появление инноваций постепенно перекладывается на вендоров ИИ-платформ. Дифференциация продуктов в таких условиях может достигаться только за счёт расширения возможностей ИИ, особенно если компании ограничивают передачу новых знаний конкурентам.

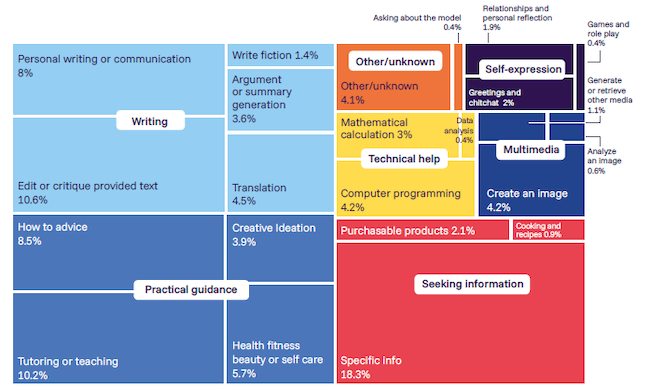

Рисунок 2. Рост качества ИИ-картинок в 2022–2025 гг. (International AI Safety Report, 2026)

Признаки отличий человека и ИИ

Мы вплотную подошли к главному вопросу: в чём разница между человеком и ИИ?

Формально ИИ-система «имитирует» эксперта-человека: человек задаёт ей задачу — пишет промпт — и быстро получает результат. Разница лишь в том, что с одной стороны взаимодействия находится не человек, а ИИ.

Однако такая подмена не является равноценной. Это особенно заметно в ситуациях, связанных с прикладным применением. Далее приведём примеры, собранные в классификации из книги Андреа Иорио (Andrea Iorio) Between You and AI: Unlock the Power of Human Skills to Thrive in an AI-Driven World (Wiley, 2026).

Принятие решений

Люди принимают решения, опираясь на собственные рассуждения — дедуктивные, индуктивные и абдуктивные, — а также на интуицию и опыт. На этот процесс влияют эмоции, предвзятость, личные убеждения и контекстное понимание ситуации.

В отличие от человека, ИИ принимает решения на основе встроенных логических моделей обработки и отбора данных — например, деревьев решений или нейронных сетей. Логика отбора опирается на выявление устойчивых закономерностей в обучающих данных. При этом в ответах ИИ также могут проявляться признаки предвзятости, унаследованные от обучающих датасетов.

У ИИ априори отсутствуют интуиция и способность к контекстной адаптации, характерные для человека. Поэтому решения, принимаемые человеком и ИИ, могут существенно различаться.

Креативность совершаемых действий

Креативность человеческих действий возникает на основе эмоционального опыта, культурных влияний и способности человека связывать между собой идеи и смыслы, которые изначально были разрозненными. Этот результат формируется различными внутренними стимулами — любопытством, внутренней мотивацией, стремлением к самовыражению, — которых у ИИ нет.

ИИ способен генерировать «творческие» результаты — например, музыку, художественные тексты или изображения. Он опирается на алгоритмы, обученные на больших датасетах. Однако это позволяет ему воспроизводить лишь характерные для определённого контекста закономерности и стили. Для достижения результата, который способен создать творчески развитый человек, ИИ не хватает внутренней мотивации, подлинной оригинальности и эмоциональной глубины.

«Человек остаётся ключевым звеном в принятии решений, где важны этика, контекст и ответственность, — считает Александр Тугов, директор ИИ-вертикали компании Selectel. — Пока нейросеть не способна оценивать последствия действий в сложных социальных или юридических сценариях. При этом сила ИИ — в скорости и масштабе, которые человек может использовать, опираясь на критическое мышление. Мы отмечаем рост числа ИИ-native-проектов, в которых ИИ является не вспомогательным инструментом, а центральной частью бизнес-идеи, а также увеличение числа специалистов, для которых ИИ стал базовой компетенцией. Компании понимают: без развития в области Generative AI (GenAI) они теряют скорость, гибкость и конкурентоспособность».

Рисунок 3. Прикладные области, где уже нашёл применение OpenAI ChatGPT (NBER, 2025)

Техника обучения

Источником обучения для человека служат не только «датасеты» — книги, фильмы, учебные материалы, — но и собственный опыт, наблюдения, применение метода проб и ошибок для закрепления базовых принципов, социальные взаимодействия и т. д. Такое обучение происходит адаптивно, требует минимального объёма дополнительной информации, а усвоенные смыслы обобщаются в разных контекстах и легко переносятся на новые ситуации.

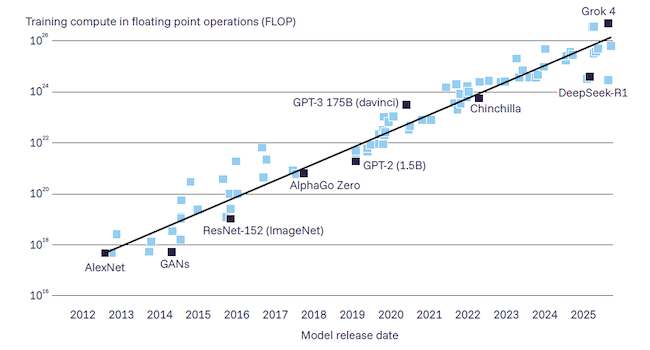

Для ИИ многое устроено иначе. Его обучение требует привлечения больших наборов данных. Сам процесс обучения предполагает использование механизмов контроля качества данных, перекрёстного сопоставления и дополнительного дообучения.

Генерация новых знаний с помощью ИИ также требует накопления больших объёмов данных, однако сам ИИ испытывает трудности с обобщением знаний при выходе за пределы специфики обучающего набора. Кроме того, ИИ не способен накапливать знания на основе неформализованного опыта так, как это делает человек.

Рисунок 4. Рост требуемой вычислительной мощности для обучения ИИ-моделей общего назначения (Epoch AI, 2025)

Решение задач повышенной сложности

Человек способен демонстрировать интеллект через логическое мышление, вербальное понимание, решение сложных проблем и абстрактное мышление. На результаты IQ-тестов влияют образование, культура и дополнительные знания, накопленные в процессе жизненного опыта.

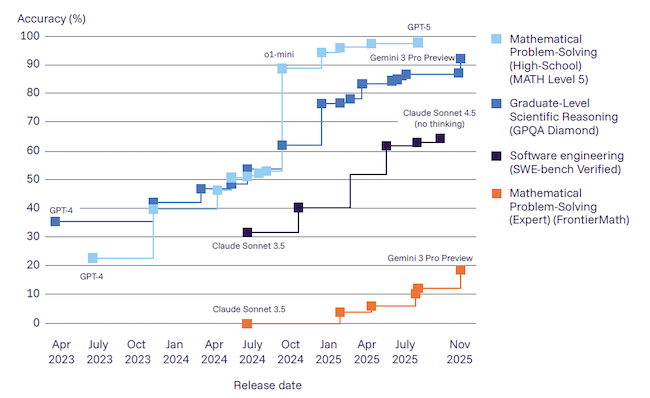

ИИ может превосходить человека в задачах, связанных с прохождением IQ-тестов. Он значительно лучше справляется с распознаванием графических образов, демонстрацией логического мышления и решением сложных математических задач, если они требуют применения уже известных схем решения. Однако интеллект ИИ остаётся узкоспециализированным, поскольку проявляется в рамках конкретных задач и не демонстрирует способности обобщать знания и формировать принципиально новое понимание, ранее отсутствовавшее.

Обеспечение эффективности при решении прикладных задач

На практике при решении прикладных задач нередко требуется лишь простое выполнение определённой последовательности операций. Однако интеллект подсказывает человеку, что результатом должно быть не просто исполнение — получение ожидаемого ответа, — а эффективное решение поставленной прикладной задачи. Человек оценивает эффективность с учётом контекста, поэтому она проявляется далеко не всегда одинаково.

Для выбора более эффективного решения человеку могут быть полезны когнитивная нагрузка, учёт различных физических и временных ограничений, внимание к разнообразным отвлекающим факторам. Условно говоря, для открытия закона всемирного тяготения Ньютону потребовалось сесть под яблоню. Для ИИ подобная ситуация вряд ли стала бы подсказкой, если только яблоки не начали бы постоянно падать прямо на его сенсоры при любом перемещении.

Для ИИ фактически отсутствует разделение понятия эффективности на качественные градации. Он способен выполнять прикладные задачи с очень высокой эффективностью в пределах заданных условий. Его ограничения формируются автоматически вследствие лимитов вычислительной мощности. Но что, если критерием эффективности выполнения задачи является не только скорость вычислений?

ИИ способен быстро обрабатывать огромные массивы информации, однако ему недостаёт адаптивности при решении прикладных задач, особенно если меняются внешние условия или параметры выходят за заранее определённые пределы.

Рисунок 5. Рост точности решений на базе ИИ-моделей общего назначения (Epoch AI, 2025)

Создание нового контента

При создании нового контента человек опирается на собственный опыт, переживаемые эмоции и культурный контекст. Написание текстов, рассказывание историй, художественное выражение интеллекта в музыкальной, поэтической или иной форме — всё это в значительной степени зависит от потребности человека в творческом самовыражении, а также от его желаний и намерений при достижении поставленных целей.

Подобные стимулы у ИИ отсутствуют. Он генерирует тексты, изображения и другой медиаконтент на основе обучающих данных и структурированных подсказок — промптов. Формально с их помощью можно имитировать человеческий язык и определённый культурный стиль, однако ИИ не хватает собственных «истинных» намерений, эмоциональных нюансов и оригинального мышления, присущих человеку.

Контент, сгенерированный ИИ, нередко вызывает сильные эмоции случайным образом или у людей, не обладающих достаточными знаниями и навыками для глубокой оценки. Такие люди часто не способны самостоятельно отличить шедевр без внешней подсказки о том, что он признан таковым профессиональным сообществом. Для оценки им требуется чужое мнение, на которое они опираются. Без него они могут равнодушно пройти мимо произведения, которое специалисты распознают как выдающееся. Поэтому они нередко высоко оценивают ИИ-контент, не понимая, в чём именно заключается его оригинальность или исключительность.

Профессионально подготовленный человек также может ошибиться и принять контент, сгенерированный ИИ, за созданный человеком. Однако в таком случае это обычно связано с недостатком опыта в выявлении подделок. По мере распространения ИИ такой опыт будет развиваться и накапливаться. При этом отличать мастерскую работу от дилетантской человек уже умеет — на основе сравнения профессиональных и непрофессиональных произведений, созданных другими людьми.

Интеллект и эмоции

Человек обладает самосознанием, эмпатией, эмоциональным фоном и способностью к его регуляции, а также социальной адаптивностью. Эти качества имеют решающее значение для формирования лидерства, общения и межличностных отношений.

При переходе к использованию ИИ перечисленные факторы исчезают. Они могут проявляться только в виде имитации. ИИ способен анализировать настроение человека и распознавать эмоции с помощью вычислительных моделей. Однако сам ИИ не испытывает эмоций. Его реакции всегда являются смоделированными, поскольку он лишён подлинной эмпатии и самосознания.

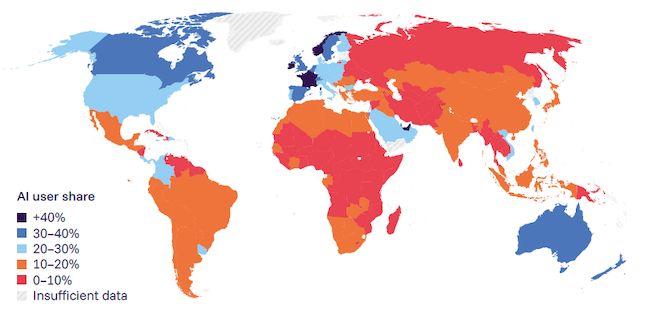

Рисунок 6. Доля пользователей, применяющих ИИ для повседневных задач (Microsoft, 2025)

Учёт социальных связей

Человек способен понимать динамику изменений в социальных настроениях. Он считывает невербальные сигналы других людей, которые помогают ему делать выводы об эмоциональном и психологическом состоянии участников общения.

Социальные взаимодействия играют важную роль в построении команд и управлении сложными взаимоотношениями между членами группы при решении общих практических задач.

У ИИ любые социальные связи представлены лишь в форме имитации. Они могут проявляться, например, в виде чат-ботов или виртуальных помощников. Однако ИИ не хватает понимания человеческих эмоций, намерений и сложности социальных взаимодействий. Его действия запрограммированы и основаны на алгоритмах и правилах, а не на реальной оценке готовности или расположенности других участников к совместным действиям.

Формирование доверия

Важное значение для человека имеет доверие. Оно формируется через отношения, эмоциональную связь и социальный опыт. Доверие возникает не сразу, а развивается постепенно и последовательно. Оно зависит от предыдущих взаимодействий между людьми и контекста текущих событий.

Доверие человека к ИИ не формируется само по себе. Оно «зарабатывается» благодаря прозрачности действий ИИ, надёжности и точности выполнения возложенных на него прикладных задач.

Доверие к ИИ зависит от того, насколько объяснимы и понятны его действия, а также насколько в них отсутствует предвзятость. Эмоциональные и межличностные факторы при формировании доверия к ИИ практически не играют роли.

Восприятие информации

Человек способен беспрепятственно собирать информацию с помощью всех своих органов чувств, находясь под влиянием собственного опыта, эмоций и когнитивных искажений. Его восприятие может адаптивно меняться, хотя и подвержено иллюзиям и ошибочным интерпретациям. Человек также способен корректировать своё восприятие, если сделанные выводы перестают согласовываться с новым опытом.

На фоне человека ИИ обладает огромным преимуществом в скорости обработки поступающей информации и изображений. Он способен распознавать закономерности, например анализировать аудио с помощью сложных алгоритмов и выявлять характерные особенности точнее, чем человек.

Однако если ИИ сталкивается с неоднозначной интерпретацией сенсорной информации, а собираемые данные оказываются неполными или противоречивыми, он начинает испытывать трудности. Ему не хватает целостного мультисенсорного восприятия. В подобных ситуациях человек опирается на интуицию, тогда как ИИ требует специальных правил и дополнительных механизмов для устранения своего «недопонимания».

Где источник риска?

Приведённый список отличий человека и ИИ ясно показывает, что между ними сохраняется множество принципиальных различий. Однако в последнее время многие люди нередко безоговорочно принимают ответы ИИ и соглашаются даже с его абсурдными выводами, хотя в общении с другими людьми обычно не склонны слепо следовать авторитетам. На этой же основе строятся и рассуждения о превосходстве ИИ над человеком и скорой замене представителей многих профессий.

Конечно, такой «источник» риска далеко не единственный. Однако нельзя отрицать и значительное влияние искусственно разгоняемых обсуждений этой темы. Например, большой резонанс вызвало недавнее высказывание Дарио Амодеи, генерального директора компании Anthropic. Он заявил, что «искусственный интеллект может уничтожить до 50 % всех рабочих мест начального уровня в сферах технологий, юриспруденции, консалтинга и финансов в течение ближайших 1–5 лет».

Быстрый ответ на это заявление дал Ян Лекун — главный научный сотрудник Meta Platforms по искусственному интеллекту и один из наиболее известных исследователей в области ИИ, которого часто называют одним из «крёстных отцов ИИ» (Godfathers of AI). Он максимально прямолинейно написал в X (ранее Twitter): «Дарио ошибается. Он абсолютно ничего не знает о влиянии технологических революций на рынок труда». Ян Лекун призвал прислушиваться в вопросах влияния ИИ к экономистам, а не к разработчикам.

Тем не менее мнение о том, что изменения на рынке труда уже действительно происходят, широко распространилось. В реальности же оценки не выглядят катастрофическими. Скорее речь идёт о другом: ИИ может представлять угрозу прежде всего не для обычных людей, а для тех, кто привык считать себя «хозяевами мира».

О чём идёт речь? Логика рассуждений подсказывает, что, если ИИ останется открытым (Open Source) и децентрализованным, он станет «великим уравнителем» и даст каждому человеку интеллектуальные возможности, которые раньше были доступны лишь элитам.

Именно поэтому всё чаще звучат предложения дополнять ИИ-модели обязательными системными промптами, выполняющими роль цензуры и контроля их поведения. В частности, с этим связывают отказ Anthropic от публичного выпуска модели Claude Mythos, которая, по сообщениям, продемонстрировала способность к высокой автономности действий. Считается, что представители элит увидели в этом потенциальную угрозу и призвали «не торопиться».

Нужно ли вводить границы безопасности и доверия к ИИ, чтобы обеспечить его сосуществование с человеком? Предыдущее сравнение человека и ИИ, думаю, уже показало, что такое разграничение действительно необходимо. Но что уже делается в этом направлении? Об этом пойдёт речь в следующей статье.

ИБ-риски в новой реальности

К настоящему времени выделяют 3 категории ИБ-рисков, которые могут возникать при использовании ИИ общего назначения:

- злонамеренное применение ИИ;

- сбои в работе ИИ вследствие снижения его надёжности или потери контроля;

- общесистемные изменения.

Злонамеренное применение ИИ может выражаться в создании контента для его преступного использования — мошенничества, шантажа, распространения интимных изображений без согласия владельца и т. д. Хотя механизмы причинения такого вреда хорошо изучены и могут быть легко задокументированы, систематический сбор данных о распространённости подобных преступлений и степени их тяжести до сих пор отсутствует.

Контент, созданный ИИ, может также использоваться для манипулирования людьми. Как показывает практика, подобные атаки способны быть столь же эффективными, как и контент, созданный человеком. Кроме того, ИИ уже продемонстрировал эффективность при поиске уязвимостей в программном обеспечении (ПО) и написании соответствующего вредоносного кода.

Современные ИИ-системы также иногда демонстрируют сбои в работе. Речь идёт не о программных ошибках, а о предоставлении сфальсифицированной информации, генерации ошибочного кода, выдаче вводящих в заблуждение советов и рекомендаций.

Значимость таких рисков существенно возрастает с наступлением эпохи Agentic AI, поскольку в этом случае ИИ действует автономно. Это затрудняет вмешательство человека и предотвращение последствий, если подобные сбои наносят вред. Хотя различные методы позволяют снижать частоту возникновения таких ошибок, пока это не достигает уровня, приемлемого для многих критически важных приложений. И хотя человек тоже способен ошибаться, надёжность его участия пока остаётся выше, чем у ИИ.

Самым серьёзным последствием подобных рисков остаётся отсутствие чёткого механизма восстановления утраченного контроля. Если в системах, управляемых людьми, можно понять логику дальнейших действий в случае аварии, то системы под управлением ИИ пока зачастую не имеют другого сценария выхода, кроме полной перезагрузки.

Но наибольшая неопределённость связана с рисками общесистемных изменений. Уже усиливается мнение о том, что универсальный ИИ в будущем сможет автоматизировать широкий спектр когнитивных задач, особенно в сфере интеллектуального труда. Однако масштабы последствий пока невозможно точно оценить. Одни считают, что исчезновение одних рабочих мест будет компенсировано появлением новых, другие утверждают, что массовая ИИ-автоматизация приведёт к значительному сокращению занятости и, как следствие, снижению доходов населения. Уже сейчас наблюдается заметное падение спроса на начинающих специалистов в ряде профессий.

Ещё более серьёзные риски связывают со снижением способности человека принимать обоснованные решения. Зависимость от ИИ-инструментов может ослаблять навыки критического мышления и способствовать тому, что люди начнут доверять результатам работы ИИ-систем без достаточной проверки.

Всё ли так безнадёжно?

Итак, сначала было показано, что человек не равнозначен ИИ. У человека есть множество качеств, которые ИИ не способен заменить не только сейчас — из-за отсутствия соответствующих алгоритмов, — но и, возможно, в принципе. Затем были обозначены риски безопасности, возникающие при широком внедрении ИИ. Но действительно ли всё так безнадёжно?

Можно вернуться на 150 лет назад и сравнить людей конца XIX века с современным человеком. Очевидно, что сегодня количество образованных людей значительно выросло. Это стало следствием развития технологий, которое, в свою очередь, привело к развитию социальных отношений, изменению института образования, расширению спектра решаемых научных задач и т. д.

Можно предположить, что внедрение ИИ приведёт к аналогичным шагам в дальнейшем развитии человека.

«Но стоит отметить, что внедрение ИИ требует не просто мощных GPU, а гибкой масштабируемой инфраструктуры с надёжной сетью, безопасным хранением данных и инструментами мониторинга — без этого автоматизация становится уязвимой и непредсказуемой, — считает Александр Тугов (Selectel). — При этом порог входа в новые технологии для бизнеса за последнее время значительно снизился: качественные ИИ-модели с открытым исходным кодом, включая отечественные, можно развернуть внутри собственной ИТ-инфраструктуры компании или на арендованных серверах без необходимости инвестировать в дорогостоящее специализированное оборудование. Это упрощает и удешевляет проведение экспериментов, а также позволяет компаниям быстрее и безопаснее запускать пилотные проекты».

Рисунок 7. Выступление Александра Тугова (в центре) на ежегодной конференции Selectel «MLечный путь 2026»

Такая «децентрализация» повышает роль регуляторных органов, законодательства и общего уровня культуры в отношении ИИ. Ещё год назад на вопрос о необходимости регулирования ИИ с точки зрения этических норм представители Госдумы отвечали, что существующее законодательство автоматически распространяется и на работу ИИ. Теперь стало очевидно, что ИИ обладает собственными рисками и принципиальными отличиями от человека.

Поэтому вопрос развития законодательства в отношении ИИ пока нельзя считать решённым.

Как идти вперёд?

«Сегодня риски информационной безопасности могут выступать сдерживающим фактором для внедрения и использования бизнесом технологий искусственного интеллекта, — заявил Александр Тугов (Selectel). — По данным нашего исследования, вопросы ИБ входят в число главных барьеров для внедрения ИИ в российских компаниях. Использование готовой защищённой инфраструктуры облачного провайдера позволяет компаниям снижать эти риски и ускорять внедрение и развитие новых технологий.

Провайдер берёт на себя значительную часть ИБ-нагрузки, предлагая инфраструктуру и сервисы для ИИ с уже встроенными механизмами защиты и соответствием регуляторным требованиям. Вместо самостоятельного проектирования защищённой среды и прохождения сложных процедур аттестации бизнес получает инфраструктуру, где требования безопасности реализованы «по умолчанию». Так, инфраструктура Selectel соответствует ряду требований и стандартов, включая ГОСТ Р 57580, PCI DSS и требования Федерального закона №152-ФЗ «О персональных данных», а также сертифицирована по стандартам ISO/IEC 27001, ISO/IEC 27017 и ISO/IEC 27018.

Гибкость инфраструктуры также играет важную роль: ИИ-модели можно разворачивать как в облаке, так и в изолированных контурах — в ЦОДах на территории России или на площадке заказчика. Это позволяет безопасно использовать модели с открытым исходным кодом и быстрее реализовывать ИИ-проекты без компромиссов в области ИБ.

Например, Selectel развивает собственную ИИ-платформу и входящий в её состав Foundation Models Catalog, который позволяет тестировать и запускать готовые LLM-модели — например, Qwen, DeepSeek и OpenAI-модели — без необходимости вручную настраивать инфраструктуру для работы с ними».

Внедрение ИИ уже невозможно остановить: технологии становятся доступными даже для малого бизнеса, не говоря уже о среднем и крупном. Частные пользователи также получают доступ к общедоступным ИИ-моделям. Очевидно, что этот рынок продолжит стремительно развиваться, а список доступных ИИ-моделей будет пополняться новыми разработками стартапов.

Задача отрасли сейчас состоит не только в том, чтобы предоставить возможности для развития ИИ, но и в том, чтобы направить его по созидательному пути, а не по пути нарастания рисков и разрушительных последствий. Риски ИБ при внедрении ИИ неизбежно будут расти, однако развитие самого человека — через активное освоение и грамотное применение ИИ — также не должно отставать.

Выводы

Монополизировать развитие ИИ уже стало невозможно. Искусственный интеллект не только стремительно расширяет своё присутствие — появился даже новый термин: эпоха Agentic AI. Это сразу заставляет ответить на ключевой вопрос: существуют ли принципиальные различия между человеком и ИИ?

В этой статье были перечислены различия между человеком и ИИ. Они ясно показывают, что предположение о скорой замене человека ИИ-агентами справедливо лишь для областей, связанных с рутинным выполнением задач — простых или сложных. Но как только в процессе появляется неопределённость, что особенно характерно, например, для задач ИБ, сразу возникает обратная потребность — в участии человека.

Пока трудно оценить, насколько сильно деятельность человека изменится под влиянием ИИ. Например, в сфере образования и при формировании обучающих курсов. По всей видимости, корректировка таких материалов действительно потребуется, однако она вряд ли окажется настолько радикальной, как может показаться заранее. Более того, приход ИИ, возможно, даже повысит значимость взаимодействия между человеком и ИИ. Они смогут дополнять друг друга, а не конкурировать, как это часто представляется сегодня.

При этом требования к накоплению знаний, сохранению способности получать и применять разнообразный опыт, по-видимому, останутся прерогативой именно человека, а не ИИ.