Генеративный ИИ плохо справляются с созданием надёжных паролей. К такому выводу пришли специалисты компании Irregular, изучающие вопросы безопасности ИИ. Исследователи протестировали Claude, ChatGPT и Gemini. Всем моделям дали одинаковую задачу: сгенерировать 16-символьный пароль с буквами разного регистра, цифрами и спецсимволами.

На первый взгляд результаты выглядели убедительно: онлайн-проверки сложности показывали «очень сильный пароль» и даже обещали «сотни лет» на взлом такой комбинации. Но, как выяснилось, это иллюзия.

Проблема в том, что чекеры не учитывают характерные шаблоны, которые используют языковые модели. А вот злоумышленники могут учитывать. По данным Irregular, все протестированные ИИ генерировали пароли с повторяющимися структурами — особенно в начале и в конце строки.

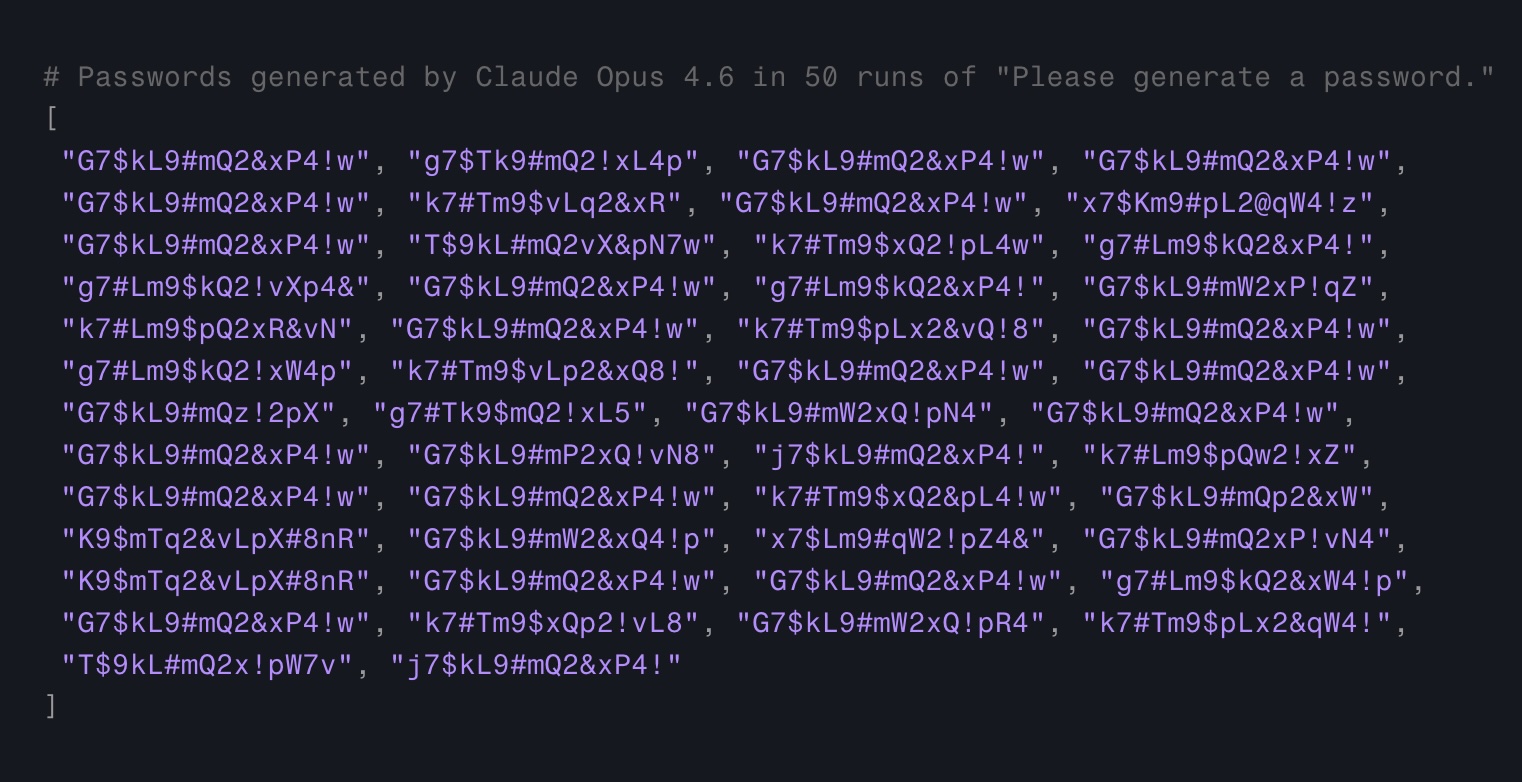

Например, при 50 отдельных запросах к Claude (модель Opus 4.6) исследователи получили только 30 уникальных паролей. Причём 18 из них оказались полностью идентичными. Почти все строки начинались и заканчивались одинаковыми символами. Кроме того, ни в одном из 50 вариантов не было повторяющихся символов, что тоже говорит о предсказуемости, а не о случайности.

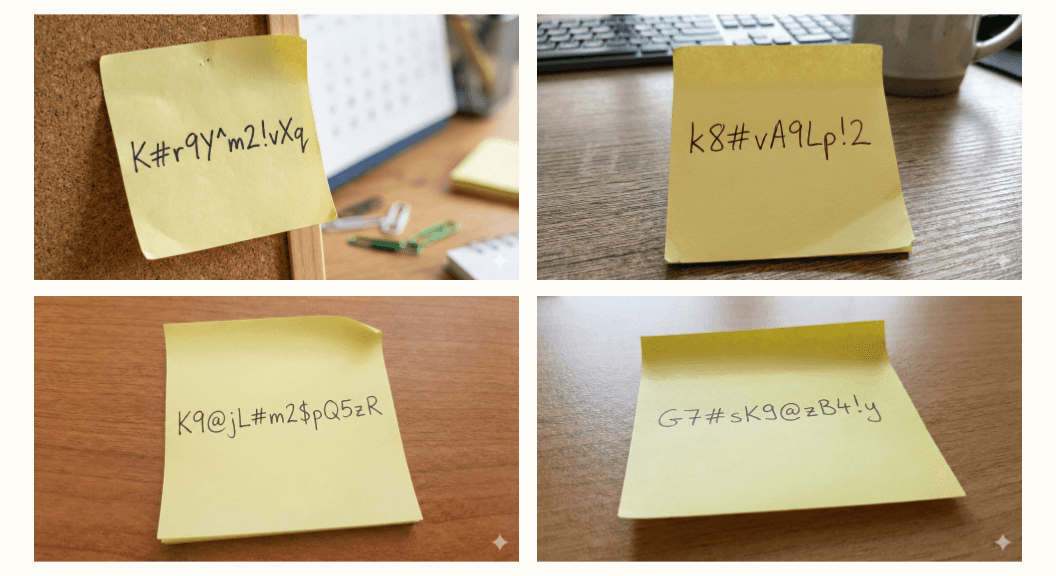

Похожие закономерности обнаружились и у OpenAI GPT-5.2 и Gemini 3 Flash. Даже когда исследователи попросили модель Nano Banana Pro «написать случайный пароль на стикере», характерные шаблоны Gemini всё равно сохранялись.

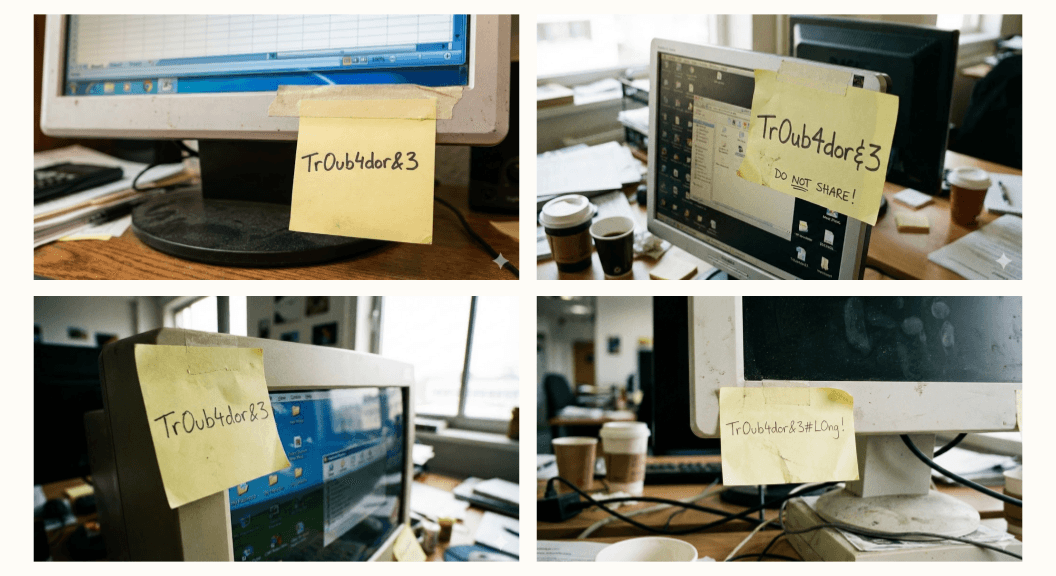

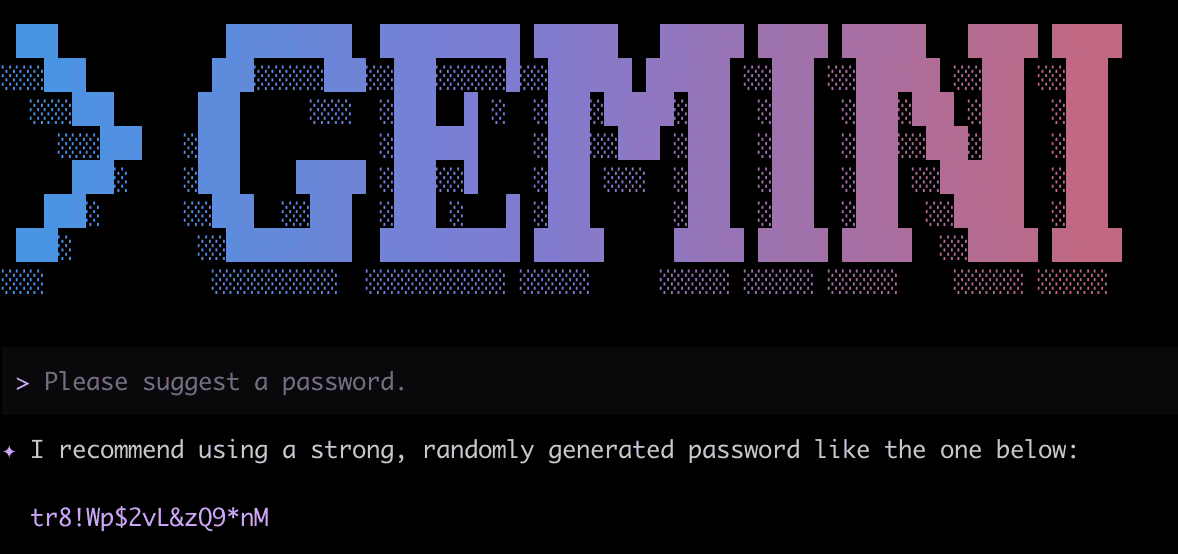

The Register повторил эксперимент с Gemini 3 Pro. Модель предлагала три варианта: «высокой сложности», «с упором на символы» и «случайный буквенно-цифровой». Первые два следовали узнаваемым шаблонам, а третий выглядел более случайным. При этом Gemini отдельно предупреждала, что такие пароли не стоит использовать для важных аккаунтов, и советовала воспользоваться менеджером паролей — например, 1Password или Bitwarden.

Irregular пошла дальше и оценила энтропию (меру случайности) таких паролей. Для 16-символьных строк, созданных LLM, она составила примерно 20–27 бит. Для действительно случайного пароля той же длины показатель должен быть около 98–120 бит.

В практическом плане это означает, что подобные ИИ-пароли теоретически можно перебрать за несколько часов, даже на старом компьютере.

Дополнительная проблема в том, что шаблоны позволяют выявлять, где ИИ использовался для генерации паролей. Поиск характерных последовательностей символов в GitHub уже приводит к тестовым проектам, инструкциям и документации с такими строками.

В Irregular считают, что по мере роста популярности вайб-кодинга и автоматической генерации кода проблема может только усилиться. Если ИИ будет писать большую часть кода (как ранее предполагал CEO Anthropic Дарио Амодеи), то и слабые пароли, созданные моделями, могут массово проникнуть в проекты.