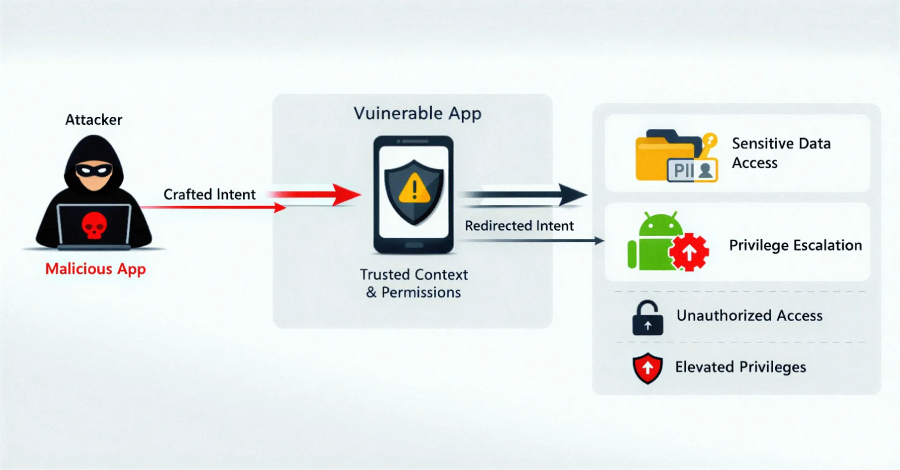

Стали известны подробности уязвимости в популярном стороннем Android SDK EngageLab SDK, которая создаёт серьёзные риски для миллионов пользователей криптовалютных кошельков и цифровых приложений. По данным исследователей, брешь позволяла приложениям на одном устройстве обходить песочницу Android и получать несанкционированный доступ к закрытым данным других программ.

О проблеме рассказала команда Microsoft Defender Security Research. EngageLab SDK используется как сервис пуш-уведомлений.

Разработчики встраивают его в приложения, чтобы отправлять пользователям персонализированные уведомления и повышать вовлечённость в реальном времени. Но, как выяснилось, именно этот компонент оказался слабым звеном.

В Microsoft отметили, что заметная часть приложений с этим SDK относится к экосистеме криптокошельков и цифровых активов. Только такие программы суммарно набрали более 30 миллионов установок. А если учитывать и остальной софт с EngageLab SDK, общее число установок превышает 50 миллионов.

Проблема была обнаружена в версии 4.5.4. Речь идёт об уязвимости класса «intent redirection»: злоумышленник мог с помощью вредоносного приложения на том же устройстве манипулировать системными механизмами Android и получить доступ ко внутренним каталогам приложения, в которое был встроен уязвимый SDK. А это уже открывало путь к конфиденциальным данным.

Названия затронутых приложений Microsoft раскрывать не стала. При этом компания сообщила, что все обнаруженные приложения с уязвимыми версиями SDK уже удалены из Google Play. После ответственного раскрытия проблемы в апреле 2025 года разработчик EngageLab выпустил патч в версии 5.2.1.

На данный момент признаков того, что уязвимость реально использовалась в атаках, нет.