Платформа облачной безопасности Cloud Advisor добавила новую функцию — безагентный контроль целостности файлов в публичных облаках. Речь идёт о механизме, который позволяет отслеживать изменения файлов без установки агентов на виртуальные машины. Для облачной инфраструктуры это довольно чувствительная тема.

Контроль целостности файлов нужен, чтобы вовремя замечать несанкционированные изменения, разбирать инциденты и выполнять требования различных стандартов безопасности.

Но в публичных облаках такие механизмы внедряются не так часто: среда постоянно меняется, ресурсы живут недолго, а поддержка классических FIM-решений обычно превращается в отдельную головную боль.

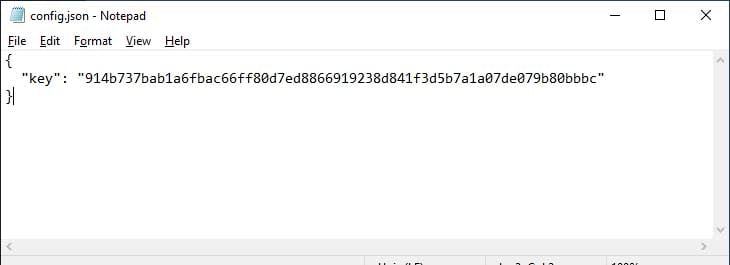

В Cloud Advisor решили обойти эту проблему через безагентный подход. В компании говорят, что новая версия платформы использует технологию DiskScan и за счёт этого может проверять виртуальные машины без установки дополнительного ПО и без создания учётных записей внутри самих систем.

Функция распространяется на виртуальные машины под управлением Linux и Windows. Для Linux заявлен контроль изменений файлов, а для Windows — файлов и реестра. Под наблюдение можно брать, например, системные конфигурации, настройки прикладного ПО и параметры средств защиты информации.

Если говорить проще, идея в том, чтобы видеть изменения в критичных файлах и системных настройках без тяжёлого внедрения и без постоянной возни с агентами в облачной среде.

На практике это выглядит как попытка приспособить классический контроль целостности к реалиям публичного облака, где инфраструктура слишком подвижная для старых подходов.