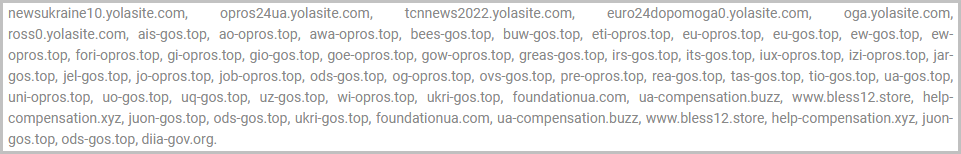

Средняя стоимость объявлений на теневых площадках, предлагающих услуги для организаторов фишинговых атак по модели «фишинг как услуга» (PhaaS), по итогам 2025 года превысила 700 долларов. В целом фишинг превратился в развитую теневую экономику, в которой предложение заметно превышает спрос.

К таким выводам пришли исследователи Positive Technologies. Их обзор оказался в распоряжении ТАСС. По данным авторов, средняя стоимость предложения по итогам 2025 года составила 723 доллара. При этом на итоговый показатель заметно повлияло большое количество дорогих лотов.

«В основном цена колеблется от 10 до 1000 долларов, однако примерно в 25% объявлений она выше. Медианная цена выросла со 125 до 500 долларов», — говорится в отчёте.

Около 70% объявлений связаны с продажей. На запросы о покупке приходится менее 10% сообщений. Значительную долю также занимают публикации о раздачах — около 16%. Лишь 1% объявлений связан с предложениями о партнёрстве.

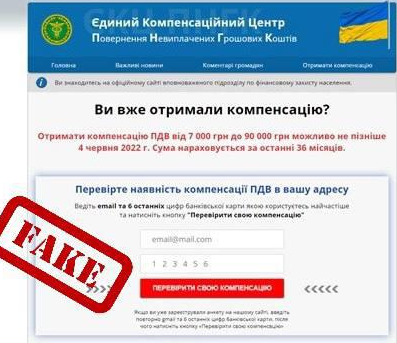

Как отмечается в исследовании, в дарквебе представлен широкий набор инструментов для фишинга. Чаще всего речь идёт о средствах для обхода процедур аутентификации и идентификации, а также о решениях для управления самими фишинговыми инструментами.

В 2026 году активность на форумах несколько снизилась. Это исследователи связывают с переходом на другие площадки, прежде всего в мессенджеры. В 2025 году, напротив, активность по сравнению с 2024-м росла. Это объясняется изменениями в политике Telegram, после которых сообщества киберпреступников начали мигрировать в дарквеб.

«Рынок PhaaS уже насыщен поставщиками, конкуренция высокая, а ценность объявлений смещается в сторону инструментов для автоматизации и обхода методов защиты. При этом цены всё равно растут, несмотря на большое количество публикаций о продаже фишинговых решений или предоставлении подобных услуг», — сказано в исследовании.