На популярном онлайн-форуме, посвященном утечкам, появилось сообщение о взломе ИИ-платформы, специально созданной для нужд киберкриминала. К посту прикреплен образец добычи — персональные данные, якобы принадлежащие юзерам WormGPT.

По словам автора атаки, ему суммарно удалось украсть информацию о 19 тыс. подписчиков хакерского ИИ-сервиса, в том числе их имейлы, ID и детали платежей.

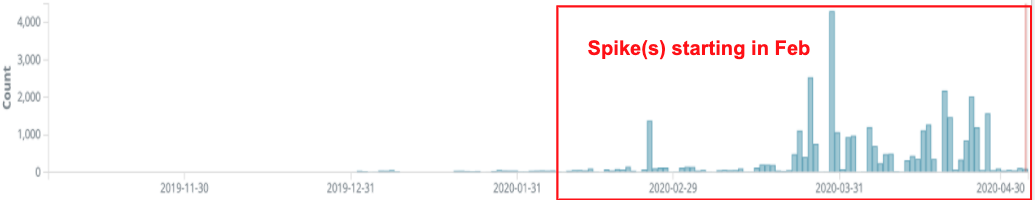

Эксперты Cybernews изучили слитый образец февральских записей из базы и обнаружили, что они действительно содержат пользовательские данные и дополнительные сведения:

- тип подписки;

- валюта, в которой производилась оплата;

- суммарная выручка по тому же тарифному плану.

Автор поста об атаке на WormGPT — хорошо известный форумчанин, на счету которого множество легитимных публикаций. Этот факт, по мнению исследователей, придает еще больше веса утверждению о взломе криминального ИИ-сервиса.

Утечка пользовательской базы WormGPT позволяет идентифицировать авторов атак с применением этого ИИ-инструмента. Злоумышленники могут ею воспользоваться, к примеру, для адресного фишинга или шантажа.