У сайтов появился новый способ шпионить за пользователями. Исследователи описали атаку под кодовым названием FROST, которая позволяет веб-страницам отслеживать активность человека через едва заметные задержки в работе SSD.

Полное название техники — Fingerprinting Remotely Using OPFS-based SSD Timing.

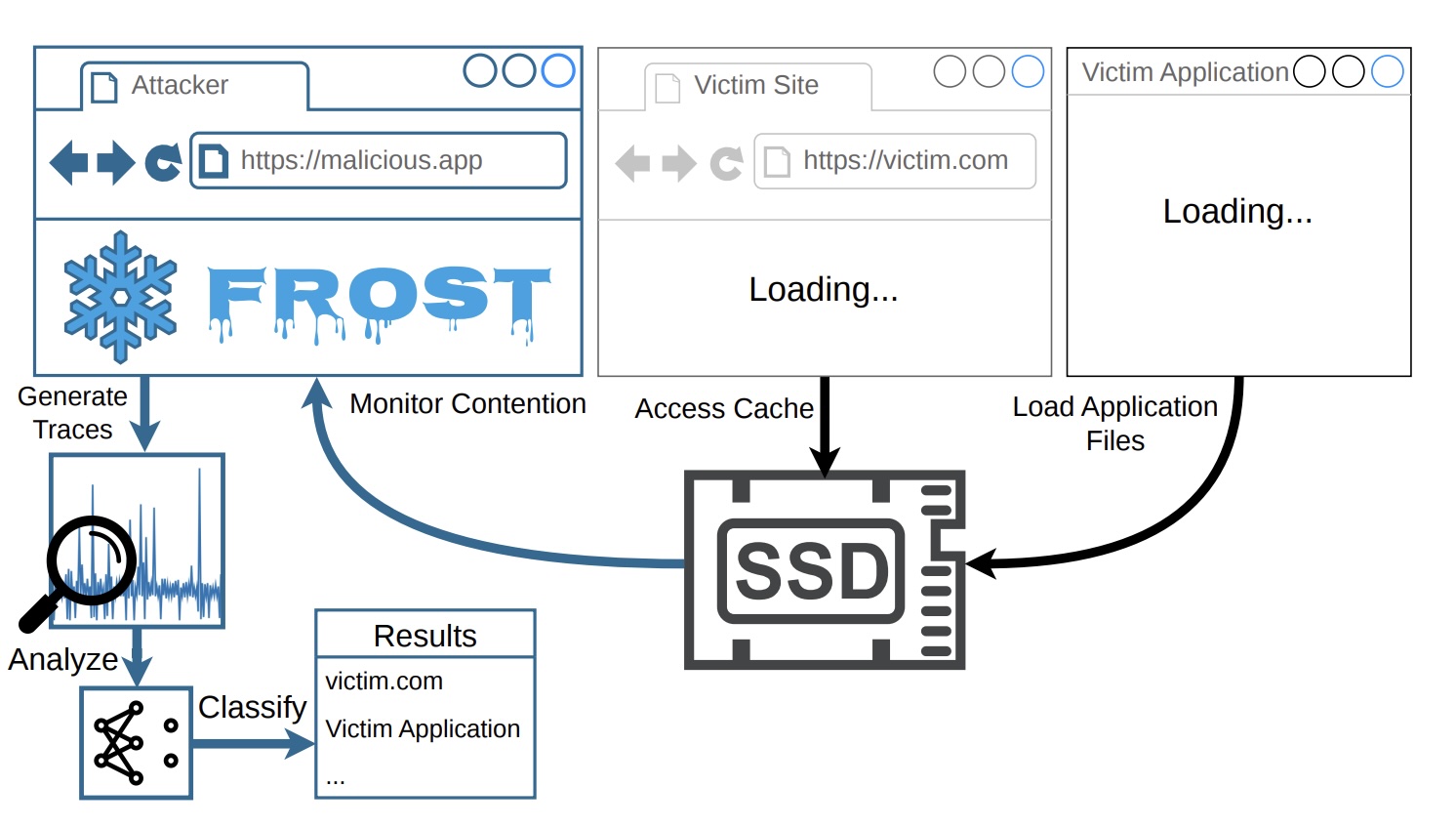

Работает она так: сайт загружает в браузере специальный JavaScript, работает с файловым хранилищем OPFS и внимательно смотрит, как меняется время операций чтения с накопителя.

По этим микрозадержкам можно понять, какие сайты открыты у пользователя в других вкладках и даже какие приложения запущены на устройстве.

И да, пользователю для этого почти ничего не нужно делать. Достаточно просто открыть сайт, на котором размещён атакующий код. Никаких кликов, разрешений и подозрительных загрузок, всё происходит тихо и незаметно.

В основе FROST лежит принцип атаки по сторонним каналам. Разные процессы обращаются к одному и тому же SSD, создают нагрузку, а атакующий сайт измеряет задержки при собственных операциях ввода-вывода.

Затем эти данные прогоняются через заранее обученную свёрточную нейросеть, которая пытается распознать активность пользователя по характерным следам.

Особенно неприятно здесь, что атака работает прямо из браузера. Предыдущие атаки такого типа на SSD обычно требовали более низкоуровневого доступа, а FROST обходится возможностями современных веб-платформ. Браузеры давно перестали быть просто окошками для сайтов: сегодня в них крутятся офисные пакеты, редакторы фото и видео, IDE и другие тяжёлые веб-приложения.

Для работы FROST используется OPFS — Origin Private File System, изолированное файловое хранилище, которое сайт может создать для своих задач. Формально оно находится в песочнице и отделено от других сайтов и системы. Но этого оказалось достаточно, чтобы измерять задержки операций чтения и строить по ним отпечаток активности.

Правда, у техники есть серьёзные ограничения. Атакующему сайту нужен очень большой OPFS-файл, скорее всего, размером от гигабайта и выше. Массовая эксплуатация такого трюка быстро стала бы заметной: пользователи могли бы увидеть странный расход дискового пространства. Кроме того, файл должен находиться на том же SSD, активность которого пытаются анализировать. Для вкладок браузера это обычно не проблема, а вот приложения на другом накопителе FROST уже не увидит.

Исследователи полноценно проверили атаку на macOS-устройстве с чипом M2. На Linux они показали, что базовый механизм измерения задержек SSD из JavaScript тоже работает, но полный сценарий атаки не запускали. Windows в исследовании не тестировали.