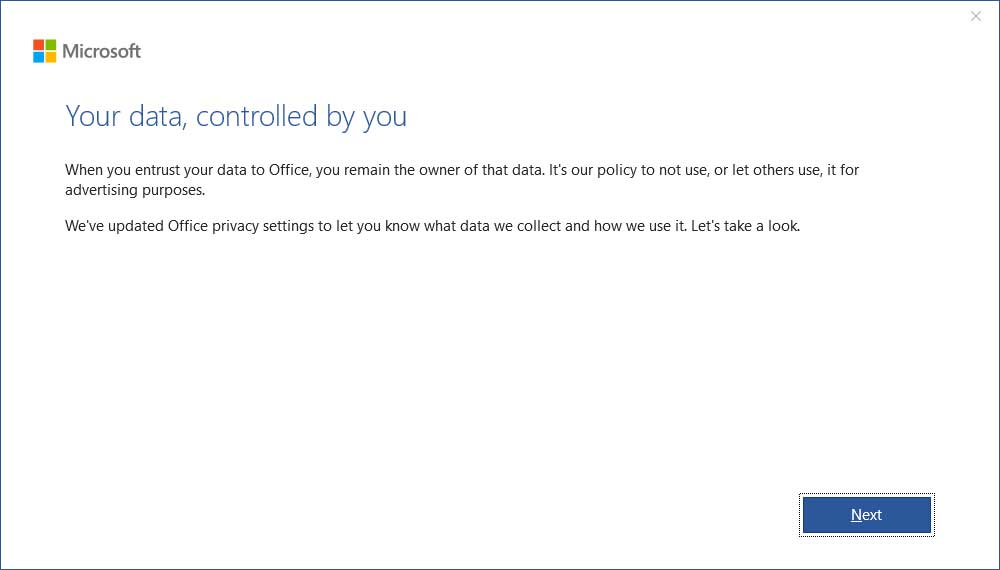

При запуске приложений Word, Excel и PowerPoint Microsoft Office теперь отображает пользователям новое диалоговое окно, которое озаглавлено «Ваши данные, которыми управляете вы». В сущности, это окно запрашивает у вас разрешение на отсылку дополнительных пользовательских данных в Microsoft.

Оказалось, что американский техногигант изменил политику конфиденциальности в Microsoft Office версии 1904 (билд 11601.20144). Этот апдейт вышел 29 апреля 2019 года.

В примечаниях к выходу этих обновлений толком ничего не объясняется, есть лишь упоминание, что корпорация «добавила новые правила в отношении данных диагностики».

В диалоговом окне «Ваши данные, которыми управляете вы» пользователям предоставляют право выбора — отправлять ли в Microsoft дополнительную информацию при работе с Word, Excel и PowerPoint или же отказаться от такой практики.

При этом корпорация делает акцент на том, что собираются исключительно данные, имеющие отношение к диагностике. Таким образом, по словам Microsoft, пользовательский опыт значительно улучшается в будущем.

Стоит отметить, что такой подход американской корпорации встретил критику со стороны специалистов. Вся проблема в том, что Microsoft нигде не упоминала это диалоговое окно. Наткнувшись на него, первая мысль, которая приходит на ум специалисту в области безопасности, — это работа вредоносной программы или какой-нибудь хитрый фишинг.