Google наконец решает одну из самых бытовых проблем безопасности, когда даёшь кому-то свой смартфон на минуту, а внутри у тебя половина жизни. В свежей сборке Android Canary 2603 появилась функция App Lock — возможность поставить дополнительную защиту на любое приложение.

Теперь, чтобы открыть, например, галерею, мессенджер или банковское приложение, потребуется отпечаток пальца или ПИН-код.

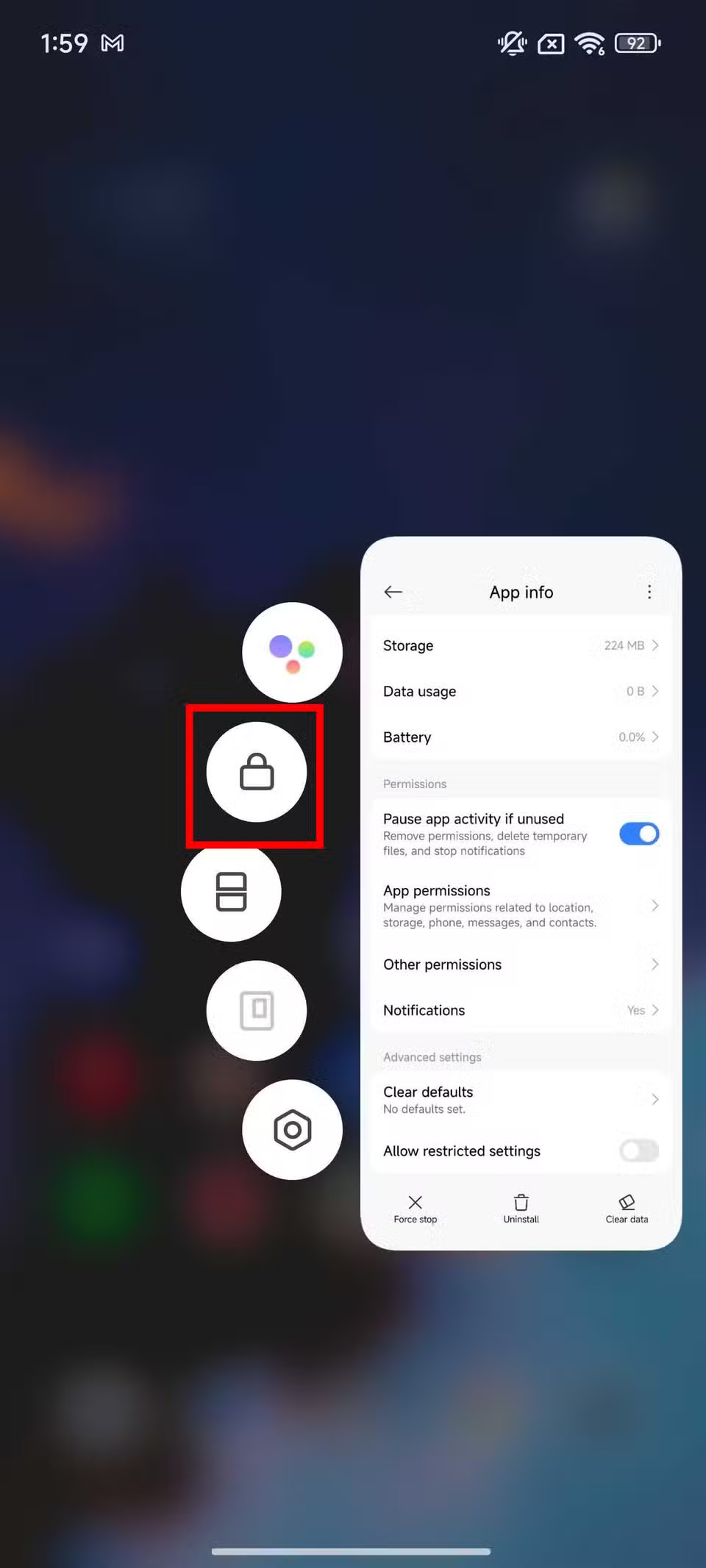

Функционально всё работает просто: достаточно зажать иконку приложения, и в выпадающем меню появится опция блокировки. После включения App Lock приложение нельзя открыть без аутентификации, уведомления от него скрываются, виджеты исчезают с рабочего стола, пропадают быстрые ярлыки.

По сути, приложение становится полностью «невидимым» без разблокировки. Google сразу предупреждает: если пользователь дал доступ к данным приложения каким-то ИИ-агентам или сервисам, они всё равно смогут к ним обращаться.

Пока неясно, можно ли, например, обойти защиту через тот же Gemini, но сам факт такого ограничения уже вызывает вопросы.

С Android 15 у Google уже есть функция Private Space — отдельный скрытый профиль, куда можно убирать приложения и данные. Но она подходит скорее для жёсткой изоляции.

App Lock — более гибкий вариант, поскольку не нужно не нужно прятать всё приложение, достаточно просто закрыть к нему доступ.

Если функция доберётся до релиза, это может сильно изменить повседневный сценарий использования смартфона. Его можно будет спокойно передать другому человеку, не переживая за личные данные.