Исследователи описали новое семейство Android-зловредов DevilNFC, которое используется для NFC-атак на клиентов банков. Схема неприятная: жертву заманивают фишинговым сообщением, заставляют установить «обновление безопасности», а затем фактически запирают внутри поддельного банковского интерфейса.

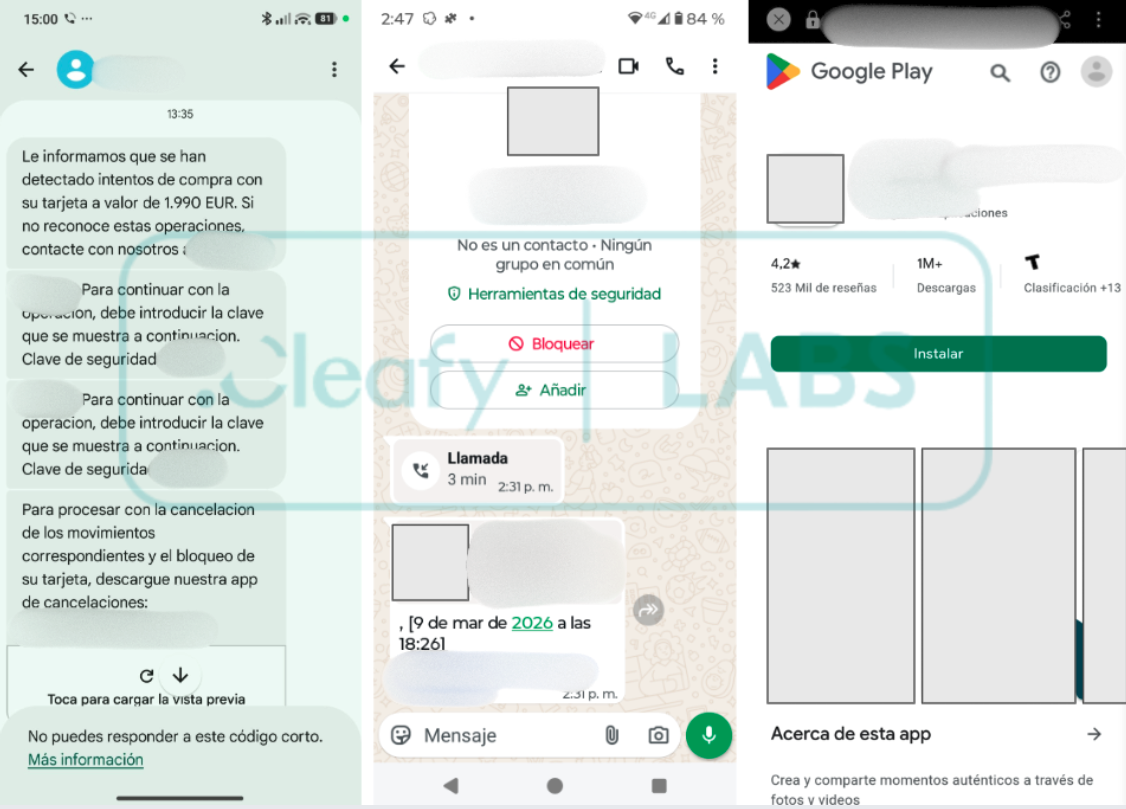

Заражение начинается с СМС или сообщения в WhatsApp (принадлежит корпорации Meta, признанной экстремистской и запрещённой в России) от имени банка. Пользователя ведут на фейковую страницу Google Play, где предлагают установить приложение якобы для защиты аккаунта.

После запуска зловред включает полноэкранный режим, из которого пользователь не может нормально выйти. Кнопки навигации отключены, «назад» не помогает. Телефон превращается в ловушку.

Дальше DevilNFC под видом проверки просит приложить банковскую карту и ввести ПИН-код. В это время зловред в фоне запускает NFC relay: перехватывает данные карты, пересылает их атакующим и помогает провести операцию на другом устройстве.

Чтобы выиграть время, жертве показывают фейковую ошибку и просят подержать карту у телефона подольше. Параллельно DevilNFC перехватывает входящие СМС, чтобы забирать одноразовые коды от банков. ПИН-код, данные карты и OTP уходят на серверы злоумышленников и в телеграм-каналы.

Такая связка позволяет атакующим не только проводить бесконтактные платежи, но и потенциально использовать сценарии с банкоматами.

DevilNFC устроен хитро: один APK может работать по-разному. На телефоне жертвы он выступает как NFC-ридер, а на рутованном устройстве атакующего превращается в эмулятор карты. Для этого используется hooking-фреймворк, который перехватывает NFC-коммуникации на системном уровне, обходя стандартные Android API.