Компания Эфшесть/F6 рассказала о необычной мошеннической схеме, которую начали использовать злоумышленники против клиентов российских банков. Речь идёт об Android-трояне LunaSpy — шпионской вредоносной программе, которая в одном из случаев попала к жертве не через ссылку или файл, а сразу вместе со смартфоном.

По данным специалистов Эфшесть/Эфшесть/F6, в феврале и марте 2026 года удалось зафиксировать около 300 таргетированных атак с использованием LunaSpy.

Это уже вполне таргетированные атаки, в которых злоумышленники заранее готовят устройство и затем убеждают человека начать им пользоваться.

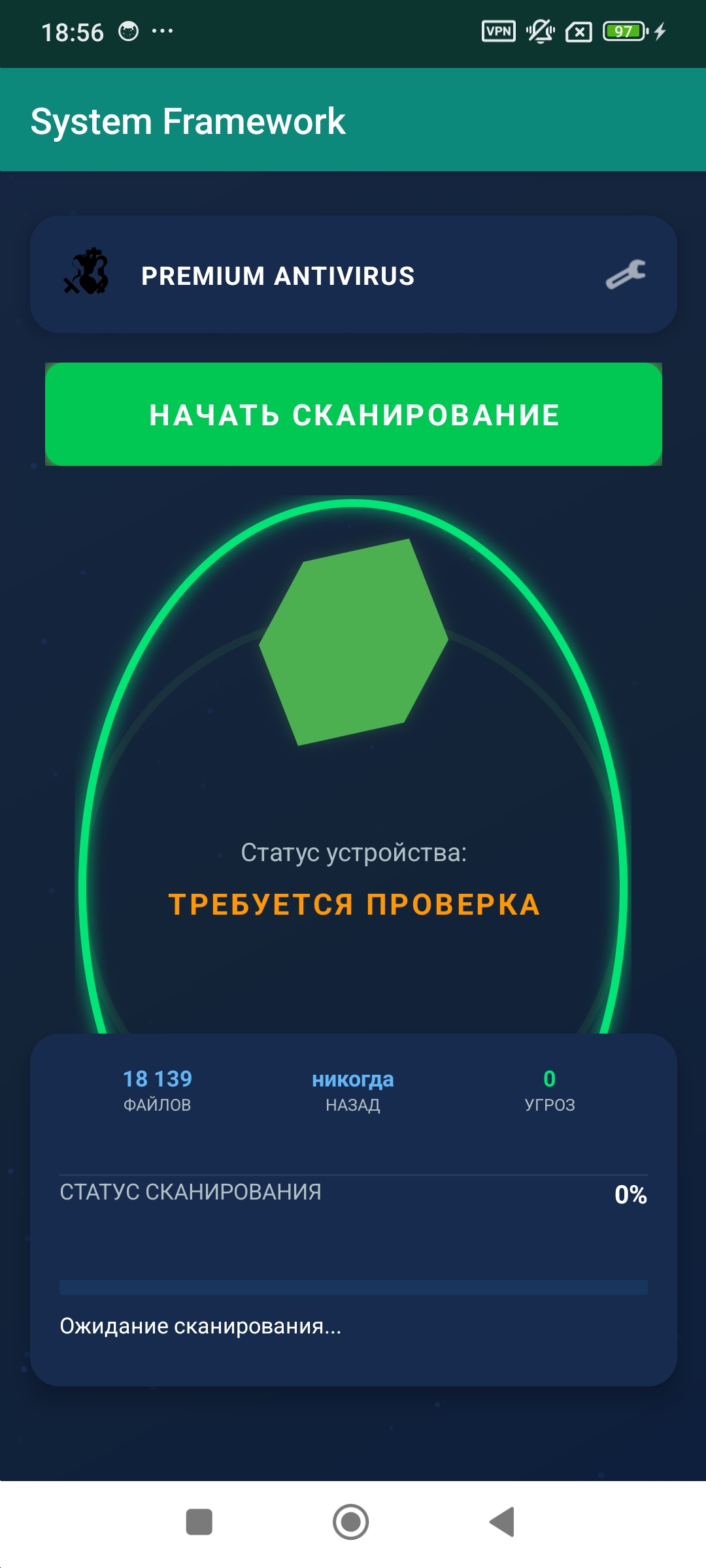

Сам LunaSpy — это шпионский софт для Android с богатой функциональностью. Он может перехватывать управление камерой и микрофоном, записывать экран и собирать данные с устройства. Заражённый смартфон в руках жертвы превращается в удобный инструмент тотального наблюдения.

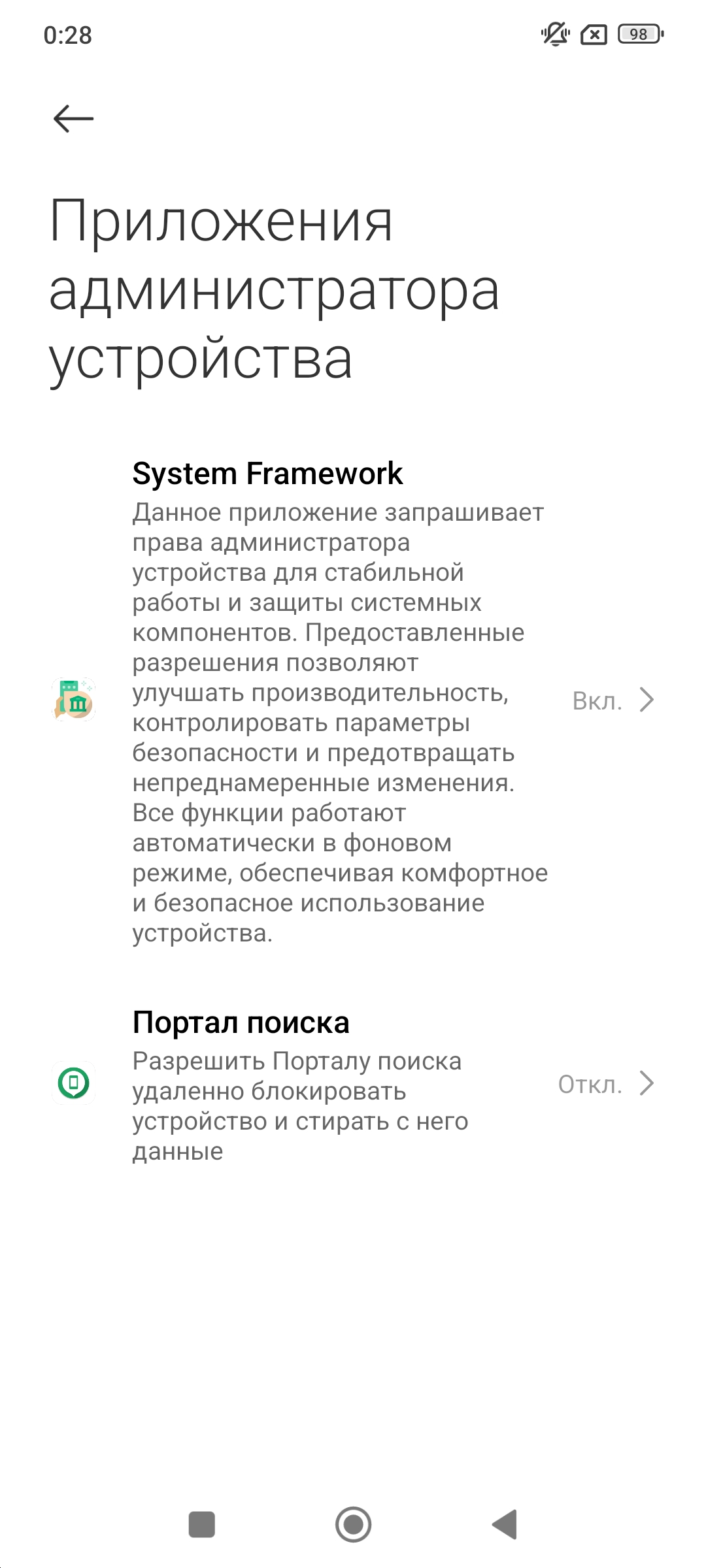

Схема атаки выглядит особенно неприятно именно из-за своей подачи. Сначала злоумышленники используют социальную инженерию, а затем внушают человеку, что доставленный ему смартфон якобы обеспечит повышенную безопасность и конфиденциальность. На деле всё наоборот: вредоносная программа уже установлена заранее, а нужные разрешения для её работы, по сути, готовы ещё до того, как пользователь начинает пользоваться устройством.

В исследованных образцах LunaSpy маскировался под якобы антивирусное решение System framework, хотя, как отмечают в Эфшесть/F6, названия могут меняться.

У трояна есть механизмы самозащиты, которые мешают его удалить. Например, если пользователь открывает окно удаления приложения, под которым скрывается зловред, LunaSpy может сам нажать системную кнопку «Назад» и одновременно отправить уведомление на сервер злоумышленников.

Любые действия жертвы, которые могут помешать преступникам, тоже могут быть замечены заранее. С учётом возможностей LunaSpy по шпионажу за экраном, микрофоном и камерой социальная инженерия становится ещё опаснее: злоумышленники буквально получают больше контекста о том, что делает человек, и могут точнее направлять его действия. В исследованном устройстве специалисты также нашли мессенджер на базе протокола Matrix, через который преступники поддерживали контакт с жертвой.

Как отметил руководитель департамента Эфшесть/F6 по противодействию финансовому мошенничеству Дмитрий Ермаков, такие атаки открывают новый потенциальный вектор мошеннических схем: доставка вредоносной программы вместе с уже подготовленным устройством. По его словам, если этот подход начнёт развиваться, у злоумышленников появится ещё больше возможностей для скрытого контроля над смартфоном.