Корпорация Symantec сообщает об обнаружении очередного мошеннического сайта, созданного злоумышленниками с целью распространения спама. Обычно для привлечения внимания злоумышленники используют упоминания известных людей или другие популярные темы. Но в этот раз «приманка» рассчитана не на обычных пользователей, а на таких же киберпреступников.

И без того популярный эксплойт-пак «Blackhole Exploit Kit» недавно привлек к себе еще больше внимания после того как его создатель объявил о скором выходе версии 2.0, включающей длинный список новых интересных возможностей. Эксперты Symantec были крайне удивлены, обнаружив сайт, на котором Blackhole Exploit Kit версии 2.0 уже якобы был размещен. Скоро стало ясно, что с этим сайтом что-то не так.

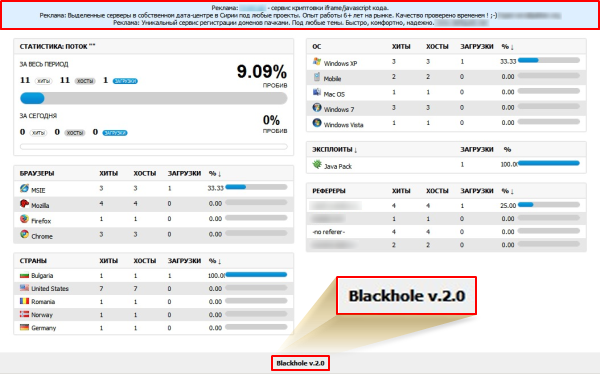

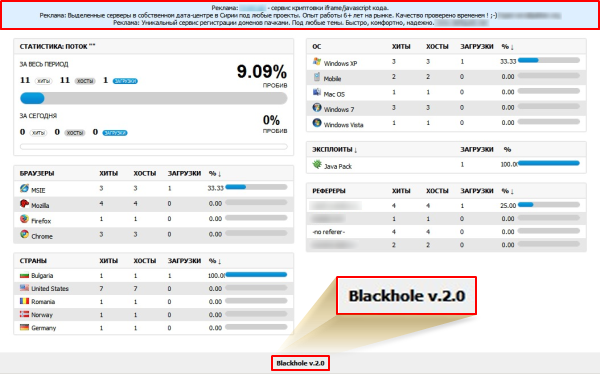

Рисунок 1. Страница статистики «нового» эксплойт-пака

На рисунке 1 отчётливо видна надпись: «Blackhole v.2.0», однако, за исключением этого незначительного отличия, в остальном страница очень похожа на аналогичную страницу из прошлой версии:

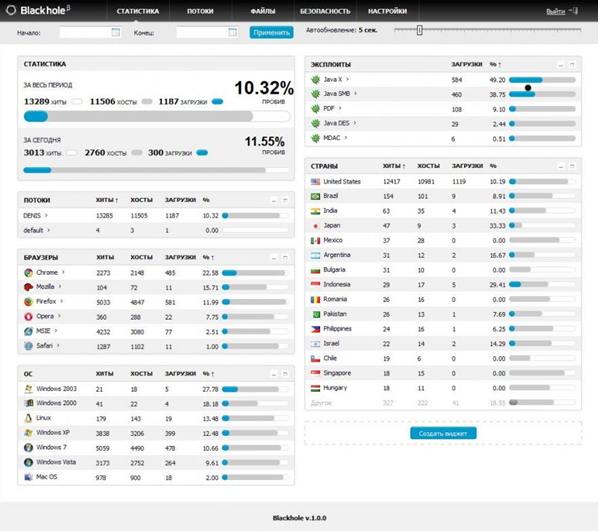

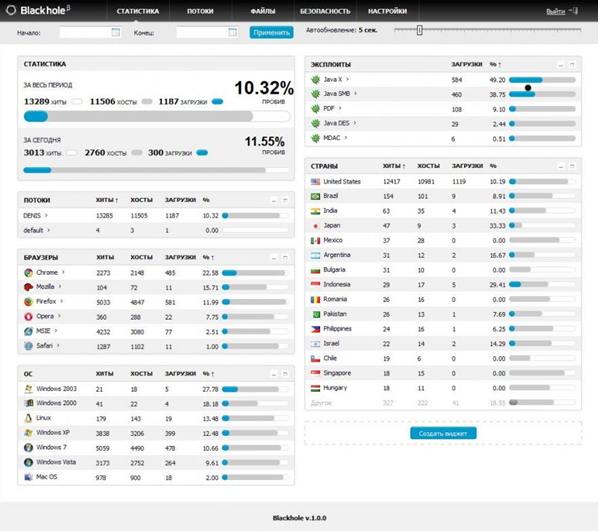

Рисунок 2. Страница статистики старой версии эксплойт-пака

Основное содержание обеих страниц идентично, однако в верхней части «новой» версии (рис.1) вместо меню вставлена голубая панель с текстом на русском языке:

Реклама: [удалено] – сервис криптовки iframe / javascript кода.

Реклама: Выделенные серверы в собственном дата-центре в Сирии под любые проекты. Опыт работы 6+ лет на рынке. Качество проверено временем! ;-) [удалено]

Реклама: Уникальный сервис регистрации доменов пачками. Под любые темы. Быстро, комфортно, надежно.[удалено]

Очевидно, что в данном случае «Blackhole 2.0» всего лишь приманка – один из способов заставить людей зайти на страницу и прочитать рекламные сообщения. Бывает, что спамеры используют имена известных людей, бренды или упоминания последних мировых событий, чтобы побудить пользователей открыть электронное письмо. Однако для экспертов стало неожиданностью, что точно так же кто-то использовал название популярного в определённых кругах эксплойт-пака.

Страница рекламирует услуги регистрации доменов, предложение хостинга серверов, а также услуги шифрования JavaScript и iframes. Объединённые воедино, подобные сервисы обеспечивают злоумышленников полноценной инфраструктурой для проведения атак. Фактически, сайт, «засвеченный» в рекламе услуг шифрования, и сайт, фигурирующий в рекламе регистрации доменов – оба известны в качестве части инфраструктуры для проведения «грязных операций».

Другие признаки, указывающие на то, что страница Blackhole Exploit Kit 2.0 является фальшивкой:

- имя данной веб-страницы – bhstat.php, уже известное имя файла старой версии, которое доступно без аутентификации;

- на сайте не было обнаружено ни одной ещё неизвестной PHP-страницы Blackhole;

- в разделе «Эксплойты», видимо для большей убедительности, числится Java pack, который фигурировал ранее в сообщении автора о выходе новой версии 2.0.

Таким образом, это не новый Blackhole Exploit Kit 2.0, а перехешированная страница нынешней версии, выдающая себя за новую. К тому же авторы данной страницы не имеют новой версии и, скорее всего, вообще никак не связаны с Blackhole, а лишь пытаются продвигать свои услуги, мошеннически эксплуатируя хорошо известное название. Очевидно, что их целевая аудитория – кибер-преступники, интересующиеся эксплойт-паком, которым также может потребоваться инфраструктура для его размещения.