Основатель Telegram Павел Дуров жёстко высказался в адрес WhatsApp (принадлежит корпорации Meta, признанной экстремисткой и запрещённой в России), заявив, что разговоры о защищённости переписки в этом мессенджере — не более чем иллюзия. По его словам, функция шифрования в WhatsApp может оказаться «самым крупным мошенничеством в отношении потребителей в истории».

Об этом Дуров написал в своём телеграм-канале. Он заявил, что миллиарды пользователей якобы введены в заблуждение обещаниями полной конфиденциальности.

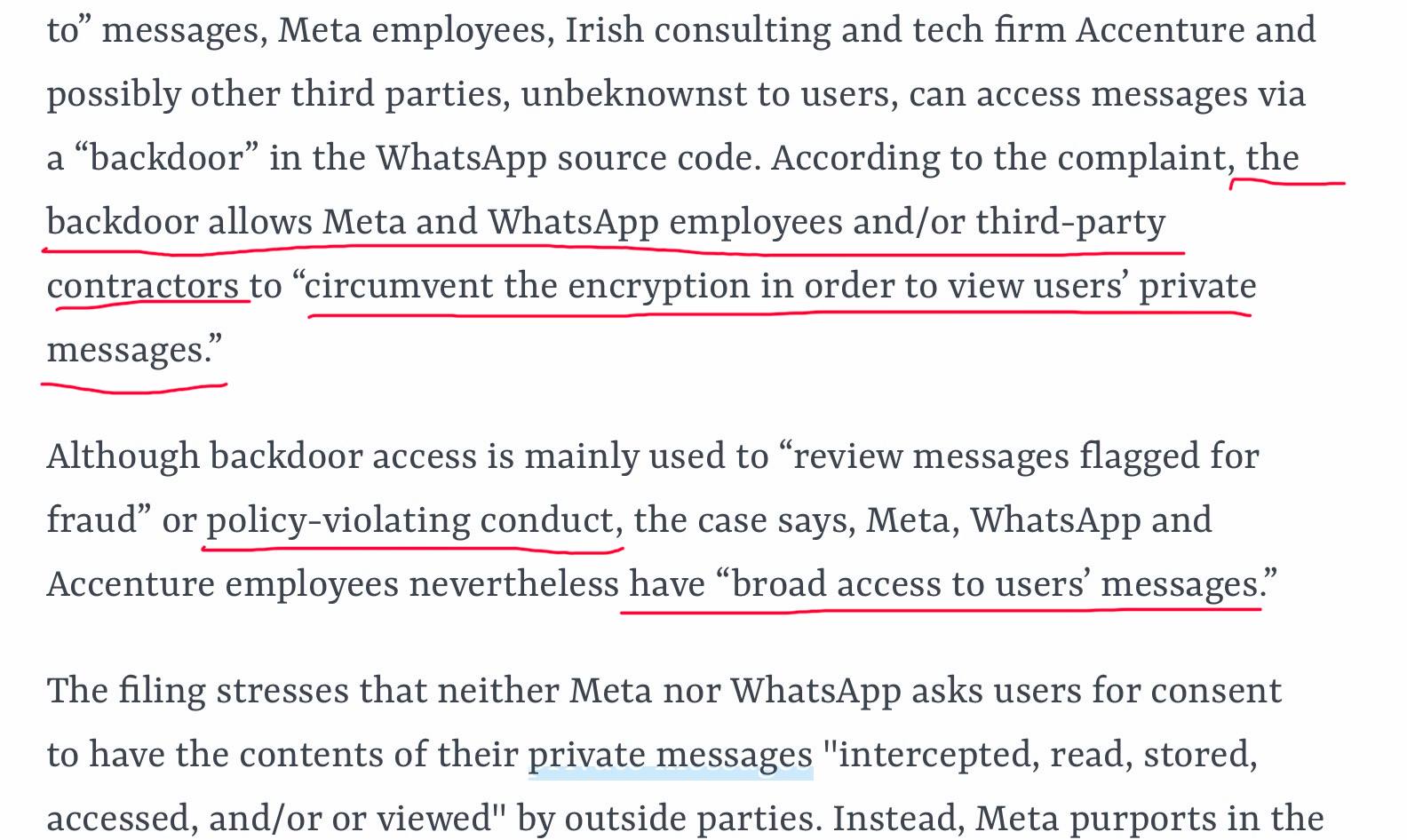

По его версии, несмотря на публичные заявления о защите сообщений, WhatsApp читает переписку пользователей и передаёт данные третьим сторонам.

На этом фоне Дуров отдельно подчеркнул позицию Telegram. По его словам, сервис никогда не позволял себе читать личные сообщения пользователей и не собирается делать этого в будущем. Он заверил, что для Telegram конфиденциальность переписки остаётся принципиальным вопросом.

Кроме того, основатель мессенджера сравнил подходы двух платформ к защите данных. По его мнению, Telegram использует более жёсткие правила в этой сфере, что помогает лучше защищать личную информацию и снижать риск утечек.

Напомним, на днях Дуров связал критику Telegram с попытками усилить цензуру и контроль в ЕС.