Киберпреступники нашли новый способ воровать данные банковских карт владельцев Android-смартфонов, и для этого им даже не нужно устанавливать вредонос из сомнительного магазина приложений. Новые версии трояна NFCShare распространяются под видом обновлений банковских приложений на GitHub.

О вредоносной кампании сообщили исследователи компании D3Lab. По их данным, злоумышленники создают фишинговые сайты, маскирующиеся под страницы банков.

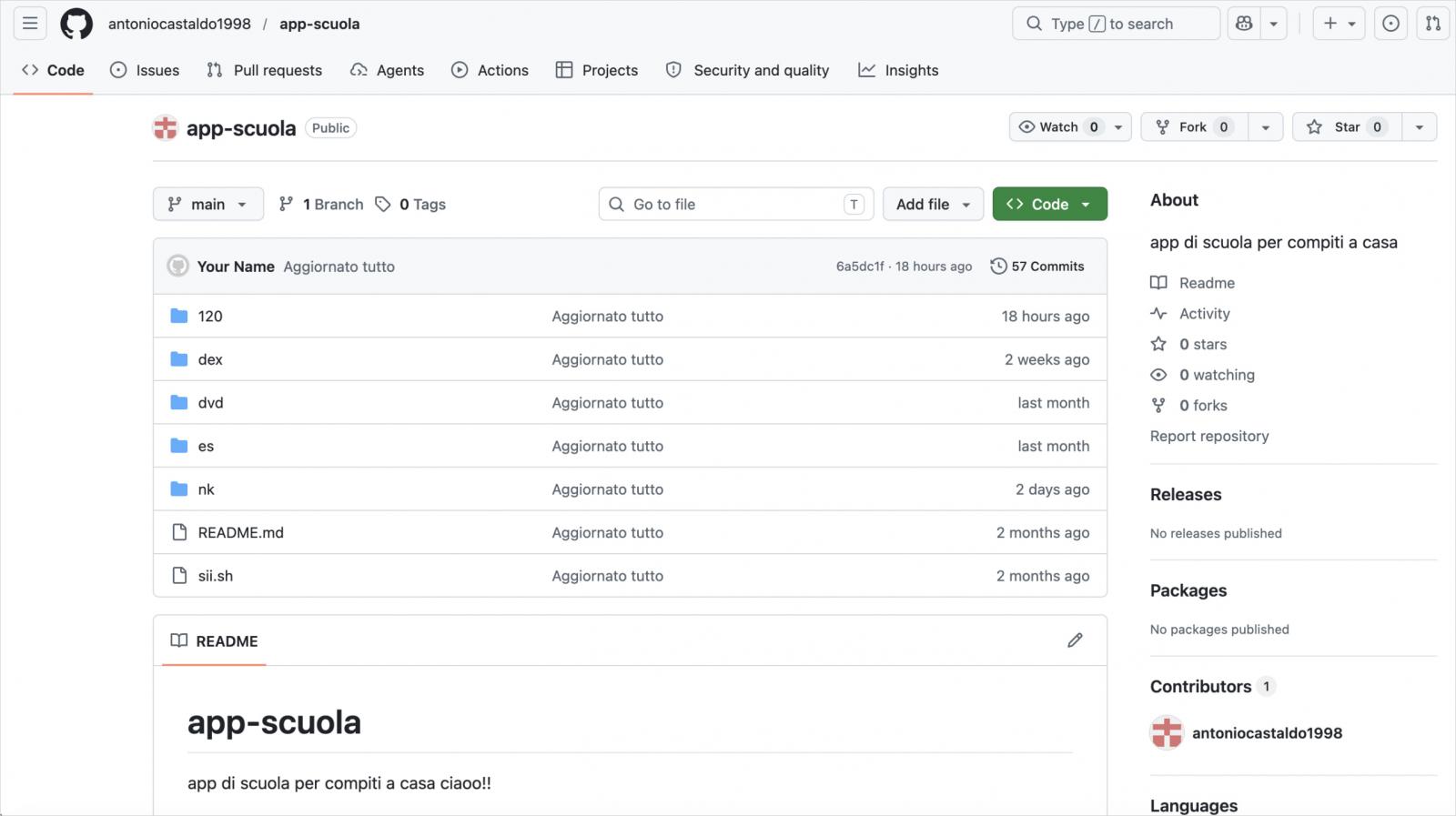

После ввода логина и пароля жертве предлагают обновить банковское приложение, скачав APK-файл из репозитория на GitHub. После установки троян показывает пользователю фальшивую страницу проверки безопасности и просит приложить банковскую карту к смартфону.

Используя NFC-модуль устройства, NFCShare считывает данные карты: номер, тип, срок действия и даже ПИН-код, который жертва вводит якобы для подтверждения операции.

Полученная информация отправляется на сервер злоумышленников через WebSocket-соединение. В дальнейшем её можно использовать в схемах, когда преступники проводят платежи удалённо, фактически используя чужую карту на расстоянии.

По данным исследователей, нынешняя кампания стартовала в середине мая. Среди подделываемых приложений фигурируют CaixaBank, Nexi, Banca Sella, Fideuram и другие финансовые организации. Ранее вредонос атаковал только клиентов Deutsche Bank в Германии, однако теперь география заметно расширилась.

Разработчики трояна продолжают совершенствовать свои инструменты. В новых версиях NFCShare появилась дополнительная защита от анализа. APK-файлы специально упаковываются с повреждённой структурой каталогов, что может вызывать ошибки у некоторых автоматических средств исследования зловредов.

Впрочем, исследователи отмечают, что такая уловка не делает вредонос неуязвимым для анализа, а лишь усложняет работу отдельных инструментов.

Эксперты рекомендуют устанавливать банковские приложения только из официального магазина Google Play, не скачивать APK-файлы по ссылкам из СМС и писем, а также крайне осторожно относиться к любым просьбам приложить банковскую карту к смартфону для проверки или подтверждения безопасности.