Исследователи из ThreatFabric обнаружили новую версию Android-банкера TrickMo, которая получила необычный способ связи с операторами: теперь зловред использует сеть The Open Network (TON) для сокрытия инфраструктуры управления.

TrickMo известен с 2019 года и всё это время активно развивается. Раньше его уже находили в десятках вариантов: например, в 2024 году Zimperium изучила 40 версий банкера, распространявшихся через 16 дропперов и работавших с 22 C2-инфраструктурами.

Новый вариант ThreatFabric отслеживает как Trickmo.C. По данным исследователей, он активен как минимум с января и маскируется под TikTok или приложения для стриминга. Главные цели операторов — банковские приложения и криптокошельки.

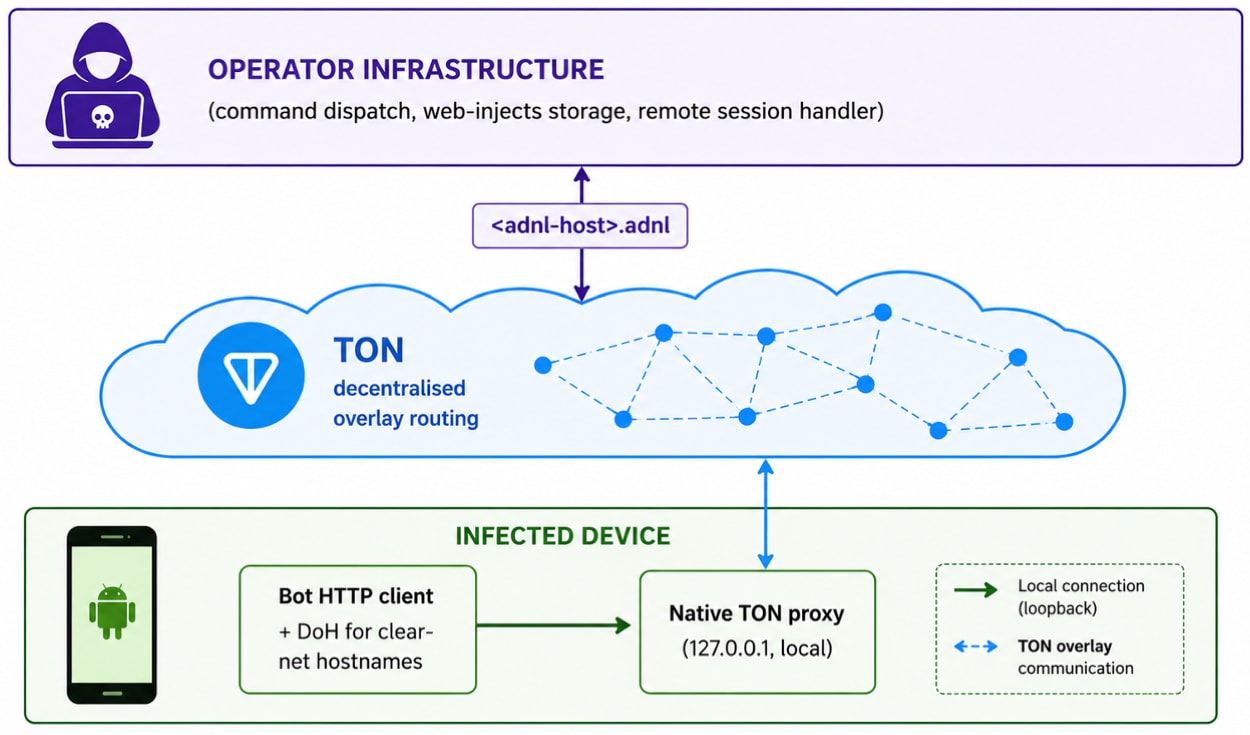

Интересная особенность свежей версии — связь с управляющим сервером через TON. На заражённом устройстве запускается локальный TON-прокси, а коммуникации идут через .adnl-адреса. В отличие от обычных доменов, такие адреса не завязаны на публичный DNS, поэтому классические блокировки и изъятия доменов здесь почти не помогают. Для сетевых средств защиты такой трафик выглядит просто как зашифрованный TON-трафик.

Сам TrickMo остаётся модульным зловредом. Сначала на устройство попадает основной APK, который отвечает за загрузку и закрепление, а затем подтягивается дополнительный модуль с основной функциональностью.

Возможности у TrickMo внушительные: фишинговые оверлеи для кражи банковских данных, кейлоггинг, запись и трансляция экрана, перехват СМС, подавление уведомлений с одноразовыми кодами, подмена буфера обмена, фильтрация уведомлений и создание скриншотов.

В новой версии появились и дополнительные команды, включая curl, ping, dnsLookup, telnet, traceroute, SSH-туннелирование, локальный и удалённый проброс портов, а также поддержку SOCKS5-прокси с авторизацией.

Исследователи также заметили в Trickmo.C фреймворк Pine. Ранее его использовали для перехвата сетевых операций и Firebase, но в текущей версии он пока неактивен. Кроме того, зловред запрашивает множество NFC-разрешений, хотя рабочей NFC-функциональности специалисты не нашли.

Пользователям Android традиционно советуют не устанавливать приложения из сторонних источников, держать включённым Play Protect и не раздавать подозрительным приложениям лишние разрешения.