Судя по презентации на BI.ZONE Days, компания намерена к 2027 году не просто выйти в лобовую конкуренцию с «Лабораторией Касперского», Dr.Web и Positive Technologies на рынке защиты конечных точек, но и параллельно собрать собственный полноценный стек под XDR.

План у BI.ZONE такой: свой сетевой контур, свой NGFW, свой NSP, и всё это в итоге должно сложиться в полноценную XDR-платформу.

Ключевой опорой для этого курса стала покупка Nano Security летом 2025 года. Именно этот актив, судя по логике представленных дорожных карт, теперь должен помочь BI.ZONE построить не просто очередной EDR, а полноценную Endpoint Security Platform. Причём такую, которая позволит компании попытаться подвинуть лидеров рынка: Kaspersky, Dr.Web и Positive Technologies.

На слайдах BI.ZONE рисует красивую эволюцию «от EDR к ESP». В платформу уже включены или запланированы EDR, HIPS, Host Compliance, Deception, ZTNA Client, Vulnerability Assessment, Forensics, AV Basic, AV Advanced, Host Discovery и Security Controls.

Отдельно компания объясняет, зачем ей вообще понадобился антивирус: без него не построить фундамент защиты конечных точек, не получить сигнатурный движок и не собрать единую платформу защиты конечных точек на базе одного агента.

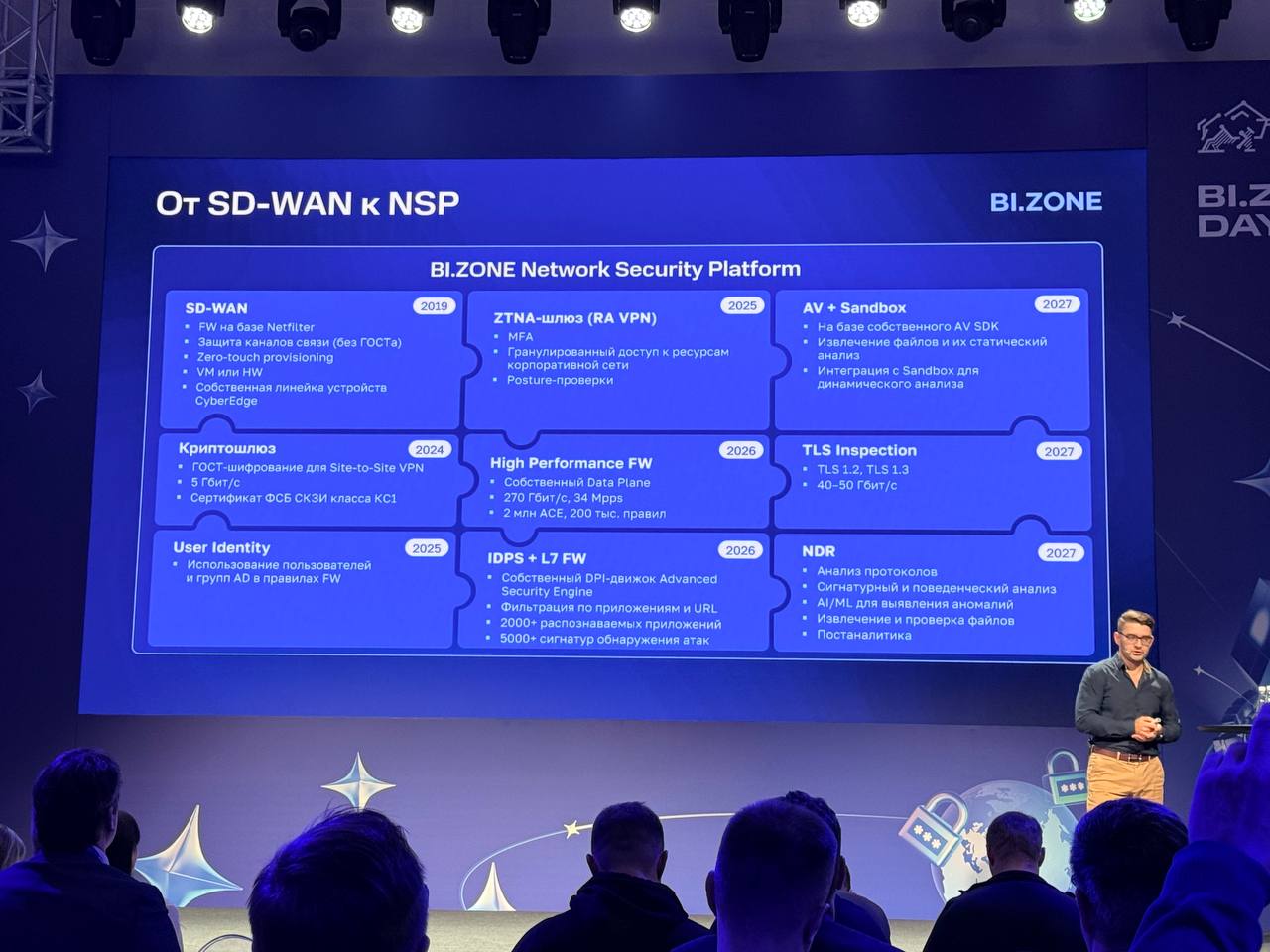

Но и это не всё. По сетевому направлению компания строит BI.ZONE Network Security Platform — фактически свою платформу сетевой безопасности, в которую уже входят SD-WAN, криптошлюз, User Identity и ZTNA-шлюз, а к 2026–2027 годам должны добавиться High Performance Firewall, IDPS + L7 FW, TLS Inspection, AV + Sandbox и NDR.

Отдельный аттракцион — заход в B2C. BI.ZONE, судя по дорожной карте, к 2026 году планирует выпустить BI.ZONE Antivirus Lite для обычных пользователей, а к 2027 — уже полноценный антивирус как самостоятельный продукт.

Смело. Особенно с учётом того, что рынок потребительских антивирусов — это постоянная гонка за качеством детекта, ложными срабатываниями и доверием пользователей. Но план есть план.

План, конечно, дерзкий. Удачи. :)