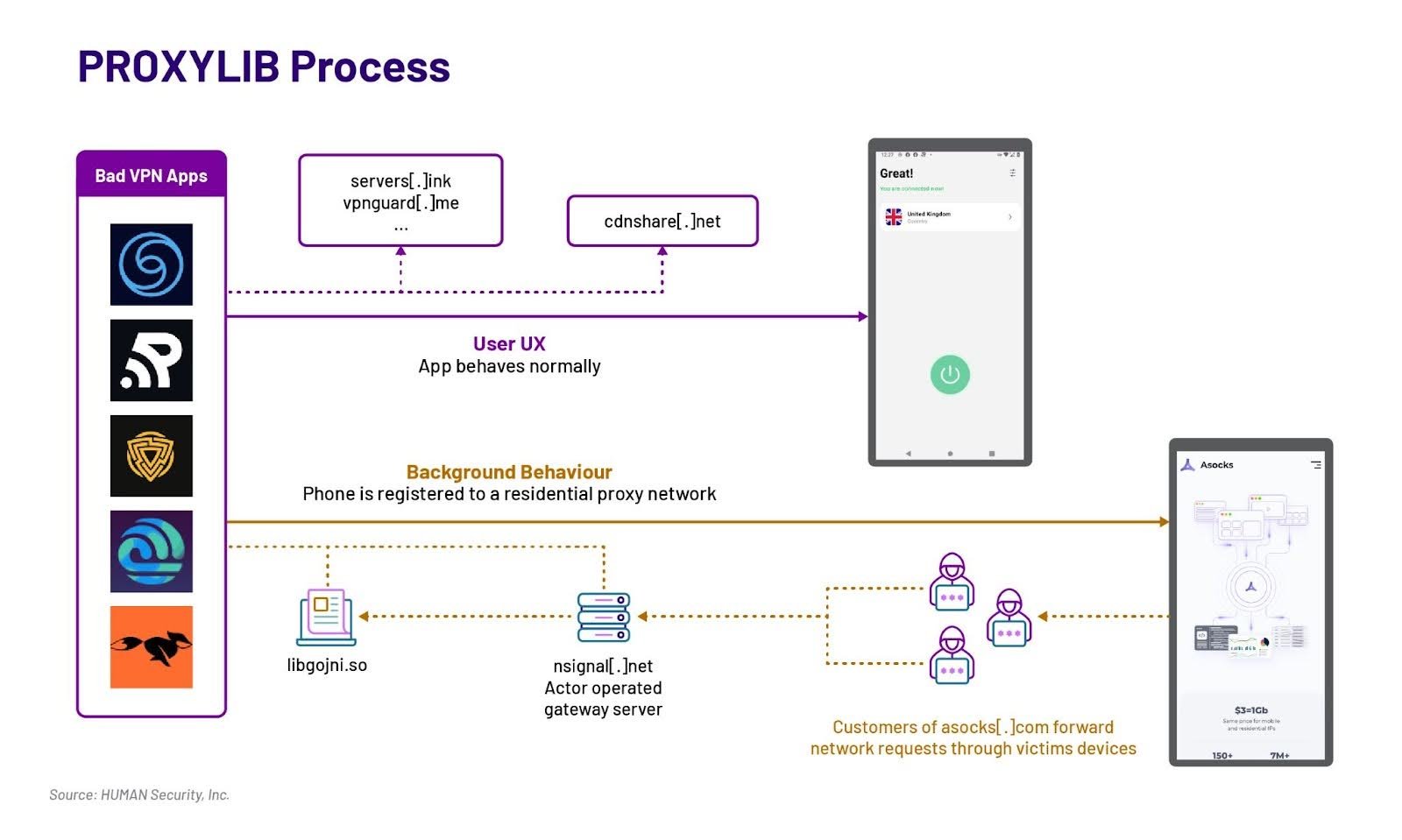

В марте 2023 года с Google Play удалили бесплатный VPN-софт, который приобщал Android-устройства к прокси-сети, используемой для сокрытия рекламного мошенничества. В HUMAN Security проанализировали Oko VPN и нашли в магазине еще 28 схожих приложений.

Все они используют Golang-библиотеку, отвечающую за прокси-функциональность, однако в описаниях эта возможность не упомянута. Продукты, нарушающие политику Google, уже изъяты из доступа; авторы находок идентифицируют их под общим условным именем PROXYLIB.

Схожий вариант библиотеки на Go встроен также в LumiApps SDK, свободно доступный онлайн. В прошлом году этот комплект разработчика активно продвигали в соцсетях и даркнете как средство монетизации приложений, альтернативное рекламе.

Проведенное в HUMAN исследование показало, что в декларации конфиденциальности LumiApps открытым текстом сказано: устройства становятся частью сетей LumiApps, однако разработчики часто игнорируют такие заявления, а конечным пользователям и вовсе невдомек, что может твориться у них в фоне.

В ходе исследования были обнаружены признаки связи PROXYLIB с Asocks — провайдером услуг по проксированию трафика с помощью частных серверов. Чтобы объединить такие узлы в сеть и построить на ее основе прокси-сервис, добровольцам могут платить за установку proxyware, а остальным навязывать его обменным путем, вместе с кряками или под видом полезного софта.

Примечательно, что PROXYLIB-приложения, удаленные Google из магазина, — в основном бесплатные VPN. Кстати, проверенный VPN-софт в Google Play теперь помечается особым значком, гарантирующим благонадежность.

Большинство обнаруженных приложений с LumiApps SDK можно встретить лишь в сторонних репозиториях; они там позиционируются как моды.