Яндекс опубликовал результаты внутреннего расследования инцидента с попавшим в открытый доступ программным кодом. Оказалось, что вместе с ним слили данные некоторых партнеров, ошибки в системе часто исправляли “костылями”, а Алиса подслушивала хозяев. Кроме того, SEO-алгоритмы Яндекса очень похожи на Google.

Почти 45 ГБ программного кода сервисов Яндекса попали в Сеть на минувшей неделе. Уже не секрет, что торрент с кодом на хакерский форум выложил бывший сотрудник ИТ-корпорации. Дамп он сделал в июле 2022 года, сами файлы датируются февралем, как раз в период начала СВО.

Накануне вечером, на пятый день скандала, Яндекс представил общественности результаты внутреннего расследования, а также извинился перед пользователями и партнерами.

“Опубликованные фрагменты действительно взяты из нашего внутреннего репозитория — инструмента, с помощью которого разработчики компании работают с кодом, — говорится в отчете. — При этом содержимое архива соответствует устаревшей версии репозитория — она отличается от актуальной версии, которая используется нашими сервисами”.

И хотя ИТ-гигант по-прежнему утверждает, что опубликованные фрагменты не несут угрозы безопасности пользователей или работоспособности сервисов, собственный аудит показал серьезные нарушения политик информационной безопасности и этических принципов самого Яндекса.

А именно:

- В коде содержались данные некоторых партнёров. Например, водителей — их контакты и номера удостоверений передавались из одного таксопарка в другой.

- Зафиксированы случаи, когда логику работы сервисов корректировали не алгоритмами, а “костылями”.

- В сервисе “Яндекс Лавка” существовала возможность ручной настройки рекомендаций любых товаров без пометки об их рекламном характере.

- Наличие приоритетной поддержки для отдельных групп пользователей в сервисах “Такси” и “Еда”.

- Некоторые части кода содержали слова, которые никак не влияли на работу сервисов, но были сами по себе оскорбительны для людей разных рас и национальностей.

Кроме того, согласно исходному коду “Яндекс Алисы”, приложение способно включать микрофон устройства в случайный момент времени даже без упоминания “Алисы”. Это делалось якобы для улучшения качества активации ассистента.

“Сейчас нам очень стыдно, и мы приносим извинения нашим пользователям и партнёрам”, — заявили в “Яндексе”.

Одной из причин таких нарушений в политиках безопасности в самой компании назвали чрезмерную приверженность подходу Zero Bug Policy.

Политика нулевой терпимости к багам вынуждала ИТ-специалистов Яндекса постоянно что-то подкручивать и подставлять “костыли”, а не решать проблему системно.

Другой проблемой, которой, как выяснилось, в руководстве Яндекса уделяли мало внимание, стала техноэтика и моральные принципы. В коде “проскакивают” расистские и оскорбительные комментарии, оставленные айтишниками.

В конце расследования Яндекс еще раз извинился и пообещал “выучить урок”.

Добавим, накануне определённую закономерность в слитом коде обнаружил и SEO-консультант Мартин Макдональд (Martin MacDonald).

“Слив кода Яндекса — вероятно, самое интересное, что произошло в SEO за долгие годы”, — написал эксперт у себя в Twitter.

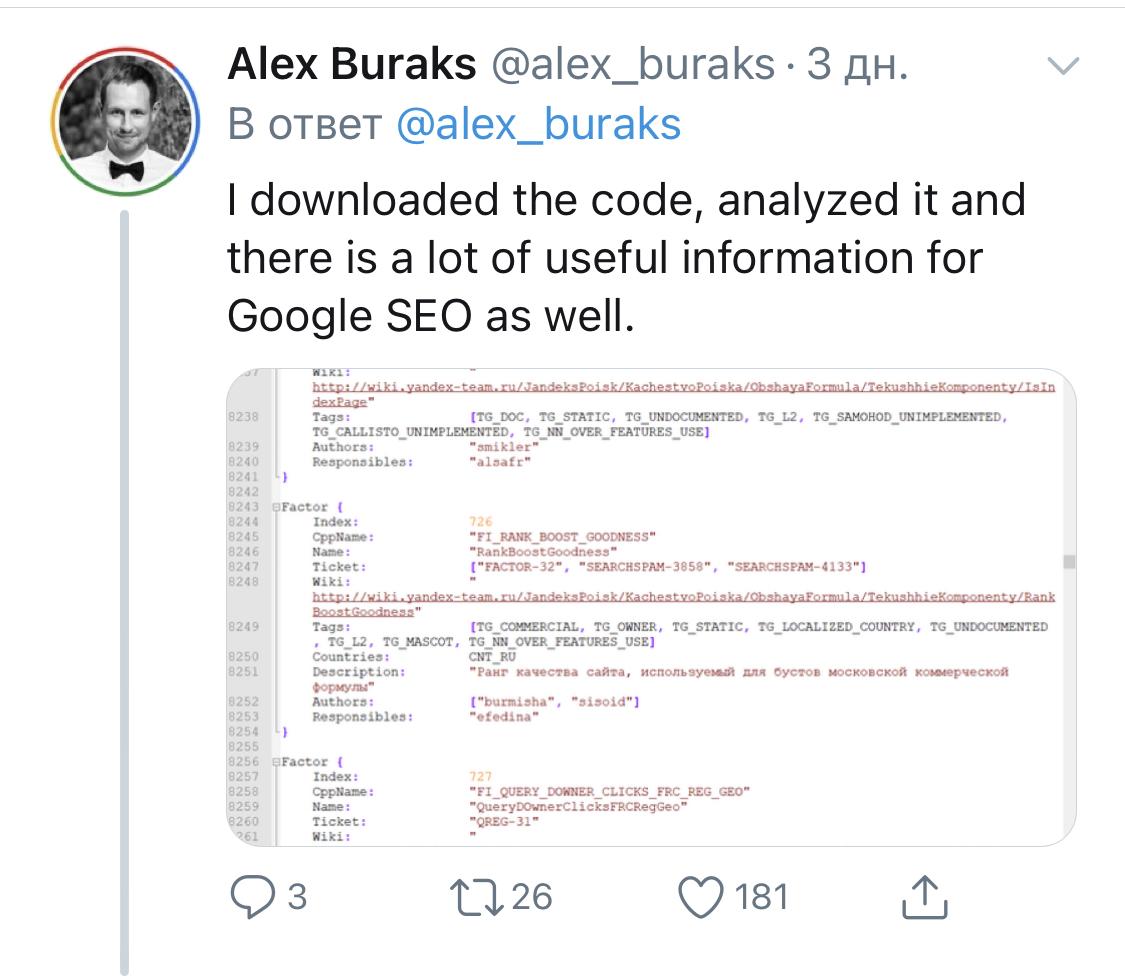

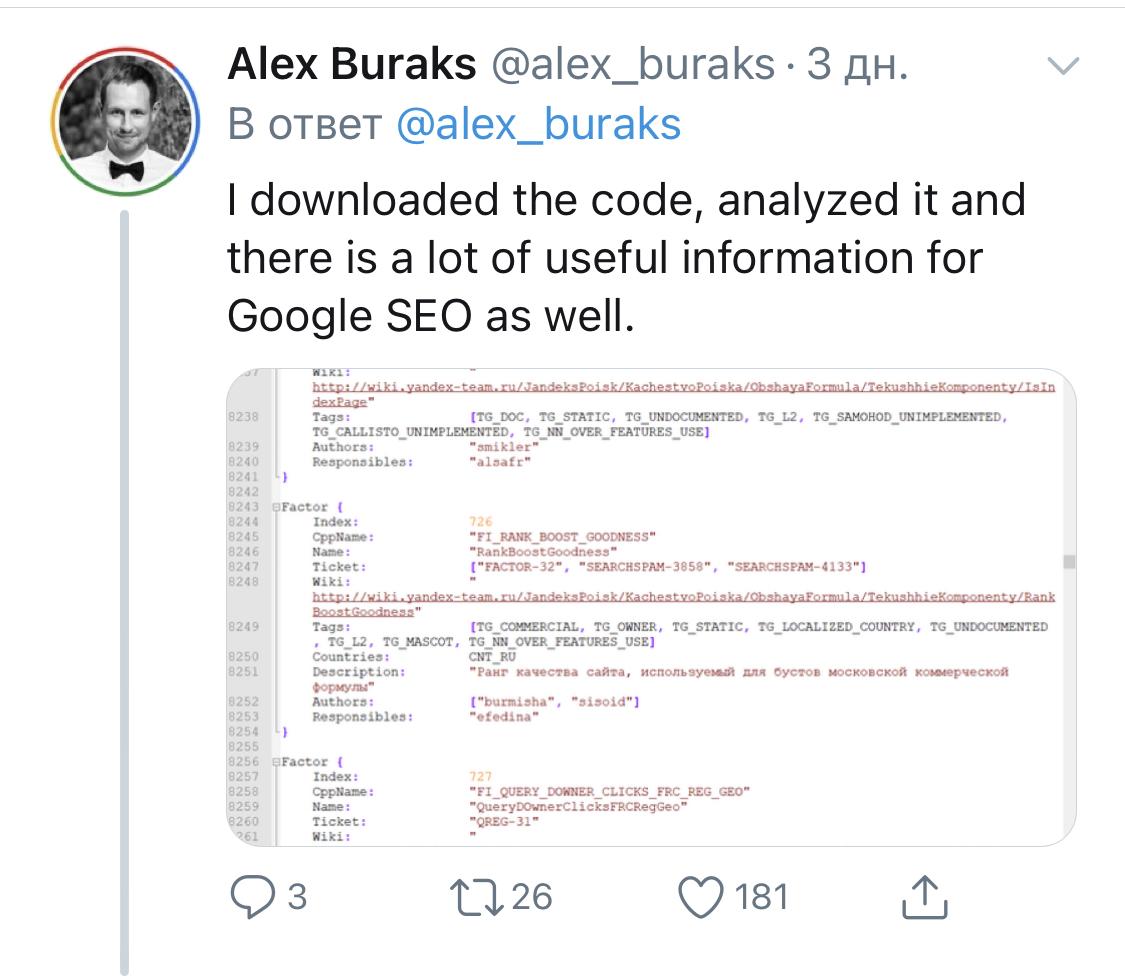

По словам другого исследователя Алекса Буракса (Alex Buraks), почти в 2 тыс. факторах ранжирования поисковой системы Яндекса угадывается “след” Google.

Яндекс, четвертая по объему поисковая система в мире, якобы берет на работу бывших сотрудников Google, чтобы использовать их осведомленность в SEO конкурента.

Буракс отмечает, первым в списке факторов ранжирования Яндекса значится “PAGE_RANK”. Он, весьма вероятно, связан с базовым алгоритмом, разработанным основателями Google.

Добавим, российское подразделение Google летом объявило о банкротстве в связи с “невозможностью исполнения денежных обязательств” из-за ареста банковского счета. Арбитражный суд Москвы ввел в компании процедуру наблюдения.