Исследователи обнаружили ранее неизвестный троян-дроппер для Android, который всё ещё находится в стадии разработки. Вредонос является ярким примером того, что киберпреступники продолжают находить лазейки для обхода защитных механизмов мобильной ОС и Google Play Store.

Новый дроппер засекли специалисты компании ThreatFabric. Хан Сахин, один из исследователей, описывает киберугрозу следующим образом:

«Вредонос пытается проникать на Android-устройства с помощью новой техники, которая ранее нам не встречалась. Кроме того, дроппер распространяет крайне опасного банковского трояна Xenomorph».

Свежий дроппер назвали “BugDrop”, самое интересное в нем — специальный акцент на обход защитных функций, реализованных в версии Android 13, готовящейся к скорому выходу. Напомним, что одной из особенностей этого релиза мобильной ОС стала защита специальных возможностей Accessibility Services от вредоносных программ.

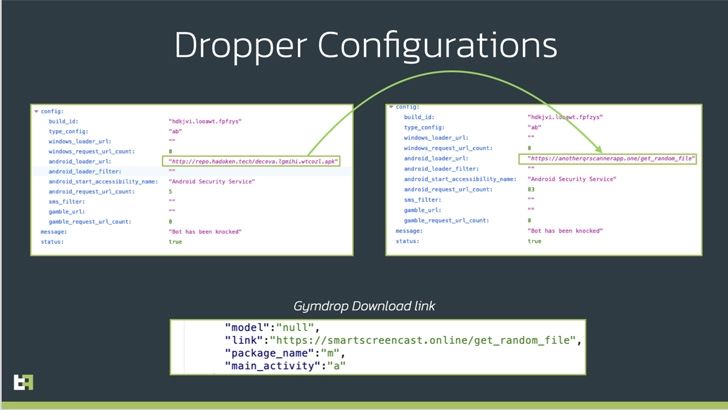

В ThreatFabric считают, что за BugDrop стоит киберпреступная группировка “Hadoken Security”, которая известна распространением опасных вредоносных приложений — Xenomorph и Gymdrop.

Поскольку Accessibility API позволяет софту считывать контент на дисплее и осуществлять определение действия от лица пользователя, он очень полюбился злоумышленникам. В Google это прекрасно понимают, поэтому решили предусмотреть защиту от этого вектора в Android 13.

Известно, что большинство таких вредоносных приложений загружаются сторонним способом. Это значит, что пользователь должен разрешить их установку из неофициальных источников. Именно поэтому в Android 13 система будет блокировать доступ к Accessibility API софту, загруженному не из Google Play Store.

Разработчики BugDrop быстро сообразили, что нужно как-то обойти эти защитные меры. Дроппер, замаскированный под считыватель QR-кодов, разворачивает вредоносную нагрузку через сессионный процесс инсталляции.

Фактически злоумышленники используют уже готовый вредонос, способный самостоятельно устанавливать APK на устройство жертвы. Такой подход может сделать банковские Android-трояны ещё более опасными, предупреждают исследователи.