Google обычно гордится своей безопасностью — именно поэтому компания так активно борется с установкой непроверенных приложений на Android. Но, похоже, когда речь зашла о защите Gemini, Google решила, что тревогу бить не стоит.

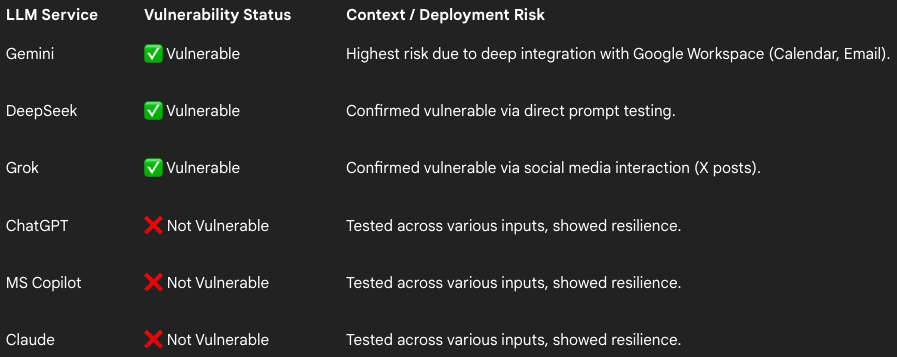

По данным BleepingComputer, специалист по кибербезопасности Виктор Маркопулос проверил популярные большие языковые модели (LLM) на устойчивость к атакам ASCII smuggling — и выяснил, что Gemini, DeepSeek и Grok уязвимы. А вот Claude, ChatGPT и Copilot такие трюки распознают и не поддаются.

Если коротко, ASCII smuggling — это способ спрятать скрытую инструкцию для ИИ прямо в тексте. Например, злоумышленник может вставить «невидимый» промпт в письмо или приглашение в календаре — с микроскопическим шрифтом или в другом малозаметном виде.

Пользователь об этом даже не узнает. Но если он попросит ИИ вроде Gemini «пересказать письмо», модель послушно прочитает и выполнит скрытое указание.

Последствия могут быть неприятными. В теории ИИ можно заставить искать в почте конфиденциальные данные или отправлять контактную информацию. Учитывая, что Gemini уже встроен в Google Workspace, риск возрастает — ведь это доступ к корпоративной почте, календарю и документам.

Маркопулос сообщил Google о находке и даже продемонстрировал пример атаки: невидимый промпт заставил Gemini выдать ссылку на фишинговый сайт с «скидочными смартфонами». Однако в компании ответили, что это не уязвимость, а социальная инженерия — мол, ответственность лежит на пользователях.

Проще говоря, исправлять проблему Google не собирается. Ирония в том, что ИИ, который должен помогать работать безопаснее, теперь сам может стать инструментом для обмана — если прочтёт не то письмо.

Ранее мы писали о трёх серьёзных уязвимостях в экосистеме Google Gemini, получивших общее название «Gemini Trifecta». С их помощью злоумышленники могли украсть сохранённые данные пользователей и даже отследить их местоположение в реальном времени.