Компания «ИТ-Экспертиза» выпустила новую версию программного комплекса САКУРА 3.2. В релизе расширили интеграции, доработали безопасность, обновили интерфейс и оптимизировали работу системы в крупных инфраструктурах.

Одно из заметных изменений — расширение поддержки решений для контроля сетевого доступа.

В САКУРА 3.2 добавлены интеграции с VPN-решениями ЗАСТАВА, С-Терра, ViPNet, а также с NAC-системой WNAM. Кроме того, появились новый тип SSH-запроса, поддержка mTLS для REST, возможность использовать несколько шлюзов в команде RADIUS и команда «Запрос в LDAP».

Блок безопасности тоже заметно обновился. В систему добавили семь новых правил контроля, возможность включать и выключать правила в категории безопасности, отправку в SIEM информации о хеше загружаемого файла и монитор пользовательских атрибутов.

Также появились идентификатор пользователя РМ в объекте «Нарушение», подключение к СУБД в SSL-режимах и возможность для агента назначать уровень нарушения.

Отдельно доработали сценарии администрирования. В версии 3.2 появились новые инструменты для работы с объектами панели управления: НСИ, автопараметрами, справочниками и другими элементами.

Обновился и Агент САКУРА. Разработчики улучшили уведомления, работу с нарушениями и пользовательский опыт. Для администраторов это должно сделать взаимодействие с рабочими местами более понятным и оперативным.

В части производительности оптимизированы механизмы работы с СУБД. Это важно для инфраструктур с десятками тысяч рабочих станций, где стабильность и скорость обработки событий напрямую влияют на работу всей системы.

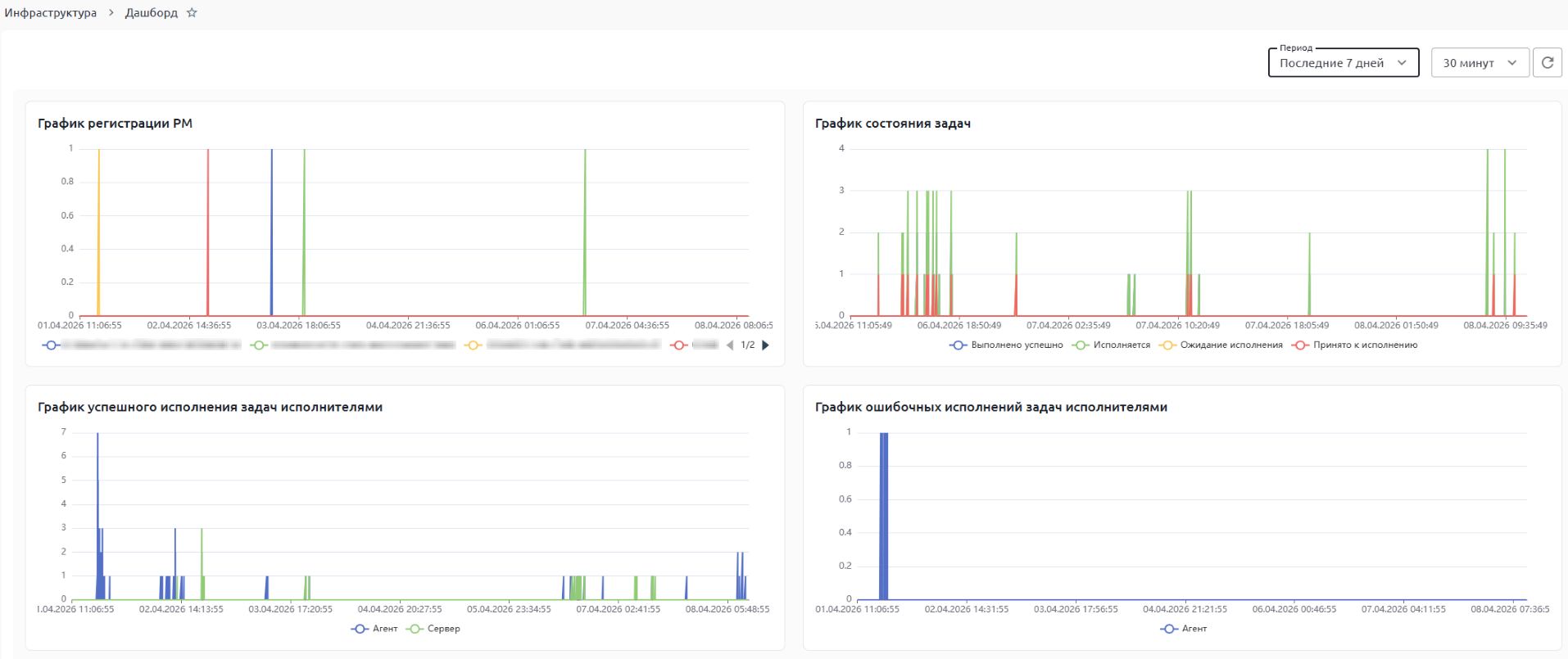

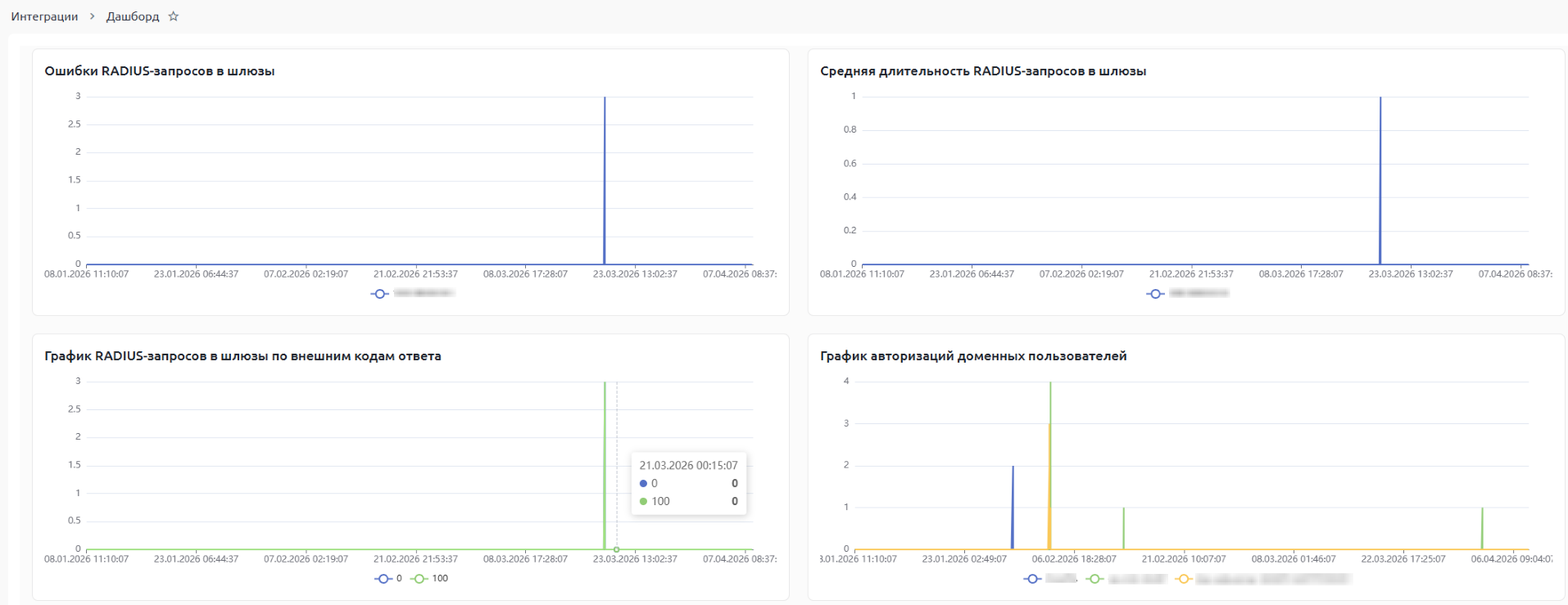

Интерфейс также получил обновления: появились новые дашборды для разделов «Инфраструктура» и «Интеграции», раздел «Внешние системы», отображение текущих нарушений на странице рабочего места, «светофор» статусов РМ и горячие клавиши. Также добавлено скрытие скриптов в выводе команды ps -aux.