Исследователи показали, как обычная компьютерная мышь может превратиться в инструмент для взлома. Проект получил название EvilMouse, по сути это аппаратный кейлоггер-инжектор, спрятанный внутри стандартного USB-манипулятора. Стоимость сборки — около $44 (3 394 руб.).

По принципу работы EvilMouse напоминает известный инструмент USB Rubber Ducky, который эмулирует клавиатуру и автоматически вводит заранее запрограммированные команды.

Но есть важное отличие: EvilMouse продолжает работать как обычная мышь. Внешне и функционально устройство ничем не выдаёт себя.

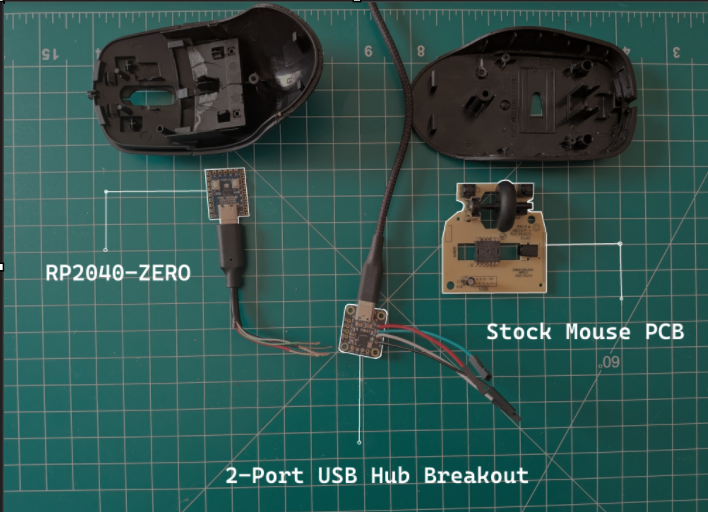

Внутри корпуса разместили недорогие компоненты — микроконтроллер RP2040 Zero, USB-хаб и начинку стандартной мыши. Автор проекта перепрошил устройство с помощью CircuitPython: при подключении к компьютеру мышь автоматически выполняет набор команд и открывает обратный шелл на машине атакующего. По результатам тестов доступ к системе с правами администратора удаётся получить буквально за считаные секунды.

Сложность заключалась в физической сборке — в компактном корпусе пришлось удалять пластиковые перегородки, аккуратно паять контакты и изолировать элементы. Но технически проект оказался вполне реализуемым даже при базовых навыках работы с электроникой.

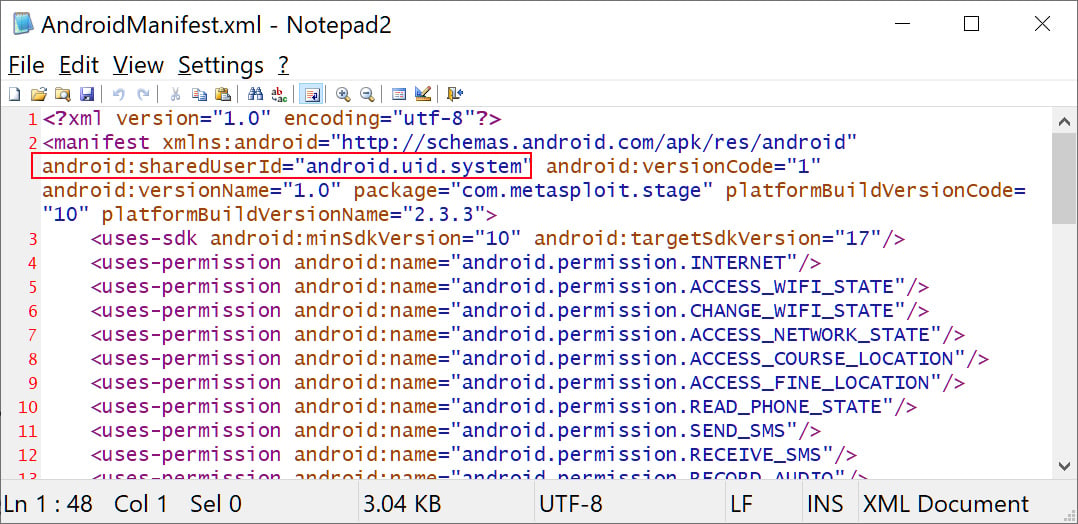

Главная проблема, на которую указывает автор, — это фактор доверия к «безобидной» периферии. Большинство сотрудников уже знают, что флешки могут быть опасны. А вот мышь, которая нормально двигает курсор, подозрений не вызывает. При этом устройство распознаётся системой как HID (Human Interface Device) и может отправлять команды, минуя многие стандартные механизмы защиты. В демонстрации атака проходила без срабатывания антивируса.

Исходный код проекта выложен на GitHub — автор подчёркивает, что работа носит исследовательский и образовательный характер. Однако сама концепция наглядно показывает: для компрометации системы не нужны дорогостоящие инструменты, достаточно фантазии и пары доступных компонентов.