Разработчики антивирусного софта Malwarebytes работают над фиксом бага, из-за которого пользователи не могли зайти на сайты, располагающиеся в домене google.com (включая поиск Google и YouTube). С аналогичными веб-сервисами фиксируется та же беда.

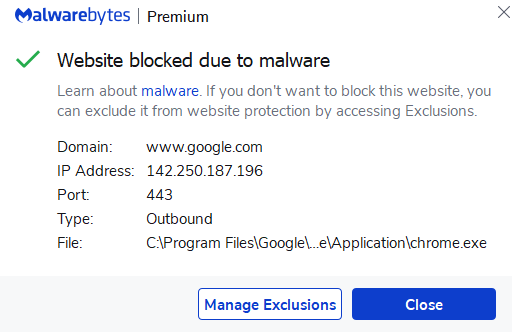

Согласно множеству жалоб от юзеров, в браузерах невозможно зайти на сайты Google, поскольку Malwarebytes видит в них угрозу. В результате ресурсы просто блокировались, а посетить их можно было только после отключения Malwarebytes.

В частности, пользователи отмечали «шквал уведомлений о вредоносных сайтах», в которых упоминались поддомены google.com. На площадке Downdetector один из клиентов прокомментировал ситуацию следующим образом:

«Похоже на то, что разработчики Malwarebytes выпустили забагованное обновление. Я не могу посетить ни один из сайтов Google, потому что получаю нескончаемые уведомления об угрозе. Я попробовал выключить защиту в режиме реального времени — ошибка ушла».

Разработчики быстро приняли к сведению множество жалоб и объяснили, что проблемы были вызваны модулем, отвечающим за веб-фильтрацию. В Twitter представители компании написали:

«Мы в курсе проблемы с компонентом веб-фильтрации, который может приводить к блокировке ряда веб-сайтов, включая google.com».

Как уже отметил один из пользователей, есть вполне логичный выход из ситуации: выключить опцию “Web Protection“, которая работает в режиме реального времени. Второй вариант — дождаться выхода обновления под номером 1.0.60360, о котором разработчики рассказали на форуме.