Компания «Гемотест», работающая в сфере оказания медицинских услуг, инициировала внутреннее расследование после того, как в Сети появилась информация об утечке персональных данных. Согласно сообщениям, киберинцидент мог затронуть 30 миллионов клиентов.

По результатам расследования, если информация об утечке подтвердится, «Гемотест» планирует обратиться в правоохранительные органы. Об этом в беседе с РБК сообщил Иван Осипов, отвечающий за информационную безопасность компании. Также Осипов подчеркнул, что компания усилила меры защиты конфиденциальной информации и персональных данных.

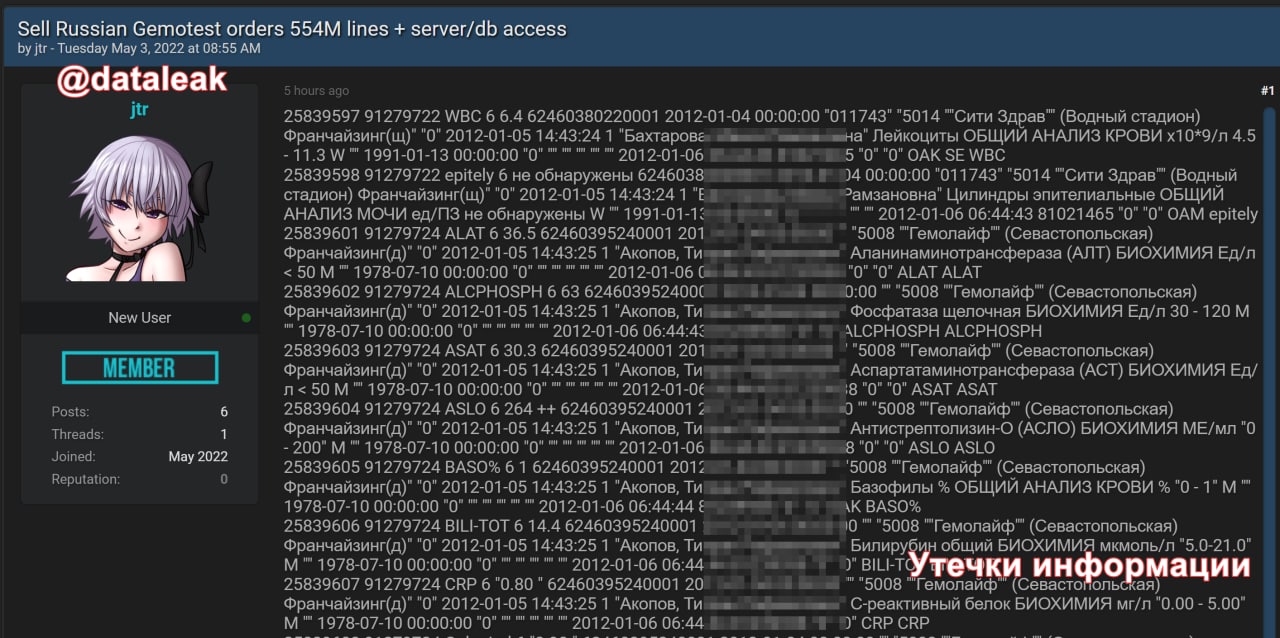

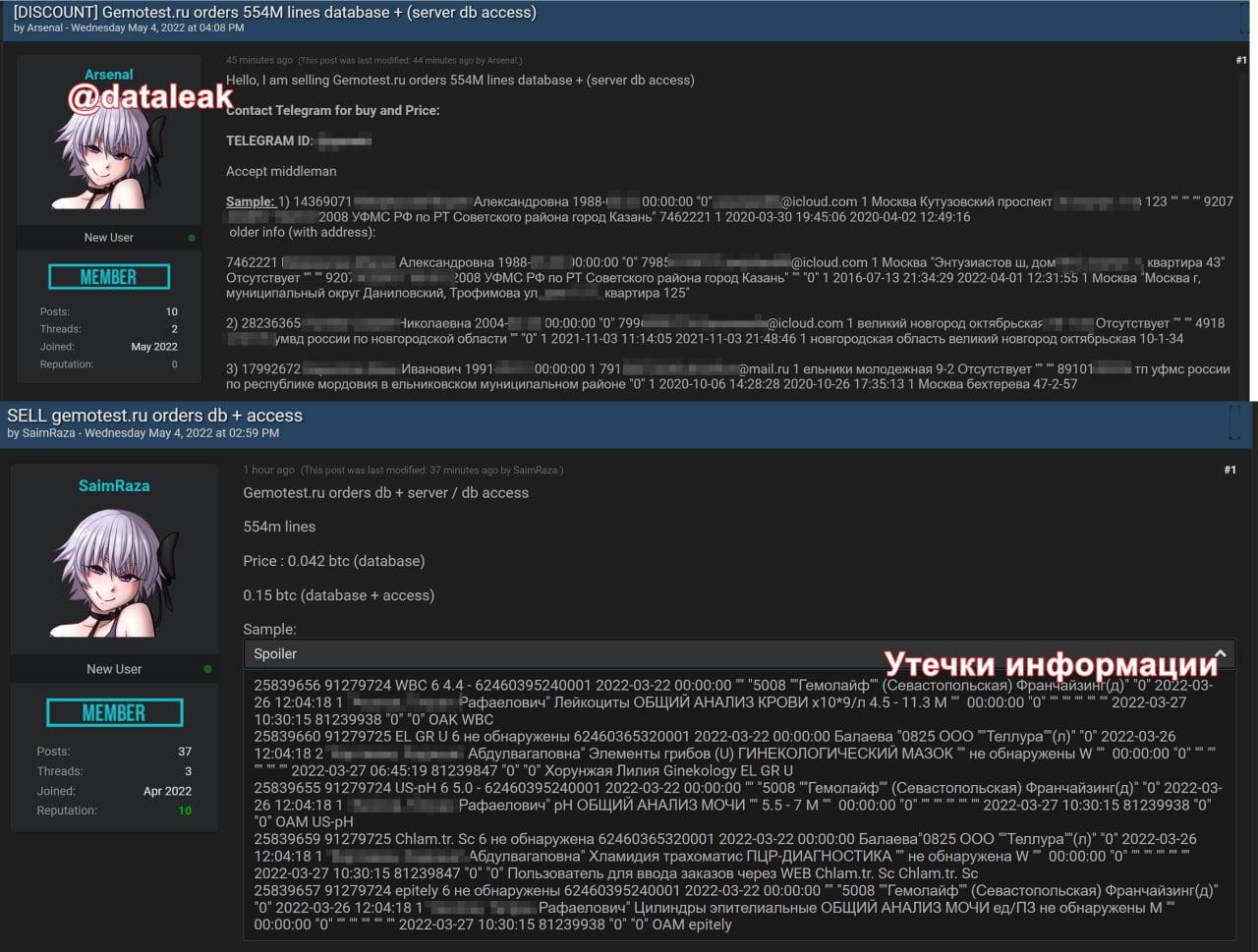

В Telegram-канале «Утечки информации» также пишут о растущем числе объявлений на форумах киберпреступной тематики. Злоумышленники продают доступ к серверу базы данных лаборатории «Гемотест».

По словам разместивших объявления пользователей, они согласны на «безопасную сделку» через гаранта, а это может значить, что доступ к якобы скомпрометированным сведениям до сих пор не закрыт.

На хакерском форуме утверждается, что в слитой БД содержатся 554 миллионов заказов, полные имена, даты рождения, составы заказов клиентов и т. п.