Google добавила поддержку песочницы V8 в браузере Chrome. Таким образом разработчики хотят избавить пользователей от проблем с повреждением памяти — классом уязвимостей, которым могут воспользоваться злоумышленники.

Как отмечает Сэмюэль Гросс из V8 Security, эта песочница предназначена для предотвращения повреждения памяти в V8 и распространения этого бага внутри хост-процесса.

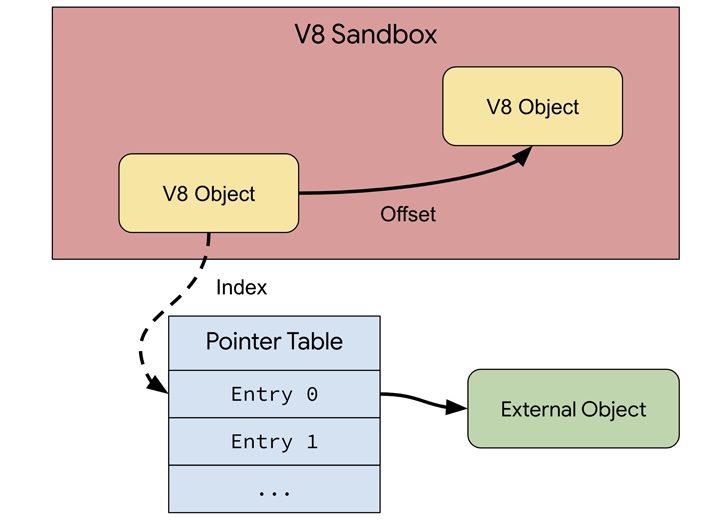

Сама Google описывает V8 Sandbox как легковесную песочницу внутри процесса для JavaScript- и WebAssembly-движка, задача которой — снизить риски эксплуатации типичных брешей в V8.

Замысел разработчиков заключается в том, чтобы ограничить возможность выполнения кода V8 подмножеством виртуального адресного пространства процесса и изолировать его от остальной части процесса. Это нивелирует угрозу эксплуатации определённого типа уязвимостей.

Ранее пользователи Chrome находились в зоне риска в том числе из-за множества дыр в V8 (включая 0-day).

«Функциональность песочницы берёт в расчёт, что атакующий сможет произвольно модифицировать любую память внутри адресного пространства изолированной среды», — объясняет команда Chromium.

«Песочница также принимает во внимание возможность читать память за её пределами (например, через побочные аппаратные каналы). Именно поэтому задача здесь — защитить остальную часть процесса от действий злоумышленника».

Гросс предложил снизить риски возникновения уязвимостей в V8, перейдя на более безопасный для памяти язык — Rust. Рассматривался также ряд аппаратных мер, таких как теггирование памяти.